Kimi-VL月之暗面开源轻量级多模态视觉语言模型

作者:互联网

2026-03-20

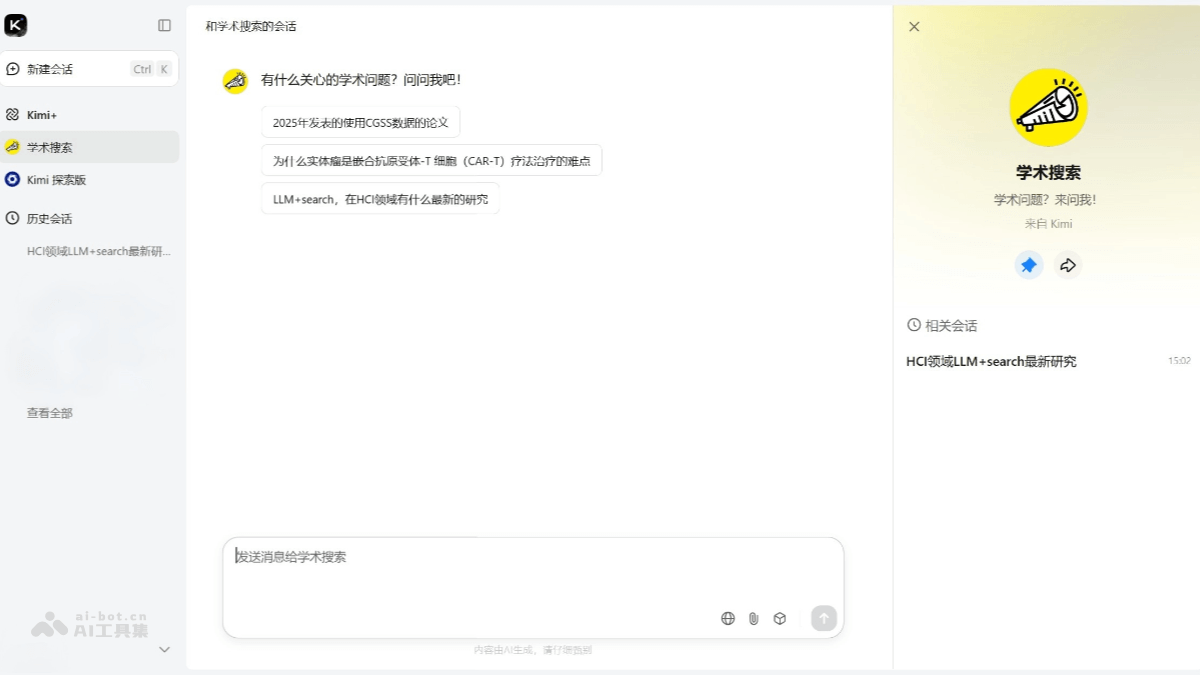

Kimi-VL作为轻量级多模态视觉语言模型,在图像识别、数学推理等任务中展现卓越性能,其创新架构与长上下文处理能力尤为突出。

Kimi-VL是什么

该开源模型采用轻量级MoE架构Moonlight与原生分辨率视觉编码器MoonViT,总参数量达16亿。其特色在于支持单图、视频等多模态输入,在OCR、数学推理等任务中超越GPT-4o等大型模型。特别开发的Kimi-VL-Thinking版本通过长链推理微调,仅需28亿激活参数即可实现复杂推理,性能接近前沿超大模型。

最新发布的Kimi-VL-A3B-Thinking-2506版本在多模态基准测试中取得突破,思考效率提升20%。其高分辨率处理能力显著增强,在V*Benchmark等测试中分别获得83.2、52.8等高分。该版本在图表分析、数学计算等领域表现优异,支持特定应答模式与思维链展示。

Kimi-VL的主要功能

- 多模态信息输入:兼容单图、多图、视频及长文档等多种数据格式。

- 图像细粒度感知:具备复杂场景解析能力,可精准识别图像细节。

- 数学和逻辑推理:结合视觉信息完成多模态数学题解与逻辑推演。

- OCR和文本识别:高效执行光学字符识别任务,准确提取图像文字。

- 智能体应用:适用于屏幕快照解析等Agent任务,处理视觉文本交互。

- 长思考能力:Thinking版本支持复杂任务的深度推理分析。

Kimi-VL的技术原理

- 架构设计:

- 视觉编码器(MoonViT):400M参数ViT架构直接处理原生分辨率图像,采用NaViT打包技术将图像块展平为一维序列。

- 多层感知器投影模块:通过两层MLP连接视觉与语言模块,利用像素重排压缩特征维度。

- 混合专家语言模型:6B总参数量MoE架构,基于52T token预训练数据初始化,继续训练23T多模态数据。

- 预训练阶段:

- 独立ViT训练:单独优化视觉编码器的特征提取能力。

- 联合训练:分预训练、冷却和长上下文激活三阶段提升多模态能力。

- 后训练优化:在32K/128K上下文中微调,结合Long-CoT与强化学习增强推理。

- 性能优化:128K上下文窗口实现长文本精准检索,MoonViT以低计算成本处理超高分辨率任务,Long CoT技术赋能复杂推理。

Kimi-VL的性能优势

- 高智力:在MMMU等基准测试中展现卓越多模态推理能力,文本处理媲美专业语言模型。

- 长上下文:128K超长窗口支持长视频分析,在LongVideoBench等测试中领先同级模型。

- 视觉能力:OCR、屏幕解析等任务表现突出,细节捕捉与信息理解优势明显。

Kimi-VL的项目地址

- GitHub仓库:https://github.com/MoonshotAI/Kimi-VL

- HuggingFace模型库:https://huggingface.co/collections/moonshotai/kimi-vl

- 技术论文:https://github.com/MoonshotAI/Kimi-VL/blob/main/Kimi-VL.pdf

Kimi-VL的应用场景

- 智能客服:实现图文交互式多轮对话服务。

- 教育辅导:提供可视化教学资料与解题指导。

- 内容创作:辅助视频编辑与多媒体内容生成。

- 医疗辅助:医学影像分析与健康咨询支持。

- 企业办公:长文档处理与会议智能服务。

Kimi-VL凭借轻量化设计与卓越的多模态处理能力,为人工智能应用开辟了更广阔的可能性。

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

OpenClaw 真正的效率开关,不是 Prompt,而是多会话和子代理

10款免费AI语音输入工具与软件 轻松实现语音转文字

MCP 协议深度解析:构建 AI Agent 的「万能接口」标准

WorkAny Bot 云端AI Agent工具采用OpenClaw框架构建

Anthropic 的 Harness 启示:当 AI Agent 开始「长跑」,架构才是真正的天花板

SkyBot由Skywork研发的云电脑AI助手

AI Agent 智能体 - Multi-Agent 架构入门

Nano Banana 2 国内使用指南 LiblibAI 无需翻墙教程

一文搞懂卷积神经网络经典架构-LeNet

一文搞懂深度学习中的池化!

AI精选