HelloMeme-基于StableDiffusion1.5模型的面部表情与姿态迁移框架实现

作者:互联网

2026-03-23

HelloMeme作为新一代表情包生成框架,采用前沿Diffusion技术实现表情姿态迁移,其创新的空间编织注意力机制让生成效果更自然生动。

HelloMeme是什么

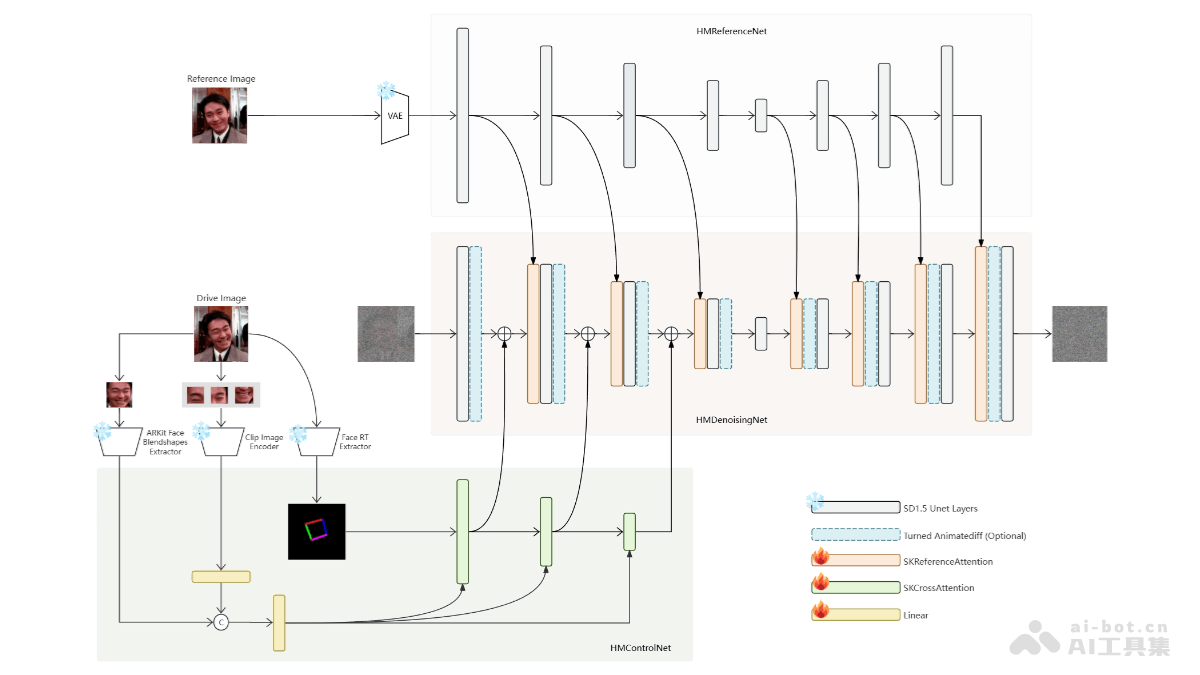

基于Stable Diffusion 1.5模型的先进框架,HelloMeme通过空间编织注意力机制实现表情与姿态的智能迁移。该系统将头部姿态和面部表情信息融入去噪网络,可生成物理合理的动态表情包视频,同时保持基础模型的强大泛化能力,支持扩展到全身或半身构图场景。

HelloMeme的主要功能

- 表情与姿态迁移:精准捕捉驱动视频中的头部姿态和面部表情特征,并将其迁移到参考图像,输出夸张生动的动态视频内容。

- 保持泛化能力:在执行复杂任务时仍保持基础模型的泛化特性,确保生成内容的多样性不受特定任务限制。

- 兼容性与扩展性:完美兼容SD1.5衍生模型,技术架构支持未来扩展到全身或半身构图的应用场景。

HelloMeme的技术原理

- 空间编织注意力(Spatial Knitting Attentions):创新性地优化2D特征图注意力机制,采用先处理行注意力再处理列注意力的方式,有效保留空间结构信息。

- 模块化设计:系统由三大核心模块构成:

- HMReferenceNet:专门用于从参考图像提取高精度特征。

- HMControlNet:负责编码头部姿态和面部表情信息。

- HMDenoisingNet:整合前两个模块的特征,实现可控的去噪生成过程。

- 解耦控制信息:采用分离编码策略处理头部姿态和面部表情信息,通过SKCrossAttention机制实现高效融合,显著提升信息表达能力。

- 视频生成流程:采用两阶段生成策略确保视频连贯性,先生成基础视频帧,再通过再噪声化和运动模块优化输出平滑视频。

HelloMeme的项目地址

- 项目官网:songkey.github.io/hellomeme

- GitHub仓库:https://github.com/HelloVision/HelloMeme

- arXiv技术论文:https://arxiv.org/pdf/2410.22901

- 在线体验Demo:https://www.modelscope.cn/studios/songkey/HelloMeme

HelloMeme的应用场景

- 社交媒体内容创作:助力用户快速生成个性化表情包和趣味视频,大幅提升社交媒体互动体验。

- 视频娱乐与游戏:为游戏和虚拟现实场景创建逼真角色动画,打造沉浸式用户体验。

- 电影和视频制作:简化影视制作流程,通过AI生成角色表情动作,显著降低拍摄成本。

- 广告与营销:制作富有创意的动态广告内容,有效吸引消费者注意力并增强品牌记忆。

- 教育与培训:开发生动有趣的教学视频,使知识传递过程更加直观高效。

HelloMeme凭借其创新技术架构和广泛适用性,正在重塑动态内容创作方式,为多个领域带来革新体验。

相关标签:

Diffusion

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

MCP (Model Context Protocol) 技术理解 - 第六篇

04/18

LangChain v0.3 ReAct Agent 原理浅析

04/18

单实例多MCP聚合服务:两种实现方案深度对比

04/18

D2C 的另一种选择—Figma MCP + Claude Code

04/18

第 4 章:工具调用基础——让 LLM 走出“缸中之脑”

04/18

从n8n到Claude Skills:轻松搞定小红书热门美食手账,3分钟出图,小白也能会!

04/18

OpenClaw 入门实战:5分钟搭建你的自托管 AI 助手

04/18

uv × pyseekdb:把 RAG 环境与检索落地成本降到最低

04/18

1美元雇佣顶级架构师?MiniMax M2.5要把Agent价格打穿

04/18

别再用 ID 定位了!教你用"语义指纹"实现 99% 的元素定位成功率

04/18

AI精选