教程上新丨基于500万小时语音数据,Qwen3-TTS实现3秒语音克隆及精细调控

作者:互联网

2026-04-15

当生成式 AI 不再局限于「生成文字」,而是开始真正「发出声音」,语音就从信息通道升级为可编程、可塑造的表达媒介。从跨语种内容创作到实时语音助手,从虚拟主播到沉浸式交互系统,文本转语音(TTS)正在成为多模态模型体系中的核心一环。但要让机器说得自然、稳定、可控,并在流式场景下保持毫秒级响应,背后考验的不只是声学建模能力,更是架构设计与系统优化的综合实力。

在这一技术演进路径上,新一代模型开始尝试突破传统 TTS 的边界——不仅追求更高保真度,还强调多语言泛化能力与精细化控制能力。由 Qwen 团队日前开源的 Qwen3-TTS 便是基于双轨语言模型(LM)架构,在实时语音合成的同时,也可对输出语音进行细粒度调控。

具体而言,Qwen3-TTS 支持 3 秒语音克隆与基于描述的语音控制,其在覆盖 10 种语言、总计超过 500 万小时的语音数据上进行训练,同时还配备两种语音分词器(speech tokenizer):

*** Qwen-TTS-Tokenizer-25Hz:** 采用单码本(single-codebook)编解码器,侧重语义内容表达,可与 Qwen-Audio 无缝集成,并通过基于分块(block-wise)的 DiT 实现流式波形重建。

*** Qwen-TTS-Tokenizer-12Hz:** 实现极致码率压缩与超低延迟流式输出,基于 12.5Hz、16 层多码本设计以及轻量级因果卷积网络(causal ConvNet),可实现 97 毫秒的首包即时输出。

大量实验结果表明,该系列模型在 TTS 多语言测试集、InstructTTSEval 等多项客观与主观基准测试中,均达到 SOTA 水平。

目前,「Qwen3-TTS:高质量可控多语言语音合成 Demo」已上线 OpenBayes 官网的教程版块,点击下方链接即可体验一键部署教程 ⬇️

教程链接:

go.openbayes.com/O0oKE

Demo 运行

01

Demo 运行阶段

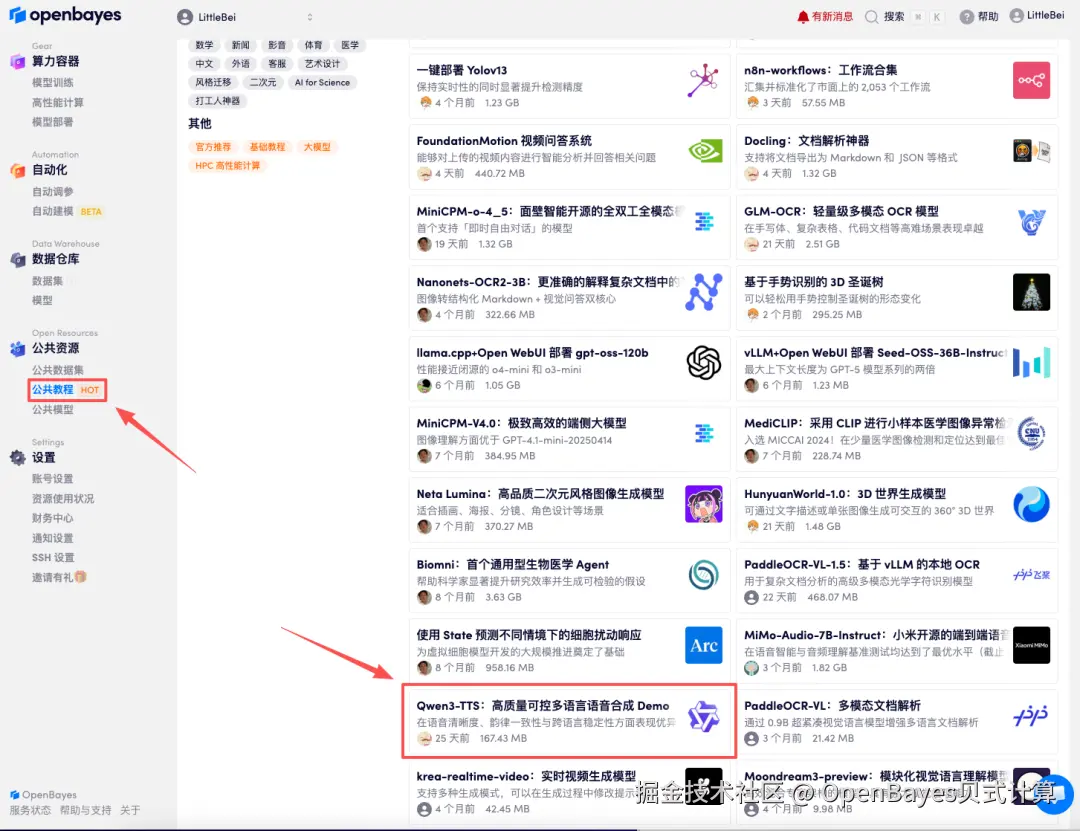

1.登录 OpenBayes.com,在「公共教程」页面,选择「Qwen3-TTS:高质量可控多语言语音合成 Demo」教程。

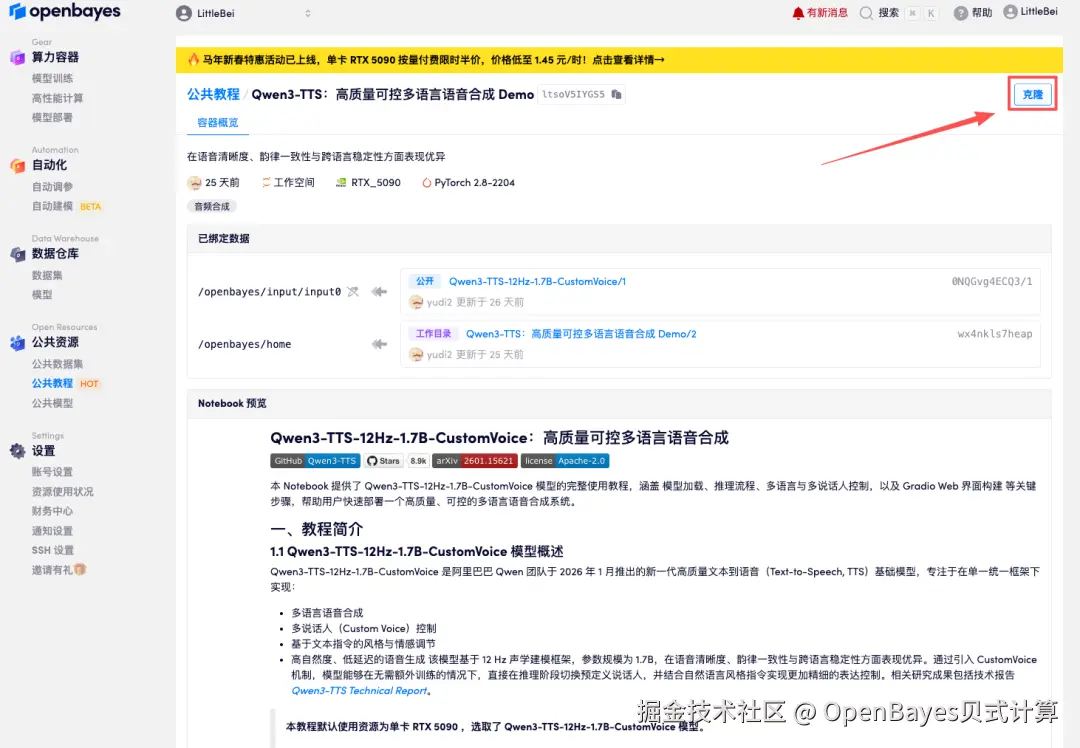

2.页面跳转后,点击右上角「克隆」,将该教程克隆至自己的容器中。

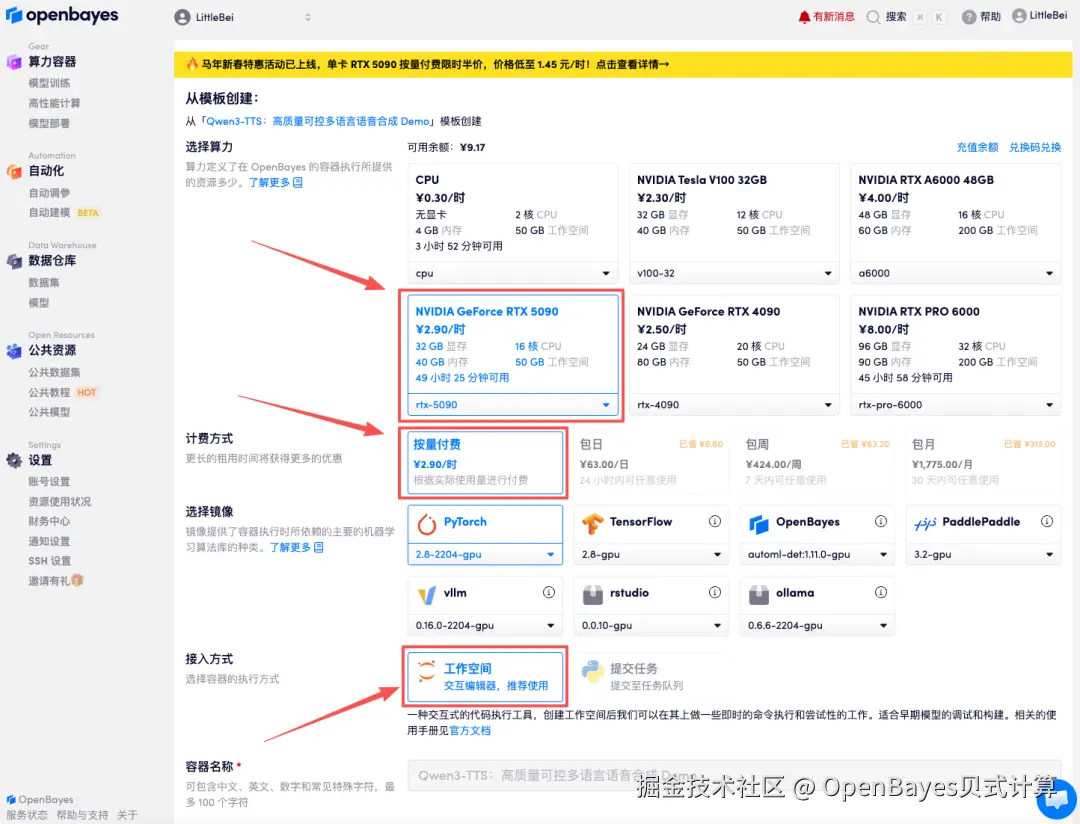

3.选择「NVIDIA GeForce RTX 5090」以及「PyTorch」镜像,按照需求选择「按量付费」或「包日/周/月」,点击「继续执行」。新用户使用下方邀请链接注册,即可获得满 ¥10 赠 ¥10 优惠券,更有机会获得 ¥15 赠金!

小贝总专属邀请链接(直接复制到浏览器打开):

go.openbayes.com/9S6D******r

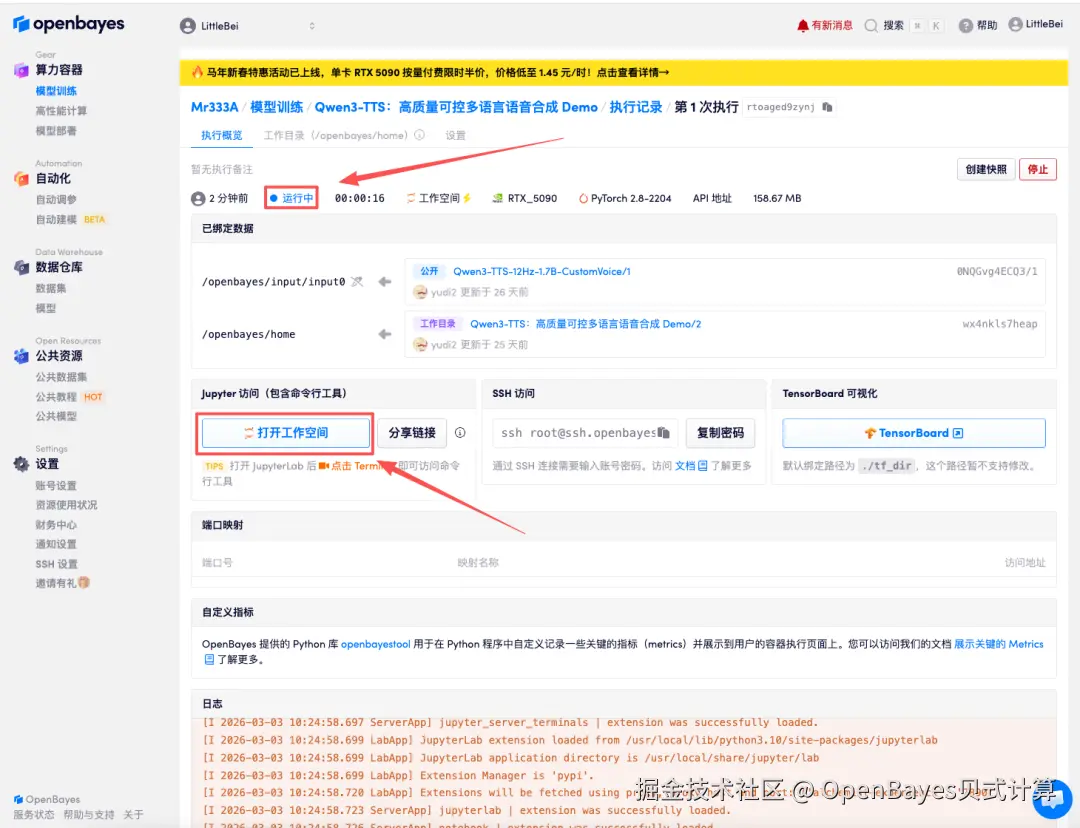

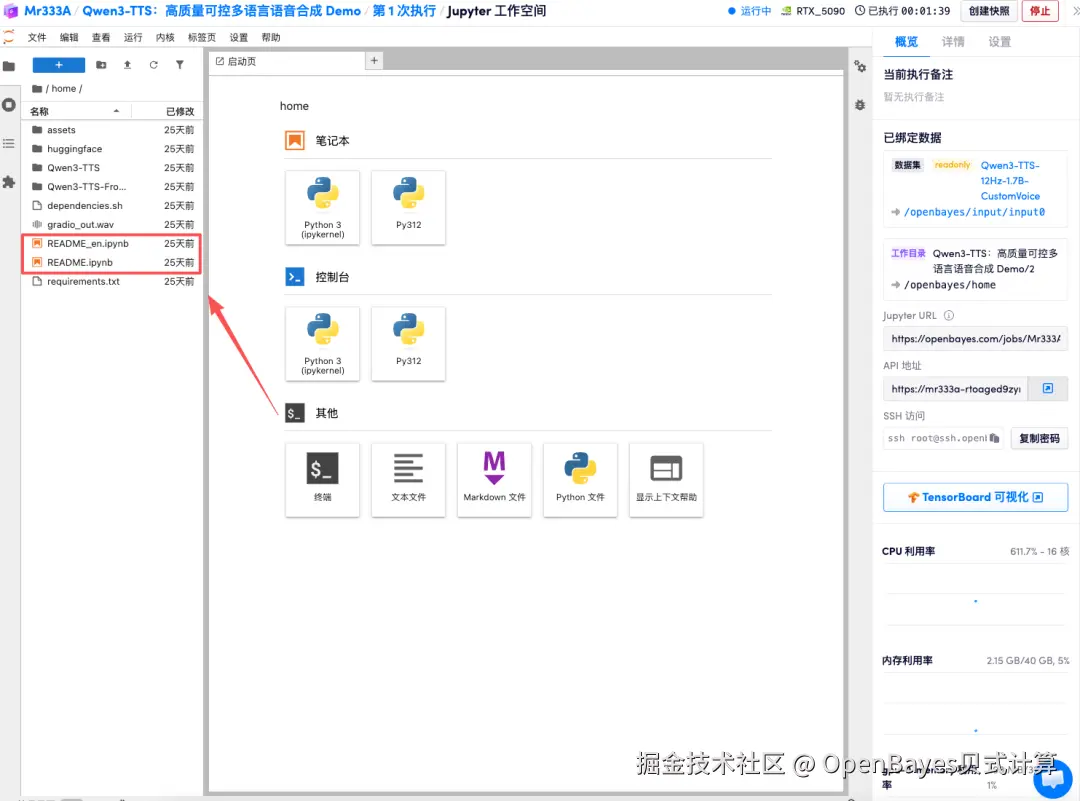

4.等待分配资源,当状态变为「运行中」后,点击「打开工作空间」进入 Jupyter Workspace。

02

效果演示

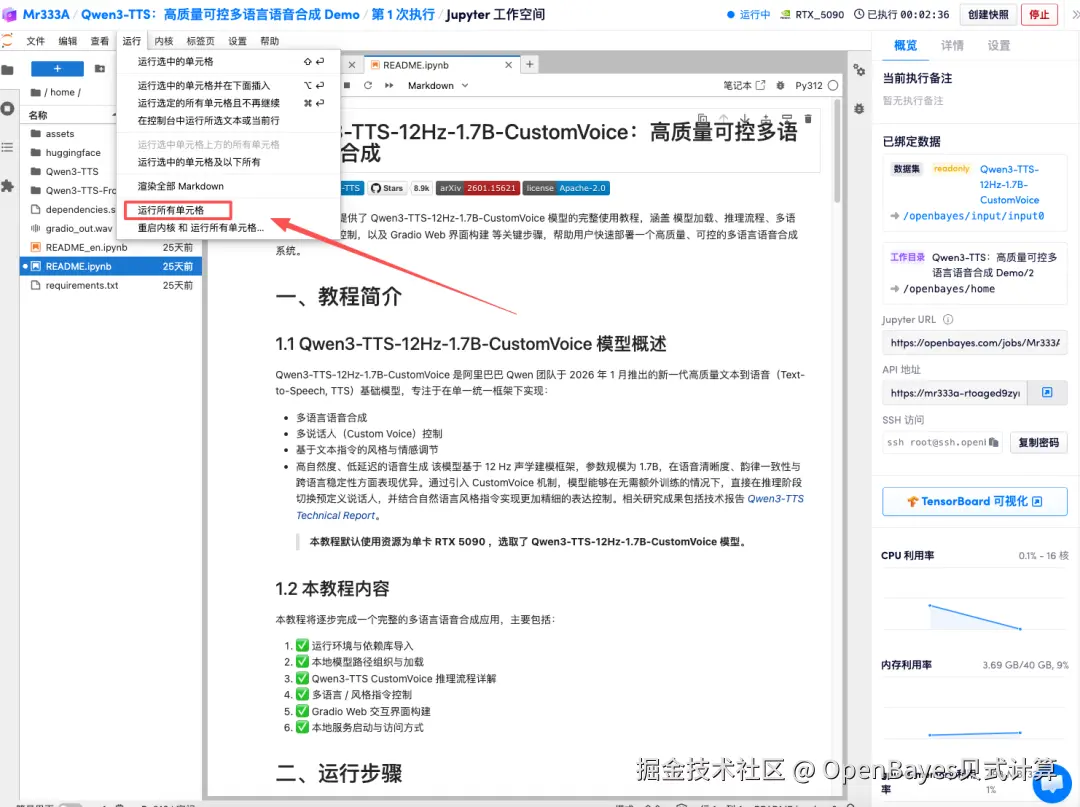

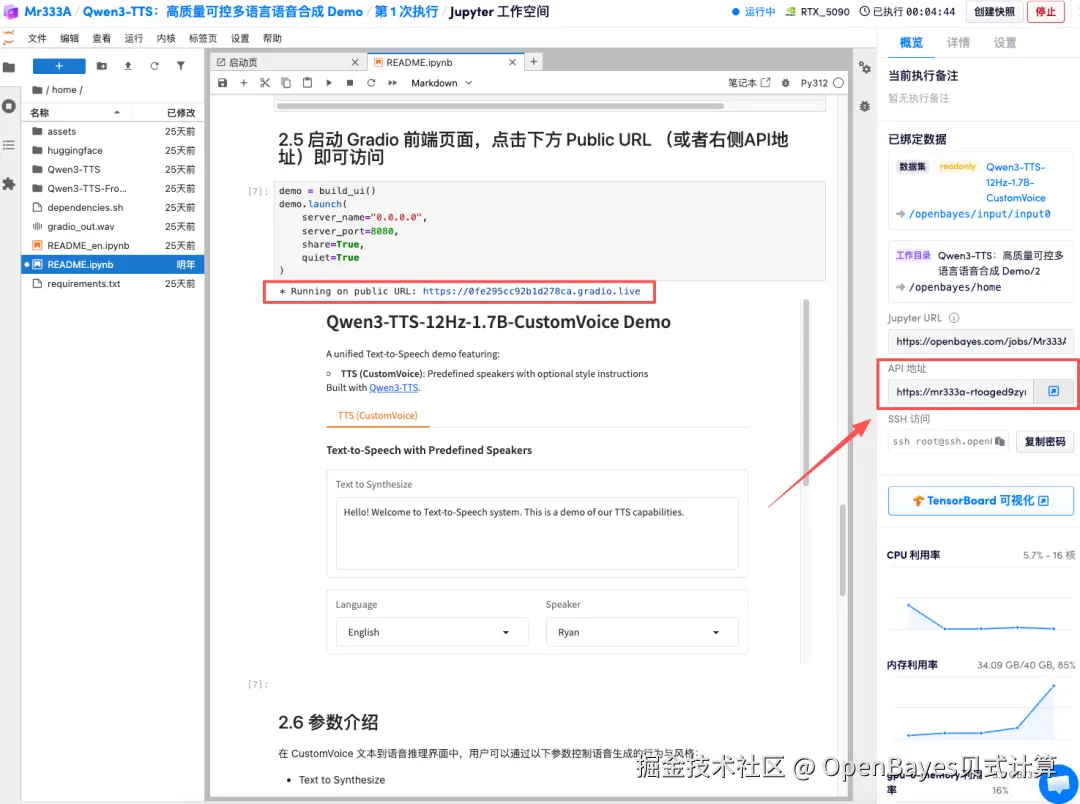

页面跳转后,点击左侧 README 页面,进入后点击上方「运行」。

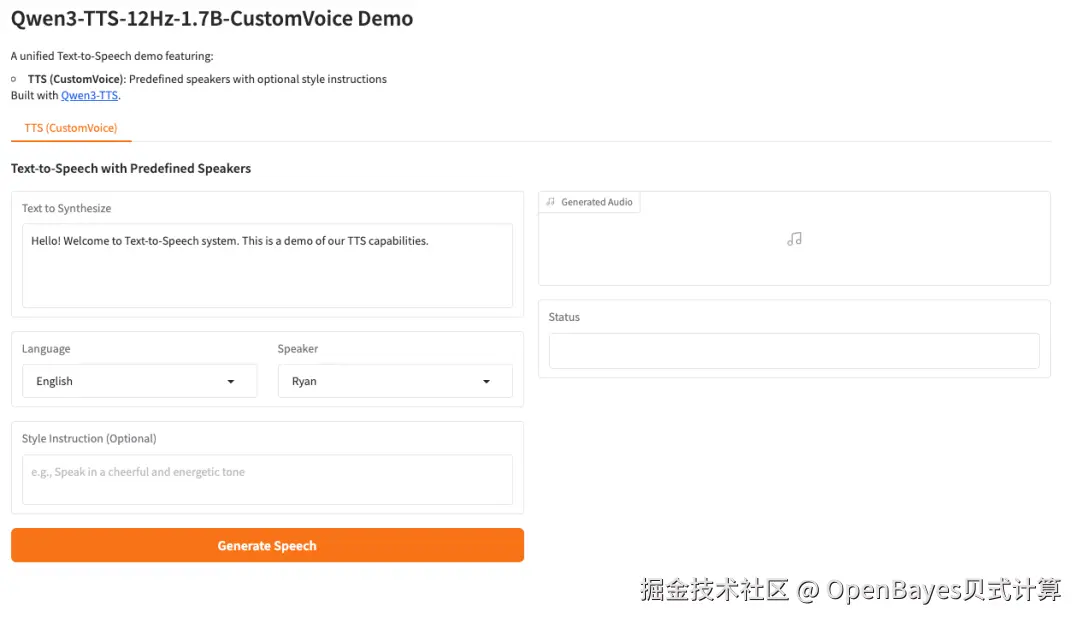

待运行完成,即可点击右侧 API 地址跳转至 demo 页面。

教程链接:

go.openbayes.com/O0oKE

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

Function Call 和 MCP 的区别(举例子,一文说明白)

一天一个开源项目(第6篇):SuperClaude Framework - 增强 Claude Code 的专业配置框架

AI Agent 框架探秘:拆解 OpenHands(4)--- 服务

DeepMind:智能体越多越乱,Agent天花板出现了?

我把 Claude Code 搬进了 Slack,从此蹲坑也能 Vibe Coding

LangChain DeepAgents 速通指南(一)—— 一文详解DeepAgents核心特性

JustGRPO:扩散语言模型的极简主义回归

AI 驱动的 Web 调试新范式:让编码智能体直接“看”懂你的浏览器

一文讲透 MCP 和 Skills 的分工与协作

喂饭级教程!免费部署云端 OpenClaw + 打通飞书,自动抓取 ClawHub 技能并写入飞书表格

AI精选