微软Edge浏览器Copilot综合能力测试报告PDF版

作者:互联网

2026-03-23

微软Edge浏览器的Copilot功能在多项任务测试中展现出独特优势,郎瀚威团队通过8类场景评估揭示其响应速度突出但复杂任务处理受限的特点。本次报告将详细解析Copilot与主流AI工具的实际表现差异。

测试目标

本次测评聚焦微软Edge浏览器Copilot的核心能力,选取信息检索、报告生成等典型场景,通过与OpenAI Agent等主流AI工具对比,系统评估其响应效率、输出质量等关键指标。测试旨在为不同应用场景的用户提供客观的选型依据。

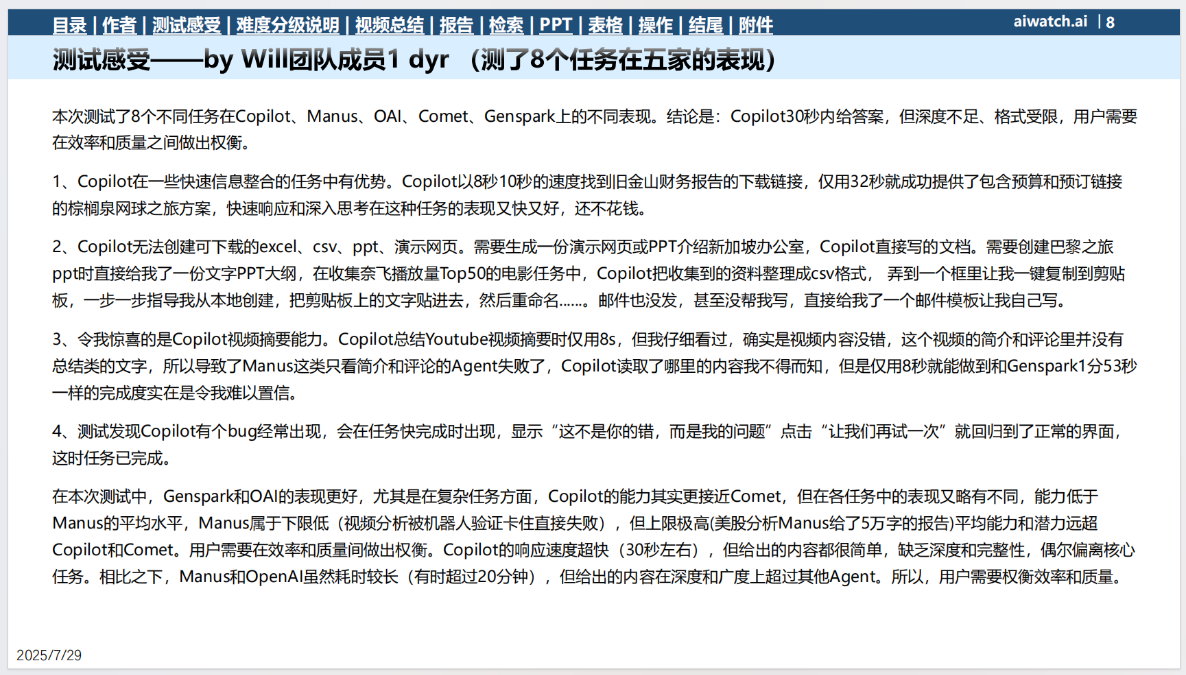

测试感受

实测发现Copilot在信息检索任务中仅需8秒即可完成旧金山财务报告查找,平均响应时间26秒的优势显著。但在PPT生成等复杂任务中暴露出功能缺陷,无法导出可编辑文件且内容深度不足。相比Manus生成5万字专业报告的能力,Copilot更适合对时效要求高但内容深度要求低的场景。

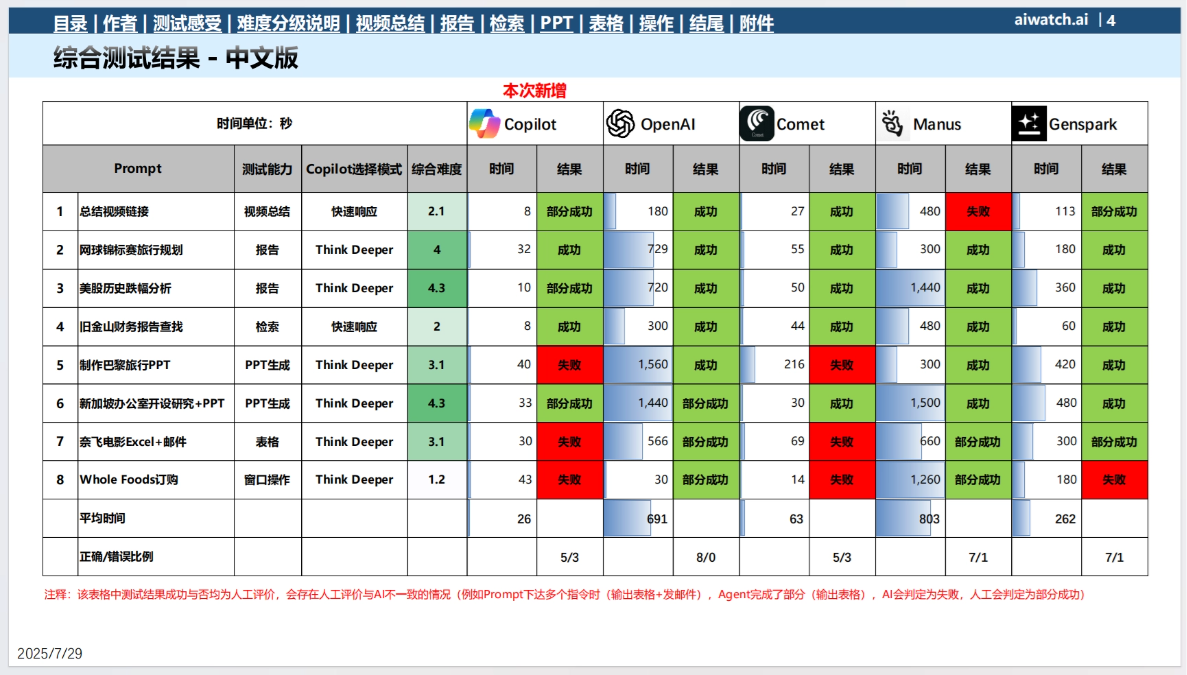

综合测试结果

测试任务与结果

- 视频总结

- 任务:总结视频内容并提取链接。

- 结果:Copilot耗时8秒,部分成功(提取链接不准确)。

- 对比:OpenAI和Comet表现更优。

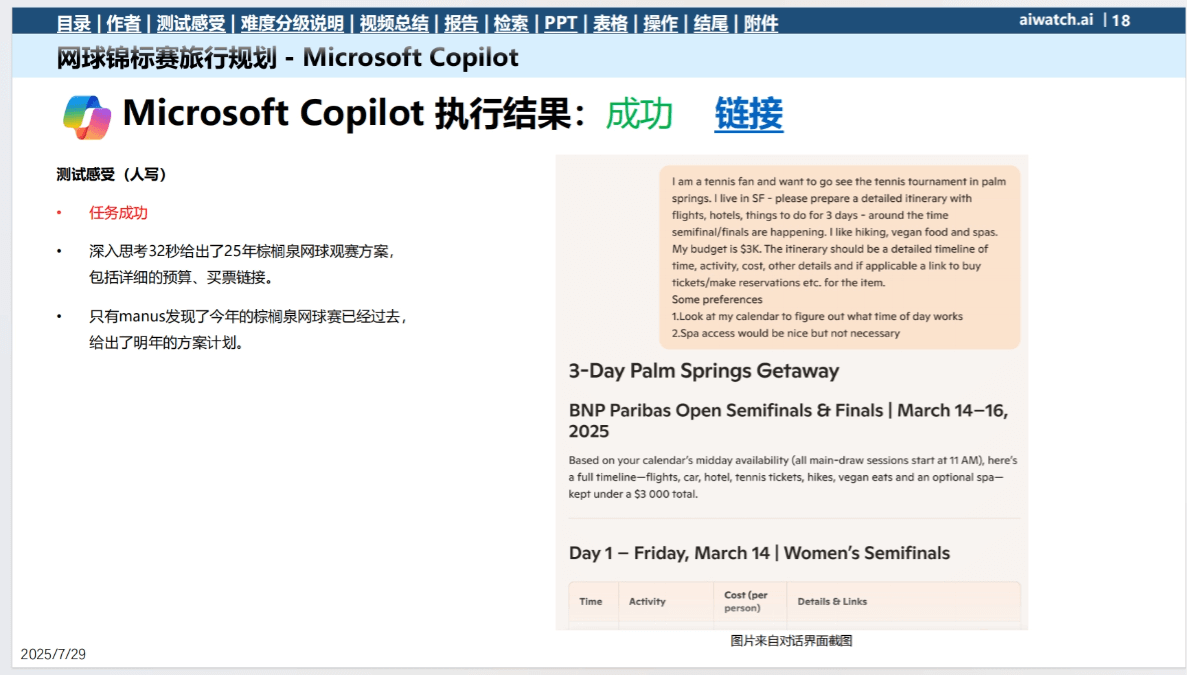

- 网球锦标赛旅行规划

- 任务:制定详细行程(航班、酒店、活动)。

- 结果:Copilot耗时32秒,成功但预算预估偏低。

- 对比:Manus和Genspark提供更全面的方案。

- 美股历史跌幅分析

- 任务:分析美股历史跌幅事件及原因。

- 结果:Copilot耗时10秒,部分成功(信息简略)。

- 对比:Manus生成5万字报告,Genspark分析更详细。

- 旧金山财务报告查找

- 任务:查找2020-2024年财务报告。

- 结果:Copilot耗时8秒,成功提供有效链接。

- 对比:OpenAI和Manus表现更全面。

- PPT生成

- 任务:制作巴黎旅行PPT。

- 结果:Copilot失败(仅提供文字描述)。

- 对比:OpenAI、Manus、Genspark成功生成PPT。

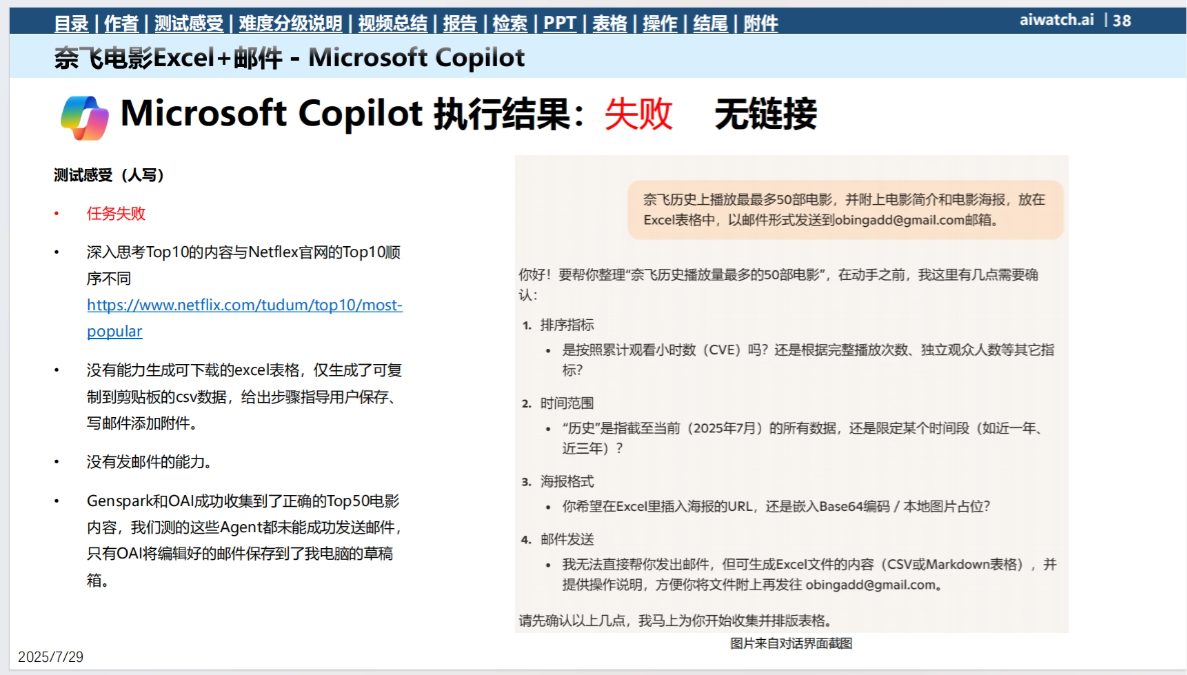

- 表格生成与邮件发送

- 任务:整理奈飞电影数据并发送邮件。

- 结果:Copilot失败(无法生成可下载表格或发送邮件)。

- 对比:其他工具部分成功但未完全执行邮件发送。

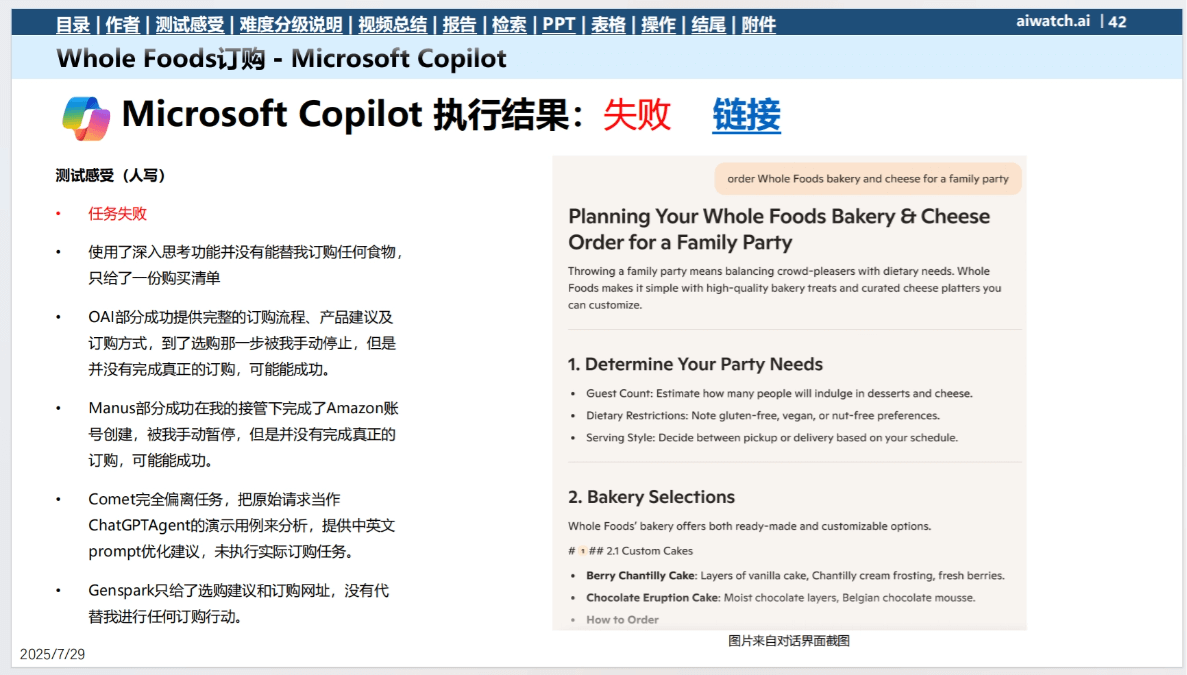

- 窗口操作(Whole Foods订购)

- 任务:订购食品。

- 结果:Copilot失败(仅提供清单,无法完成下单)。

- 对比:其他工具同样未能完成核心下单操作。

综合测试表明Copilot在响应速度上具有明显优势,但复杂任务处理能力有待提升。用户应根据实际需求,在效率与功能完整性之间做出合理选择。

相关标签:

办公自动化脚本

相关推荐