DeepSeek 开源进度 2/5:首个用于 MoE 模型训练和推理的 EP 通信库 DeepEP

作者:互联网

2026-03-24

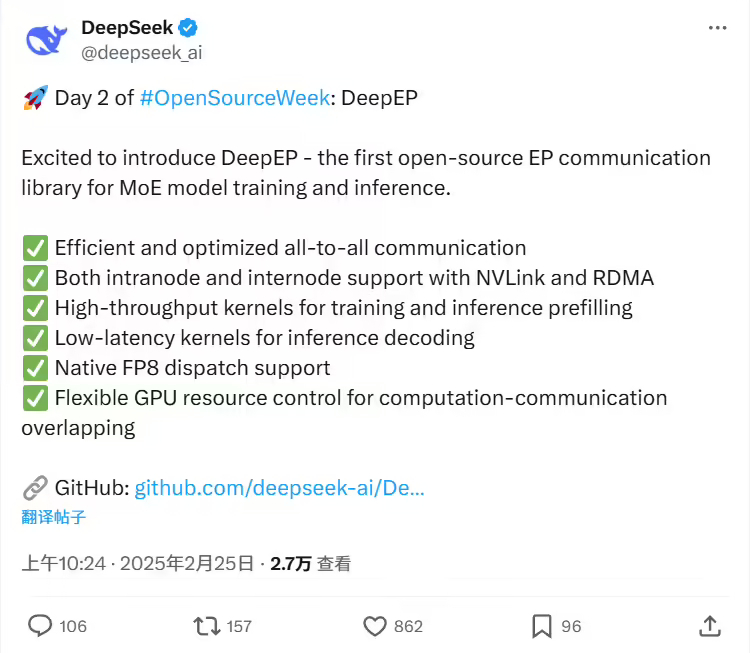

2 月 25 日消息,DeepSeek 的“开源周”活动今日已经来到第二天,今天发布的是首个开源的用于 MoE 模型训练和推理的 EP 通信库 ——DeepEP。

IT之家附开源地址:https://github.com/deepseek-ai/DeepEP

官方表示其具备如下特征:

- 高效优化的全到全通信方式

- 支持节点内外通信,兼容 NVLink 和 RDMA 技术

- 提供高吞吐量的内核,提升训练和推理前期填充效率

- 提供低延迟内核,优化推理解码速度

- 完全支持 FP8 数据格式调度

- 提供灵活的 GPU 资源管理,支持计算与通信的重叠执行

详细介绍的大意如下:

DeepEP 是一款专为混合专家(MoE)和专家并行(EP)设计的通信库,提供了高吞吐量和低延迟的 all-to-all GPU 内核,常用于 MoE 派发和合并操作。该库还支持低精度计算,包括 FP8。

为了与 DeepSeek-V3 论文中提出的组限制门控算法兼容,DeepEP 提供了一些针对不对称带宽转发优化的内核,比如将数据从 NVLink 域转发到 RDMA 域。这些优化的内核能够提供高吞吐量,适合用于训练和推理的预填充任务,同时支持 SM(流式多处理器)数量控制。

对于延迟敏感型的推理解码任务,DeepEP 提供了一套低延迟内核,采用纯 RDMA 技术以最大程度减少延迟。此外,该库还采用了一种基于 Hook 的通信与计算重叠方法,不会占用任何 SM 资源。

需求:

- Hopper GPUs (may support more architectures or devices later)

- Python 3.8 及以上版本

- CUDA 12.3 及以上版本

- PyTorch 2.1 及以上版本

- 使用 NVLink 进行节点间通信

- 基于 RDMA 网络的节点间通信

相关标签:

相关推荐

2026-04-17

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

一天一个开源项目(第23篇):PageLM - 开源 AI 教育平台,把学习材料变成互动资源

开源大模型涨价策略分析:Llama 3.5 与 GLM-5 的商业化博弈

每周AI论文速递(260209-260213)

anthropic-academy:RAG检索增强生成

90%程序员还在让 AI 补代码,1%已经在指挥 AI 军团

# 从 0 到 1:**黎跃春**详解 AI 智能体运用工程师的工程化方法

Memo Code 安全设计:子进程、命令防护与权限审批的统一方案

Samba WINS 漏洞利用与防御全解析

拒绝“盲盒式”编程:规范驱动开发(SDD)如何重塑 AI 交付

ComfyUI 的缓存架构和实现

AI精选