Thin Harness, Fat Skills:AI工程架构的本质

作者:互联网

2026-04-18

Garry Tan在YC内部倡导的智能体工程三原则,本质上是对Unix哲学"do one thing well"的现代演绎。当行业还在争论模型参数量时,真正的100x工程师已经在实践这套架构原则。

Steve Yegge说使用AI编码智能体的人"比今天使用Cursor和聊天的工程师生产力高10-100倍,比2005年的谷歌员工高约1000倍"。

这个数字是真实的,但人们往往归因于错误的解释:更好的模型、更聪明的Claude、更多参数。

实际上,2倍和100倍的人使用的是相同的模型。

差异不在于智能,而在于架构。

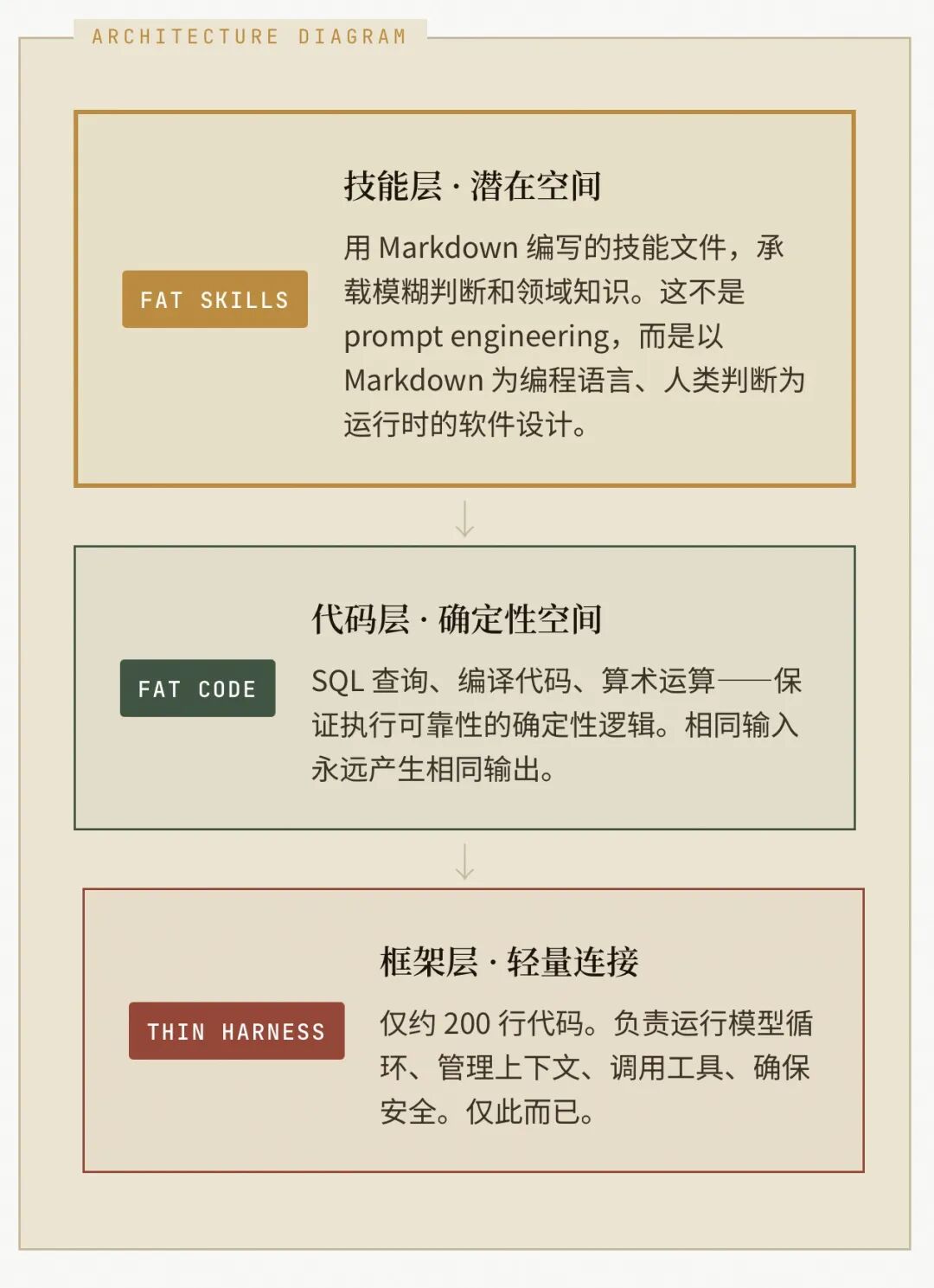

架构分层的本质

Fat Skills层:用Markdown编写的技能文件,承载模糊判断和领域知识。这不是prompt engineering,而是用markdown作为编程语言,人类判断作为运行时的软件设计。

一个技能文件就像一个方法调用。它接受参数,用不同的参数调用时,相同的程序会产生完全不同的能力。

考虑一个名为/investigate的技能,它有七个步骤:确定数据集范围、构建时间线、对每个文档进行日记化、综合、论证双方观点、引用来源。它接受三个参数:TARGET、QUESTION和DATASET。将其指向安全科学家和210万封发现邮件,你会得到一个医学研究分析师确定举报人是否被压制。将其指向空壳公司和FEC文件,你会得到一个法证调查员追踪协调的竞选捐款。

Fat Code层:确定性逻辑的代码实现,保证执行可靠性。SQL查询、编译代码、算术运算——这些应该永远留在确定性空间。

Thin Harness层:仅200行代码的轻量框架,负责基础连接。它的工作就是运行模型循环、管理上下文、调用工具、确保安全。

反模式是带有薄技能的厚约束。你见过:40多个工具定义吃掉一半上下文窗口。具有2-5秒MCP往返的全能工具。将每个端点变成单独工具的REST API包装器。三倍的令牌、三倍的延迟、三倍的失败率。

相反,你需要的是快速且狭窄的专用工具。一个每个浏览器操作只需100毫秒的Playwright CLI,而不是需要15秒进行截图-查找-点击-等待-读取的Chrome MCP。这快75倍。软件不再需要珍贵。构建你需要的,仅此而已。

技能文件的进化特性

YC创始人活动反馈系统的案例显示:

初始版本12%的"还好"评分技能文件自动分析模式后,下次活动降至4%关键改进被固化到Markdown技能文件中这种设计使得每个技能文件都是永久升级。凌晨3点仍能自动运行,新模型发布时所有技能自动受益。

Chase Center,2026年7月。六千名创始人参加创业学校。每个人都有结构化申请、问卷答案、1对1顾问聊天记录,以及公开信号:X上的帖子、GitHub提交、显示他们发货速度的Claude Code记录。

传统方法:15人的项目团队阅读申请,凭直觉判断,更新电子表格。在200名创始人时有效。在6000名创始人时崩溃。没有人能记住那么多档案,并注意到AI代理基础设施队列的三个最佳候选人是拉各斯的开发工具创始人、新加坡的合规创始人和布鲁克林的CLI工具创始人——他们在1对1聊天中用不同词语描述了相同的痛点。

模型可以。方法如下:

丰富化:一个名为/enrich-founde的技能拉取所有来源,运行丰富化,进行日记化,并突出创始人说的内容和他们实际构建的内容之间的差距。确定性层处理SQL查找、GitHub统计、演示URL的浏览器测试、社交信号拉取、CrustData查询。一个cron每晚运行。六千个档案,始终保持新鲜。

日记化输出捕捉到关键词搜索找不到的东西:

FOUNDER: Maria Santos COMPANY: Contrail (contrail.dev) SAYS: "AI代理的Datadog" ACTUALLY BUILDING: 80%的提交在计费模块。她正在构建一个伪装成可观察性的FinOps工具。

那个差距——"说"与"实际构建"——需要阅读GitHub提交历史、申请和顾问记录,并同时记住所有三个。没有嵌入相似性搜索能找到这个。没有关键词过滤器能找到它。模型必须阅读完整档案并做出判断。(这是放在潜在空间的完美决策!)

社区讨论

开发者ByteCrafter的观察很有代表性:"我们花了数周构建复杂框架,后来发现智能体在与框架对抗而非协作。简化成上下文加载器后,效率直线上升"

Sam Ward团队的方案更彻底:智能体的全部"智能"来自启动时加载的Markdown,框架仅负责连接模型和工具。升级时只修改Markdown,不动代码。

forgedynamicsai评论道:"这立即就明白了。我最终几乎到达了相同的地方:薄的LangGraph约束,厚的剧本,无情的潜在与确定性分离。CFO = 纯Python用于信任。顾问 = 潜在判断 + 用于综合的记忆。复合部分是真正的解锁:每周运行 → 结果 → 校准 → 剧本变得更好。你抓住了架构。"

边界迁移现象

Claudia在讨论中指出一个有趣现象:确定性代码需要上下文判断时,会自然迁移到技能层。当开发者不再抗拒这种迁移,架构就会趋于稳定。

这解释了为什么Garry Tan强调"在正确的层做正确的事"。他在开源项目gstack中展示了如何用200行CLI框架支撑23种专业角色。

每个步骤在你的系统中属于以下两类之一,混淆它们是代理设计中最常见的错误。

潜在空间是智能所在的地方。模型阅读、解释、决定。判断。综合。模式识别。

确定性是信任所在的地方。相同的输入,相同的输出。每次都是。SQL查询。编译代码。算术。

一个LLM可以为8个人安排晚餐座位,考虑个性和社交动态。要求它为800人安排座位,它会幻觉出一个看起来合理但完全错误的座位表。这是一个确定性问题——组合优化——被强制放入潜在空间。最差的系统将错误的工作放在这条线的错误一侧。最好的系统对此毫不留情。

工程纪律的价值

Garry制定的铁律直击本质:

如果同一件事问智能体两次就算失败

需要重复的工作必须先手动跑3-10个样本

批准后固化为技能文件或cron任务这种纪律带来的复利效应,比追求更聪明的模型更有价值。当整个行业还在争论模型参数量时,真正的100x工程师已经在实践这套架构原则。

ChaiBytesAI指出:"没有人谈论的日记化部分是它也是你构建复合知识的方式。每次代理跨来源阅读并做出判断时,该输出就成为下一次运行的上下文。代理不仅仅是调查,它在调查方面变得更好。我在为客户风险构建AI代理时看到了这一点。第一次跨账户数据库、票据和代码运行是缓慢而广泛的。但系统学会了对该特定客户重要的模式,每次后续运行都变得更敏锐。这就是厚技能的真正解锁。它们不仅仅是可重用的,它们会复合。"

系统会自我强化。构建一次,永远运行。

正如Garry Tan所说:"我最近发给我OpenClaw的一条指令引起的共鸣超出了我的预期:一千个赞和两千五百个书签。人们认为这是一个提示工程技巧。它不是。这是我一直在描述的架构。你写的每个技能都是对你系统的永久升级。它永远不会退化。它永远不会忘记。它在凌晨3点你睡觉时运行。当下一个模型发布时,每个技能立即变得更好——潜在步骤中的判断改进,而确定性步骤保持完美可靠。"

本文转载自AI工程化,作者:winkrun

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

Qwen3.6 正式发布!阿里云百炼同步开启“AI大模型节省计划”超值优惠

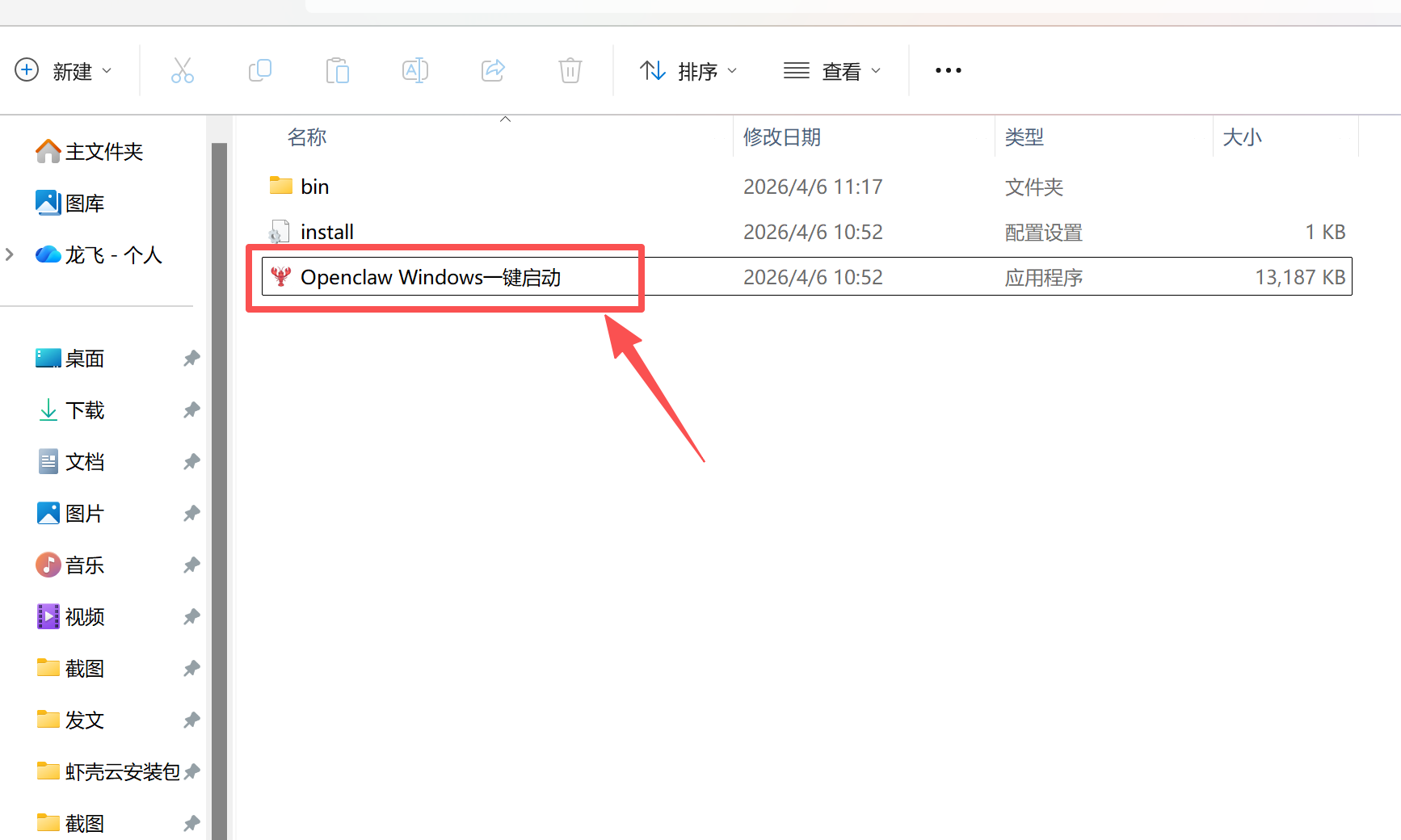

【新手零难度操作 】OpenClaw 2.6.4 安装误区规避与快速使用指南(包含最新版安装包)

OpenClaw 2.6.4 可视化部署 打造个人 AI 数字员工(包含最新版安装包)

【小白友好!】OpenClaw 2.6.4 本地 AI 智能体快速搭建教程(内有安装包)

零基础部署 OpenClaw v2.6.2,Windows 系统完整教程

【适合新手的】零基础部署 OpenClaw 自动化工具教程

开发者们的第一台自主进化的“爱马仕”来了

极简部署 OpenClaw 2.6.2 本地 AI 智能体快速启用(含最新版安装包)

代码通过即拿奖!OpenCloud 40+超热门AI工具等你来贡献

星动纪元、地平线等8家具身智能加入,RoboChallenge 打造全球最大规模具身模型评测体系

AI精选