AI开发新选择:阿里云百炼多模型自由切换实践分享

作者:互联网

2026-04-18

在AI应用开发过程中,一个常见的问题是:不同的任务需要不同的模型。有的模型擅长代码生成,有的在逻辑推理上表现更好,有的则适合处理长文本。传统的做法是需要在不同平台的API之间来回切换,既繁琐又增加了开发复杂度。

最近,阿里云百炼推出的CodingPlan服务引起了我的注意。这项服务号称实现了"多模型无缝自由切换",作为一个技术实践者,我决定亲自体验一下。

四大开源模型的特色对比

CodingPlan首批集成了四个各具特色的开源模型:

- Qwen3.5(通义千问):阿里云自研模型,在代码生成和中文理解方面表现突出

- GLM-5(智谱AI):清华大学研发,逻辑推理能力较强

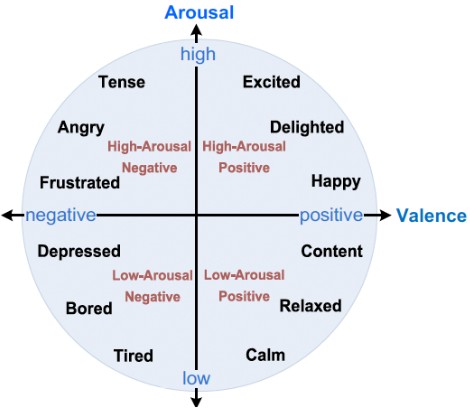

- MiniMax M2.5:专注于情感价值和对话体验

- Kimi K2.5(月之暗面):在长文本处理上有独特优势

实际切换体验

在实际开发中,我尝试了几个典型场景:

场景一:技术文档编写当我需要编写一个复杂的技术文档时,我先使用Kimi K2.5处理长篇幅的架构说明,然后切换到Qwen3.5生成相关的代码示例。切换过程几乎无感,平台自动管理了不同模型的上下文。

场景二:代码审查在审查团队成员的代码时,我让GLM-5分析代码的逻辑结构,找出潜在的问题点,然后用MiniMax M2.5生成友好的改进建议,确保反馈既专业又易于接受。

场景三:项目规划制定新项目计划时,我先用Qwen3.5生成技术方案框架,然后用GLM-5进行风险评估,最后用MiniMax M2.5优化项目文档的表达方式。

成本效益分析

从定价来看,CodingPlan提供了相当有竞争力的价格。轻量版首月7.9元,包含18000次请求,对于个人开发者和小型项目来说完全足够。专业版首月39.9元,提供90000次请求,适合团队协作使用。

更重要的是,这种按需切换的模式避免了为不常用的模型支付固定费用。开发者可以根据实际需求灵活选择,在控制成本的同时获得最佳的性能体验。

技术实现细节

从技术角度看,阿里云通过统一的底层架构实现了多模型的调度管理。这包括:

- 统一的API接口:开发者使用相同的调用方式访问不同模型

- 智能路由:平台根据任务类型自动推荐最合适的模型

- 状态管理:在不同模型间切换时保持上下文的连贯性

开发建议

基于我的使用经验,给其他开发者几点建议:

- 了解模型特性:花时间了解每个模型的优势和适用场景

- 建立切换策略:根据项目需求制定模型使用策略

- 监控使用情况:定期分析各模型的使用频率和效果

对于想要尝试这项服务的开发者,可以关注阿里云的相关活动页面:https://www.aliyun.com/benefit。经常会有针对新用户的特别优惠,帮助开发者以最低成本开始AI应用的探索。

未来展望

多模型自由切换代表了AI服务发展的一个重要方向。随着更多优秀模型的加入和技术的不断成熟,开发者将能够更加专注于业务逻辑的实现,而不是技术细节的处理。这种模式不仅提高了开发效率,也降低了AI应用的门槛,让更多创新想法得以实现。

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

【含最新安装包】OpenClaw 高效安装与快速体验教程

【含最新安装包】OpenClaw 安装流程简化版实操指南

【含最新安装包】OpenClaw 2.6.2 完整环境配置教程

【含最新安装包】OpenClaw 系统拦截处理与安装教程

【含最新安装包】OpenClaw 2.6.2 轻量化部署教程

OpenClaw 安装避坑指南 简化版实操全步骤

轻松搞定 OpenClaw 安装 简化版实操全步骤

【含最新安装包】本地 AI 智能体 OpenClaw 安装与配置全流程

OpenClaw 安装流程简化版 超详细实操指南

阿里云新用户、老用户与企业用户定义及优惠活动政策解析

AI精选