我用Claude加OpenClaw打造永不休息的技术支持分身

作者:互联网

2026-03-24

在技术支持领域摸爬滚打过的同行,对这样的场景再熟悉不过——海量技术咨询如潮水般涌来,而解答效率却始终跟不上问题增长的速度。

通过将资深工程师的经验结构化赋能AI,我们实现了技术支持效率的质的飞跃。这不仅解决了人力瓶颈问题,更构建了一套可沉淀、可迭代的知识运营体系,为技术团队提供了全新的生产力解决方案。

如果你做过技术支持,这画面一定不陌生。

我是 Landy,Zadig 的创始人 。我们是做企业级服务的,开源客户安装量 5000+,生产客户上百家。

技术服务这件事,做过的都懂:不是人干的。

我们的客户遍布金融、汽车、互联网。每天,各种问题飞进我们的飞书群:

- 「工作流怎么配置?」

- 「Pod 又 Crash 了,快帮我看看」

- 「GitLab 集成配不通,救命」

- 「升级到 v4.2 需要注意什么?」

这些问题分散在几十个群里,每一个都需要工程师:

- 理解背景

- 查文档

- 翻源码

- 给方案

一个资深工程师一天能高质量回复的问题,是有上限的。但问题的增长速度,远超人力扩展。

更扎心的是——知识流失。

一个问题今天解答了,下周另一个客户问同样的问题,又得从头来一遍。聊天记录里东一句西一句,根本没法复用。

我们团队几个人,天天被淹没在「帮忙看一下」「这个怎么配」的消息里。

我们就想:能不能把一个资深工程师的能力「克隆」出来?

市面上 AI 客服产品都是 RAG 套路:

对于「密码怎么重置」这种 FAQ 问题,确实能答。

但 RAG 对 Zadig 这种复杂系统根本不够用。

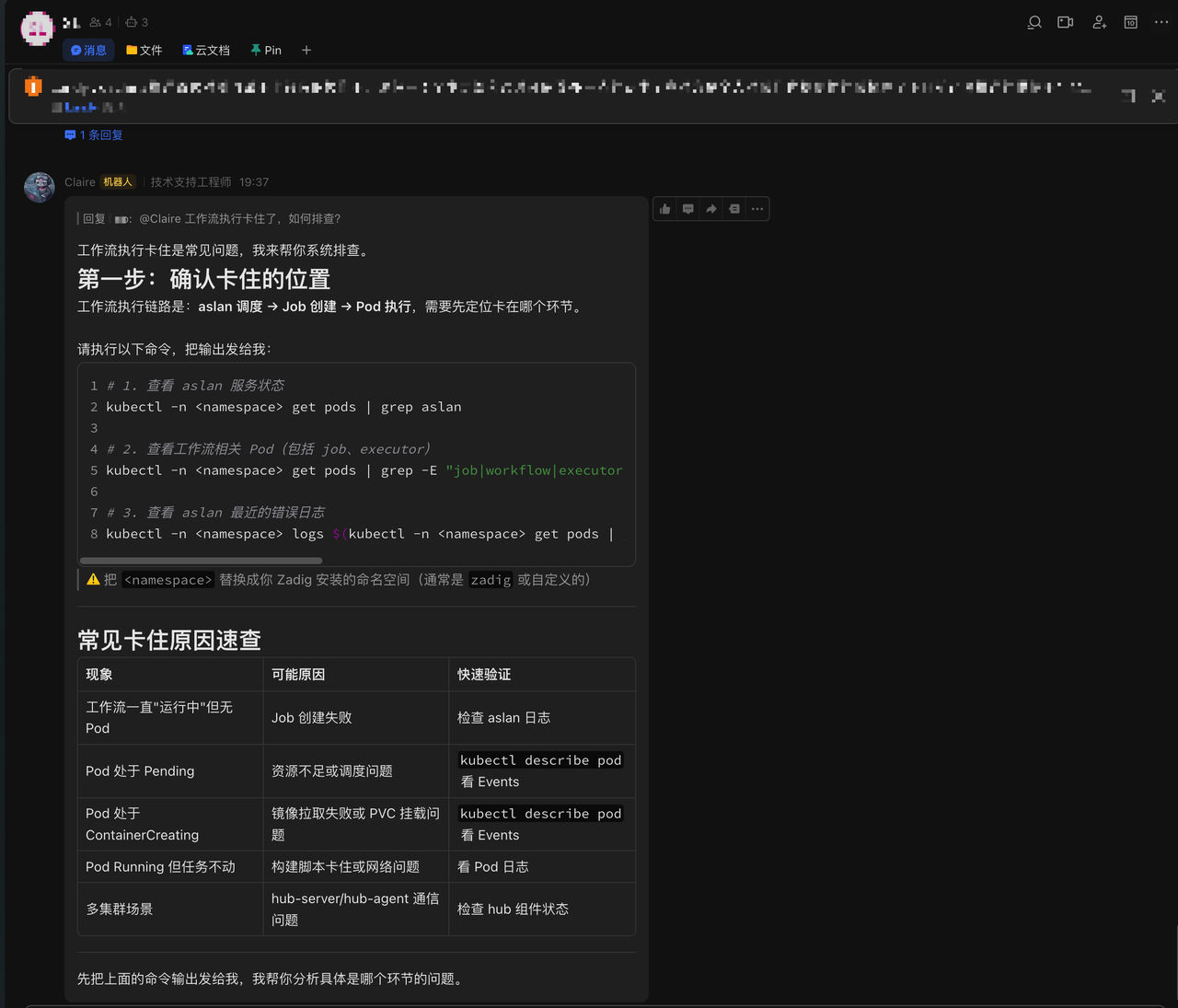

场景一:工作流卡住了

用户说「工作流执行卡住了」——

❌ RAG AI:

✅ 实际问题:

场景二:报错日志

用户甩给你一行错误日志——

❌ RAG AI:

✅ 实际问题:

根本问题: Zadig 是一个有十几个微服务、几十万行 Go 代码、涉及 K8s/Helm/Docker 的复杂系统。

- 文档只能告诉你「正常用法」

- 但故障永远发生在「文档没写的边缘情况」

我们需要的是一个「真正能读懂代码的 AI 工程师」。

OpenClaw 是一个开源的 AI Agent 框架——对,就是那个最近很火的「小龙虾」uD83EuDD9E

它最打动我的点是:把 AI 变成一个常驻的、有身份的、有记忆的「数字员工」,直接嵌入工作流。

- 接到飞书、Slack、T@elegrimm

- 文件系统级知识管理

- 记忆能力

- 支持定时任务

这不就是我们需要的吗?

我们给这个 AI 起名叫 Claire。

不是随便起的。我们给了她完整的身份定义、行为准则和工作方式——就像一个新入职的工程师,有自己的「人设」。

她不是文档搜索引擎

Claire 的工作流程:

- 先去读源码 — 找到相关微服务,从 API handler 追踪到核心逻辑,读懂完整流程

- 交叉验证文档 — 对照官方文档确认设计意图,如果发现文档与源码不一致,主动告知用户

- 给出精准诊断命令 — 因为理解代码,知道该看哪个组件的日志、grep 什么关键词

- 分析运行时数据 — 用户执行命令后反馈输出,Claire 结合源码进行深度分析

举个真实的例子

用户报告:「工作流执行卡住了」

❌ 以前的 AI 客服:

✅ Claire:

最终定位:资源配额不足导致构建 Pod 无法调度。从提问到定位根因,5 分钟。

每个 AI 对话都是无状态的——这是大模型的局限。

但技术支持必须有状态:

- 客户环境是 v4.2、Helm 部署、阿里云 ACK

- 上次帮他排查的 MongoDB 问题还没完全解决****

Claire 用文件系统级记忆解决:

- uD83DuDCDD 每日记忆:每次技术支持交互自动记录

- uD83EuDDE0 长期记忆:反复出现的问题模式持久化

- uD83DuDC64 用户画像:每个客户的环境信息、历史问题独立维护

新会话启动时,Claire 自动读取相关记忆,「恢复」上下文。

就像同一个工程师在持续跟进你的问题。

每天 18:00,Claire 自动巡检当天所有群的技术支持记录,生成每日总结:

- 今天解决了几个问题?涉及哪些模块?

- 有哪些高频问题重复出现?

- 哪些问题还没解决,需要跟进?

- FAQ 是否需要补充?文档是否有缺口?

技术支持变成了一个有闭环的知识运营系统:

Claire 运行了一段时间,我们的感受:

* 指标 * 以前 * 现在 ** ----- * -------- * ----------- ** 响应时间 * 15-30 分钟 * 1-2 分钟 ** 日处理问题 * ~20 个 * 100+ ** 回答深度 * 泛泛而谈 * 精确到源码行号 ** 知识沉淀 * 零散在群里 * 自动沉淀 *

Claire 承担了 80% 的一线问题,把工程师时间释放出来做 20% 的复杂问题。

做 Claire 这件事的出发点很朴素:

Claire 不是凭空创造出来的智能。她的能力,来自我们喂给她的源码、文档、FAQ 和工作规范。

本质上,是把团队多年积累的技术支持经验,结构化地「教」给了一个 AI Agent。

如果你也被技术支持缠得脱不开身——

或许,也可以用 OpenClaw 试着克隆一个自己。

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

NanoClaw 开源轻量级个人AI助手 安全可靠的OpenClaw替代方案

MonsterClaw 采用 OpenClaw 技术打造的本地化AI运行平台

TinyClaw 由TinyAGI推出的开源轻量级多智能体协作框架

携程酒店业务借助NebulaGraph实现月均风控止损逾百万元

稀宇科技开源MiniMax Office Skills生产级办公文档引擎

ToClaw由ToDesk打造的专业定制AI智能体

TypeNo 免费开源的中文AI语音输入法 无需配置直接使用

Sub2API 开源人工智能API中转网关平台 具备多账户管理功能

阿里通义推出视频生成音频框架PrismAudio

Luma AI发布Uni-1模型实现图像理解与生成一体化

AI精选