MistralSmall4开源

作者:互联网

2026-03-23

人工智能领域迎来重大突破,最新开源的混合模型在多场景应用展现卓越性能。

根据介绍,Mistral Small 4 是一款混合模型,针对通用聊天、编码、智能体任务和复杂推理进行了优化。其架构支持文本和图像输入,使其能够灵活应用于各种场景。

技术参数上,采用 128 专家 MoE 架构,每 token 激活 4 个专家,总参数量1190亿,每个 token 有 60 亿个活动参数(包括嵌入层和输出层为 80 亿个)。上下文窗口 256k,支持长篇交互和文档分析。

以及可配置的推理强度:在快速、低延迟的响应和深度、推理密集型的输出之间切换。原生多模态:接受文本和图像输入,解锁从文档解析到视觉分析的各种应用场景。

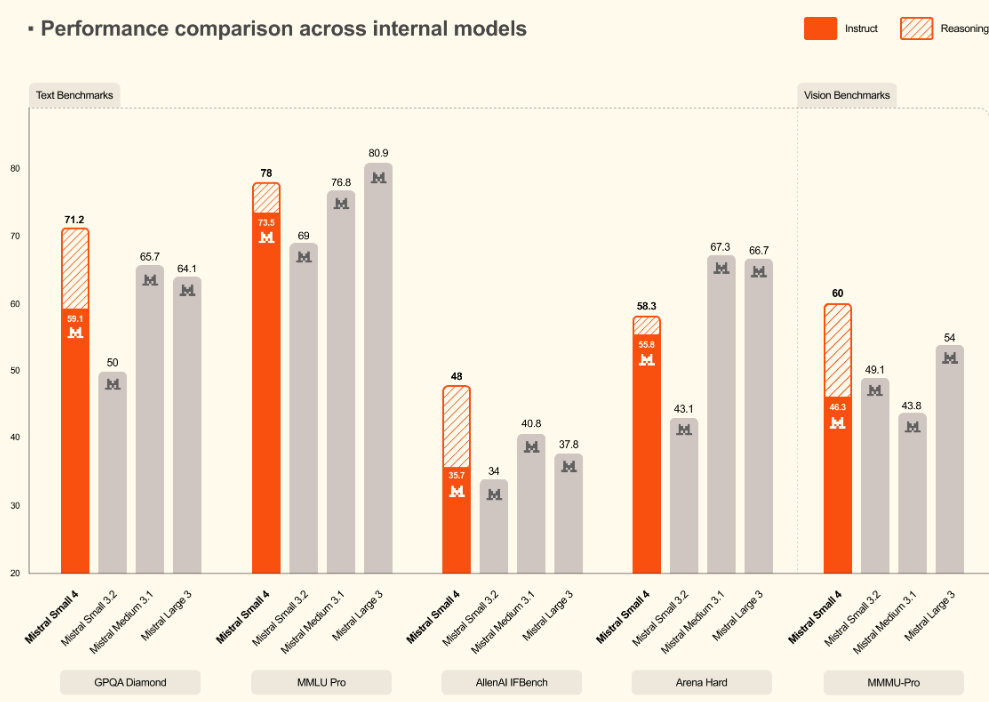

性能亮点:

- 端到端完成时间减少 40%(延迟优化设置)。

- 与 Mistral Small 3 相比,每秒请求数增加 3 倍(吞吐量优化设置)。

这款具备多项创新技术的AI模型将为开发者带来更强大的工具支持。

相关标签:

混合模型

多模态

MoE架构

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

Elasticsearch93新增bfloat16向量支持

03/30

解析OceanBase生态工具链之OAT_obd_OCP_obshell

03/30

贝叶斯不确定性引导的早停框架ESTune与OceanBase校企联合研究

03/30

杈炬ⅵ&浜哄ぇ閲戜粨閫傞厤瀹炴垬锛歋eaTunnel鍦ㄤ俊鍒涙暟鎹钩鍙颁腑鐨勫簲鐢ㄤ笌韪╁潙鎬荤粨

03/30

2026年1月中国数据库流行度排行榜:OB连冠领跑贺新元PolarDB跃居次席显锐气

03/30

社区译文解析FUD与真相MySQL是否真的被弃用了

03/30

英伟达重新规划AI推理加速布局 暂停Rubin CPU转攻Groq LPU

03/30

gpress v1.2.2 全新上线 Web3内容平台迎来更新

03/30

CMake 4.3.0 正式推出

03/30

短剧采用AI换脸技术使角色酷似明星 制作方与播出方构成侵权

03/30

AI精选