具身智能半月谈No.5|LaST₀首创潜在时空思维链快慢VLA

作者:互联网

2026-03-24

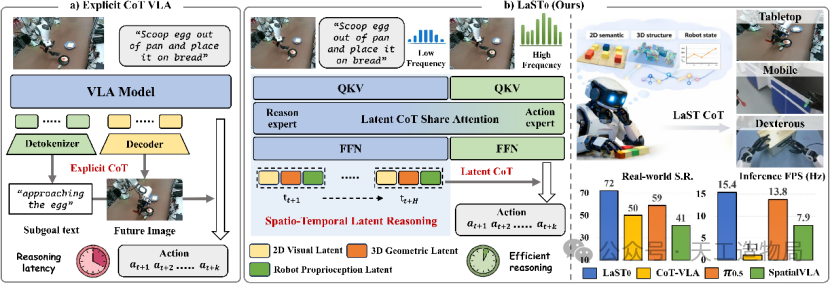

机器人领域迎来重大突破!LaST₀模型创新性地采用潜在时空思维链与双系统架构,完美平衡深度推理与高频动作控制,为具身智能发展开辟新路径。下面将深入解析这项前沿技术的核心原理与卓越表现。

核心贡献与技术亮点

LaST₀ 最大的突破在于它放弃了传统的基于显式文本或 Token 的思维链,转而引入了"潜在时空思维链(Latent Spatio-Temporal CoT)"。这意味着,LaST₀ 不再试图用"语言"去生硬地描述复杂的物理规律,而是在一个高度紧凑的隐式空间中自回归地预测未来的二维图像、三维点云和本体感知状态。这种设计不仅能精准捕捉那些"只可意会不可言传"的精细物理与机器人动力学,还大幅提升了动作在时间序列上的连贯性。

为了实现极高的运行效率,LaST₀ 借鉴了人类"快慢思考"的模式,基于 Mixture-of-Transformers (MoT) 设计了双系统架构:

- 慢速推理专家(深度思考):负责低频运行,在隐式空间中提取并处理复杂的时空依赖关系,构建对环境的深刻认知。

- 快速动作专家(敏捷执行):负责高频运行,根据最新的环境观测和慢速专家提供的隐式表示,直接在动作空间中生成实时的控制指令。

通过共享自注意力机制,两位"专家"在同一个 VLA 模型(均由预训练的 Janus-Pro 初始化)中实现了无缝的长上下文交互,完美协调了推理与控制。不仅如此,在下游联合训练中,模型还学会了在不同快慢操作频率比率下自适应切换。在 10 项仿真任务和 10 项复杂的真实世界任务(涵盖桌面单/双臂、移动底座、灵巧手等多种操作场景)的系统评估中,LaST₀ 交出了极其亮眼的答卷:

- 仿真环境:成功率超越此前 SOTA(最先进)方法 8%。

- 真实场景:在三大真实场景中分别实现 13%、14% 和 14% 的显著性能提升。

- 极致加速:相比以往的显式 CoT VLA 模型,推理速度实现了惊人的 14倍提升!

此外,LaST₀ 在长程任务中表现出极强的动态适应性,例如能够轻松应对动态环境变化,完成"连续从锅中舀起鸡蛋"等复杂操作。

潜在时空思维链机制

为了让机器人能够"领悟"那些难以用语言描述的精细物理规律与动力学特征,并实现高效的时序建模,研究团队创新性地构建了潜在时空思维链(Latent Spatio-Temporal CoT,简称 LaST CoT)。其核心技术拆解如下:

1、三重模态融合,构建"隐式感知空间"

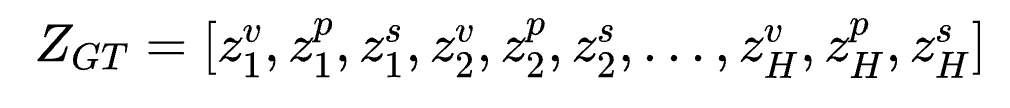

为了精准预判未来的物理世界,研究团队从三个互补的维度提取了未来时间步 k∈{1, …,H}的特征,形成完整的物理表示:

- 视觉隐式表示 zₖᵛ:利用冻结的 SigLIP-Large 编码器处理未来的 RGB 图像 Iₜ₊ₖ

- 几何隐式表示 zₖᵖ:通过 Uni3D 编码器处理未来的 3D 点云 Pₜ₊ₖ,精准捕捉空间占据情况。

- 本体感知表示 zₖˢ:通过动作分词器,将未来的机器人状态 sₜ₊ₖ 转换为隐式特征。

为了确保极高的推理效率,研究团队没有选择解码高昂的像素级图像或长文本序列。相反,他们通过平均池化,将上述高维特征图直接压缩为单个代表性的 Token,生成了一组紧凑的嵌入 {zₖᵛ, zₖᵖ, zₖˢ}。这些 Token 按时间顺序交错排列,极大地帮助模型学习不同模态间随时间变化的物理因果关系。

2、引入特殊占位符,规范序列结构

为了让"思考"与"行动"更有条理,研究团队在序列中引入了三个特殊 Token:

- 训练阶段:模型使用真实的隐式序列替换掉

,通过标准的 Teacher Forcing 机制学习环境的转换动力学。 - 推理阶段:慢速推理专家会以

起头,自回归地生成隐式嵌入,逐一填满 的位置,直到覆盖预设的预测时间范围。

3、连续隐式回归,精准对齐物理动态

虽然慢速推理专家的思考过程是自回归的(一步接一步),但研究团队并没有采用大语言模型中常见的"离散 Token 概率预测"来训练它,而是选择了一条更契合物理世界运作规律的道路——连续隐式回归。

- "下一步预测"机制:慢速专家会在已知当前环境和上下文的情况下,预测出一系列未来的潜在推理状态。

- 告别传统 CoT 的离散预测:传统的思维链(CoT)通常是在预测下一个"词",但研究团队的隐式目标,是一组能够真正编码未来物理世界状态的连续高维嵌入向量。

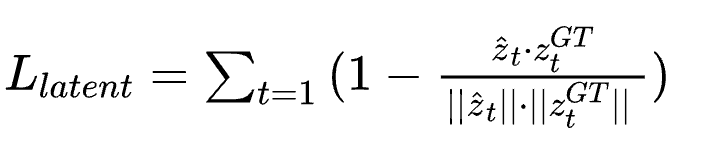

- 余弦相似度对齐:为了让模型预测的隐式表示与真实的未来状态高度一致,研究团队采用了"余弦相似度"作为监督目标。

双系统协作架构

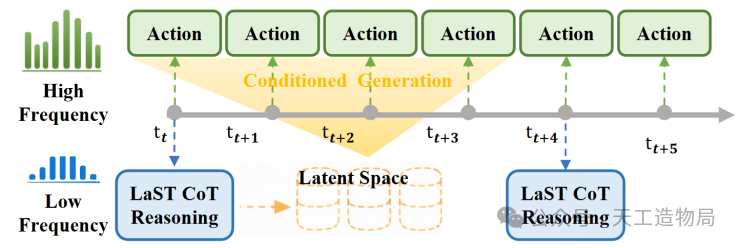

为了让机器人的"深度思考"(LaST CoT 推理)与"敏捷行动"(高频控制)互不拖累,研究团队创新性地引入了一种异步频率机制。

简单来说,研究团队设置了一组更新比率 k(例如 k∈{2,4,8})),通过这把"标尺"成功解耦了两个专家的运行节奏,让它们各司其职:

- 慢速推理专家(主导思考):在稀疏的关键帧(即 t mod κ = 0时)被唤醒。会接收自然语言指令和低频观测数据I_slow,通过自回归推演出包含未来物理动态的隐式思维链。在连续关键帧的间隙(即 t mod κ ≠ 0 时)会进入"休眠"状态以节省算力开销。

- 快速执行专家(主导执行):始终以原生的控制频率高频运转,在每个时间步都保持活跃。它专为快速闭环反馈而生,仅接收高频观测数据I_fast。当慢速专家处于休眠期时,快速专家会直接以最新生成的"潜在推理输出"为指导,实时生成具体动作。

为了打破不同运行频率和数据源带来的沟通壁垒,MoT 架构巧妙地维护了一个统一的 Token 序列,使得快速执行专家能够通过共享注意力机制,高效提取语言目标与隐式 CoT Token,轻松实现了跨频段的无缝协同。

实验评估

为了验证 LaST₀ 的实际效果,研究团队在 RLBench 模拟器中对其进行了严格的压力测试。结果表明,LaST₀ 不仅"想得深",而且"动得快"。

1、成功率断层领先,霸榜多项核心任务

在 10 项复杂的 RLBench 操作任务中,LaST₀-3.3B 模型(在 1:4 的快慢评估比例下)交出了高达 82% 的平均成功率答卷。这一成绩直接拉开了与现有最强方法的差距:

- 相较 HybridVLA-7B (74%) 高出 8%

- 相较 π0.5-

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

NanoClaw 开源轻量级个人AI助手 安全可靠的OpenClaw替代方案

MonsterClaw 采用 OpenClaw 技术打造的本地化AI运行平台

TinyClaw 由TinyAGI推出的开源轻量级多智能体协作框架

携程酒店业务借助NebulaGraph实现月均风控止损逾百万元

稀宇科技开源MiniMax Office Skills生产级办公文档引擎

ToClaw由ToDesk打造的专业定制AI智能体

TypeNo 免费开源的中文AI语音输入法 无需配置直接使用

Sub2API 开源人工智能API中转网关平台 具备多账户管理功能

阿里通义推出视频生成音频框架PrismAudio

Luma AI发布Uni-1模型实现图像理解与生成一体化

AI精选