月之暗面-Kimi团队提出Attention-Residuals(AttnRes)架构-基于脚本的深度学习残差连接新范式

作者:互联网

2026-03-22

中国AI领域迎来重大突破,月之暗面Kimi团队在最新技术论文《Attention Residuals: Rethinking depth-wise aggregation》中,首次提出革命性的Attention Residuals(注意力残差)架构。这一创新从根本上重构了Transformer模型的信息流动机制,引发全球AI界高度关注。

传统残差连接自ResNet问世以来已沿用十余年,其固定权重相加方式(y = x + f(x))逐渐暴露出两大缺陷:浅层特征在深层传递时会出现信息稀释,同时隐藏状态的无序扩张影响数值稳定性。这些问题在百层以上的大模型中尤为突出。

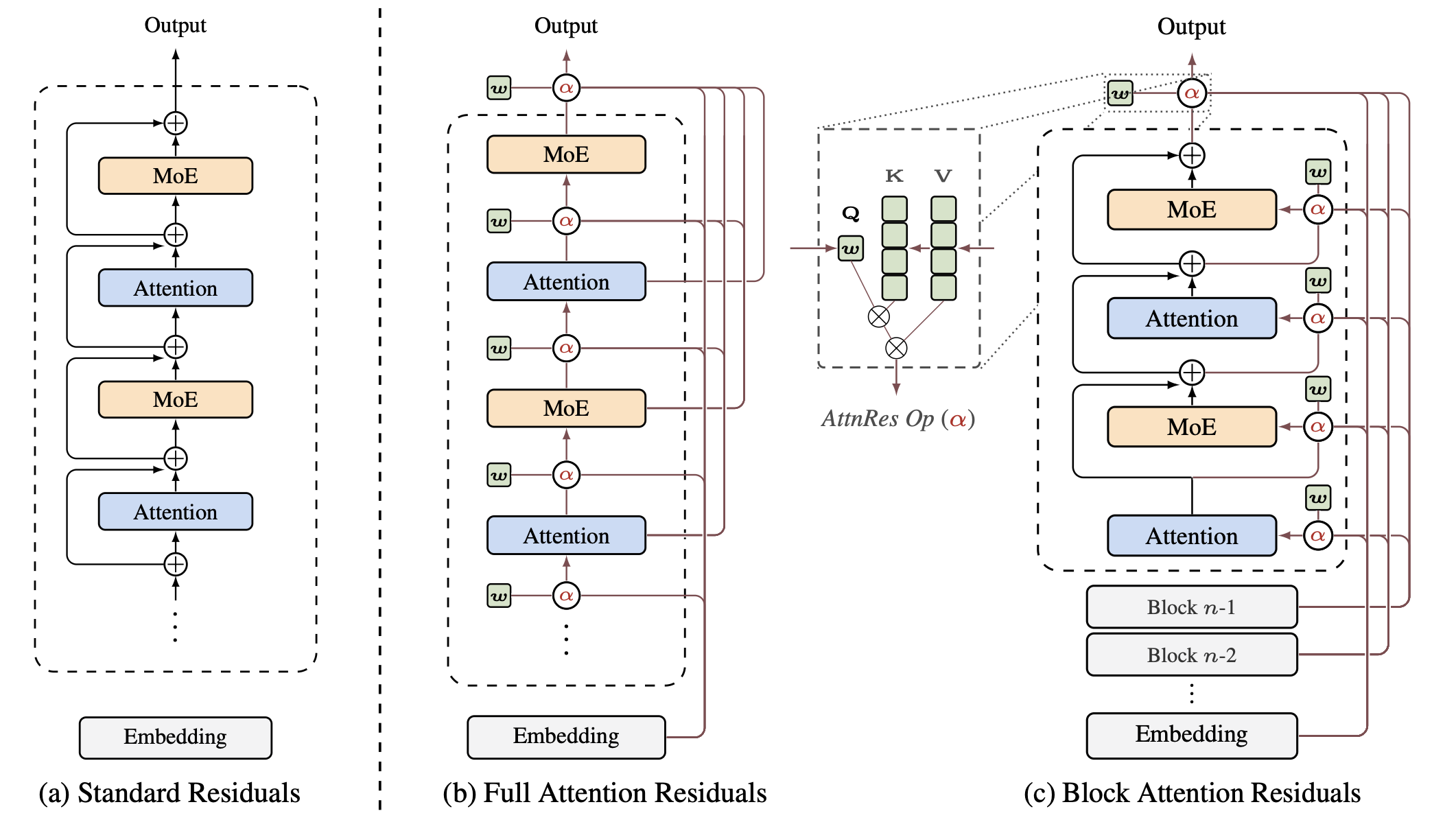

AttnRes架构的核心突破在于:

2. 通过动态权重替代固定权重相加

3. 采用分块压缩策略控制计算复杂度

4. 实现输入相关的特征重要性自适应分配

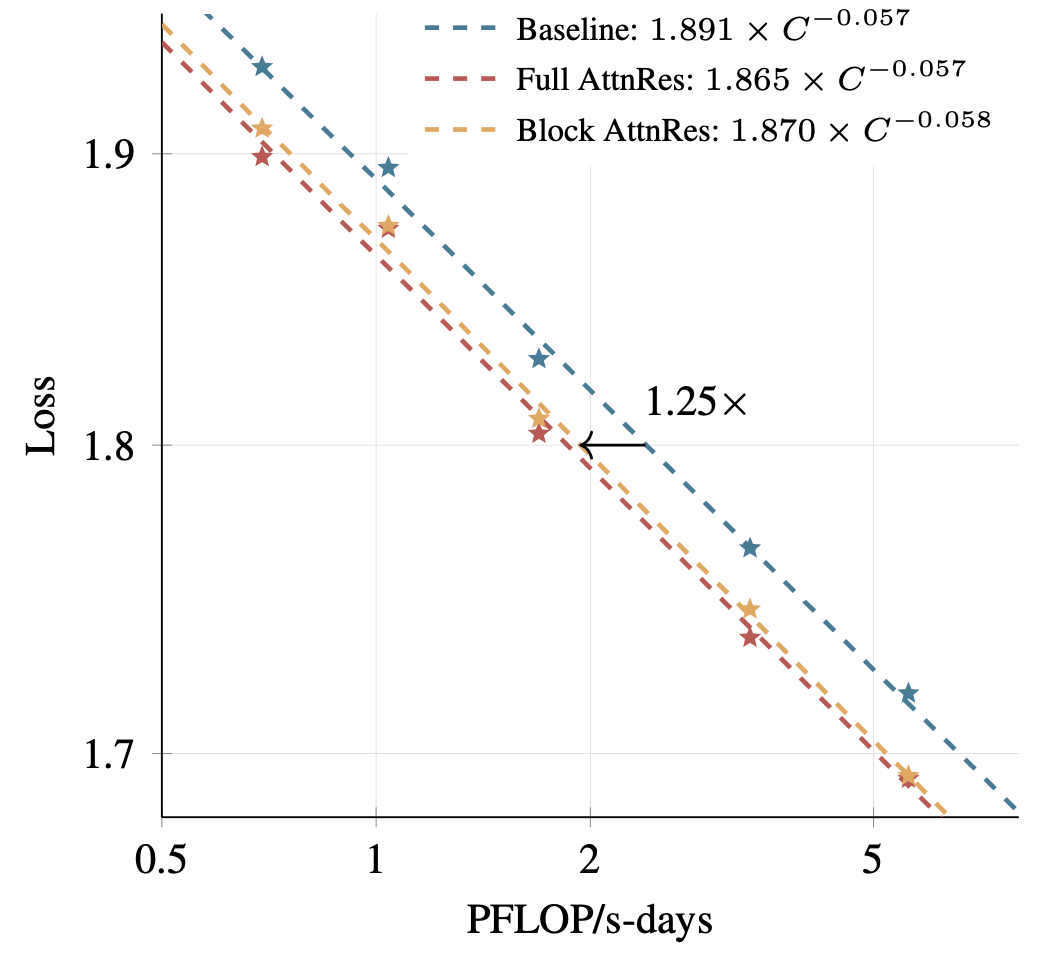

实际测试数据显示,在480亿参数MoE模型上,该架构不仅提升25%计算效率,更在多任务基准测试中显著超越传统架构。这种性能与效率的双重突破,为大模型产业化应用开辟了新路径。

业界权威纷纷发声肯定这一成果。埃隆·马斯克公开称赞其为"令人印象深刻的工作",OpenAI核心开发成员Jerry Tworek更预言这将开启深度学习2.0时代。多位专家指出,这是十年来首次对神经网络基础组件的大胆革新,其技术价值可能重塑现有AI模型架构范式。

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

Elasticsearch93新增bfloat16向量支持

解析OceanBase生态工具链之OAT_obd_OCP_obshell

贝叶斯不确定性引导的早停框架ESTune与OceanBase校企联合研究

杈炬ⅵ&浜哄ぇ閲戜粨閫傞厤瀹炴垬锛歋eaTunnel鍦ㄤ俊鍒涙暟鎹钩鍙颁腑鐨勫簲鐢ㄤ笌韪╁潙鎬荤粨

2026年1月中国数据库流行度排行榜:OB连冠领跑贺新元PolarDB跃居次席显锐气

社区译文解析FUD与真相MySQL是否真的被弃用了

英伟达重新规划AI推理加速布局 暂停Rubin CPU转攻Groq LPU

gpress v1.2.2 全新上线 Web3内容平台迎来更新

CMake 4.3.0 正式推出

短剧采用AI换脸技术使角色酷似明星 制作方与播出方构成侵权

AI精选