微软开源多模态推理模型Phi4ReasoningVision15B

作者:互联网

2026-03-24

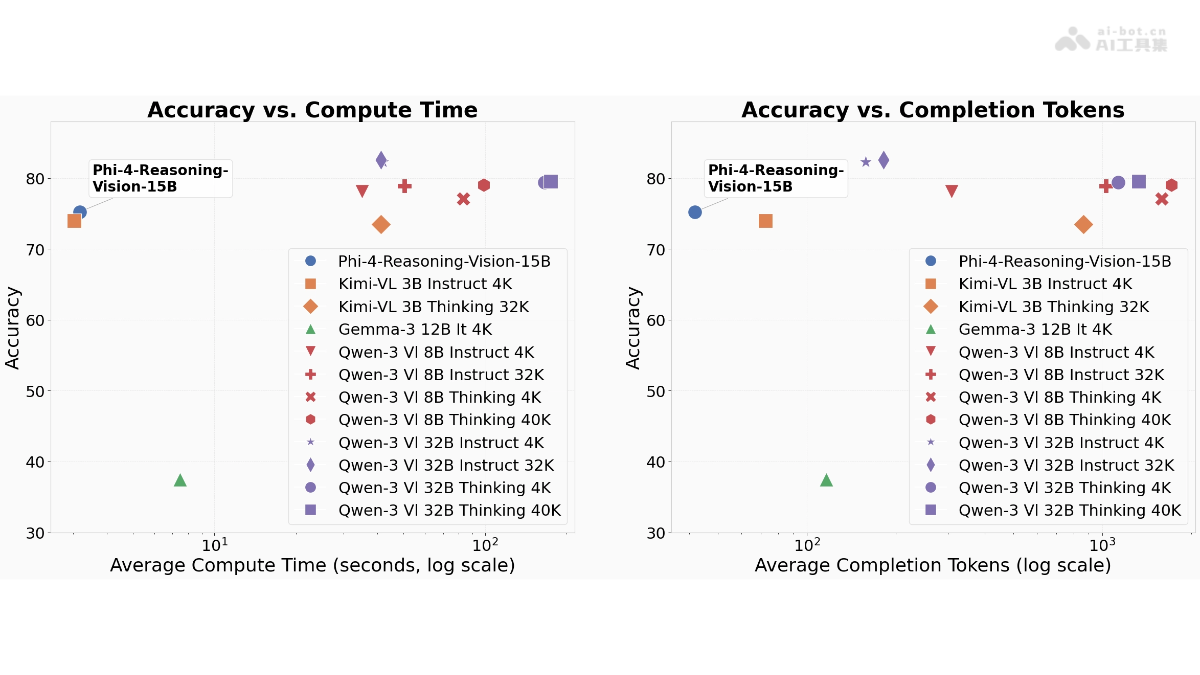

微软推出的Phi-4-reasoning-vision-15B开源模型,凭借150亿参数和独特的多模态架构,在视觉推理领域实现了突破性进展。该模型通过智能分配计算资源,在精度与效率之间取得了卓越平衡。

Phi-4-reasoning-vision-15B是什么

作为微软开源的多模态推理模型,Phi-4-reasoning-vision-15B融合了Phi-4-Reasoning语言模型与SigLIP-2视觉编码器的优势。其创新的"混合推理"机制能自动区分任务类型,针对数学题等复杂问题进行深度思考,而对OCR等简单任务则快速响应。仅用2000亿token训练数据就达到行业领先水平,在GUI理解、数学推理等场景的推理速度远超同类产品10倍以上。

Phi-4-reasoning-vision-15B的主要功能

- 通用视觉理解:不仅能识别图像中的物体和场景,还能回答与图像内容相关的各类问题,包括文字信息提取。

- 文档与图表解析:支持处理收据、发票等商业文档,解析复杂图表并提取关键数据进行定量分析。

- 数学与科学推理:可解答包含公式和图表的专业问题,识别手写内容并展示完整的解题思路和过程。

- GUI交互与屏幕理解:精确识别电子设备界面中的可交互元素,提供边界框坐标以支持自动化操作。

- 多图像序列分析:能够处理连续图像序列,分析其中的时间变化趋势和关联性。

- 自适应推理模式:根据任务复杂程度智能选择响应方式,用户也可通过特殊标记指定推理深度。

Phi-4-reasoning-vision-15B的技术原理

- 架构设计:采用Mid-fusion中期融合方案,SigLIP-2 Naflex视觉编码器处理图像后生成视觉token,再投影到Phi-4-Reasoning语言模型的嵌入空间实现跨模态推理。

- 混合推理机制:基于经过微调的语言模型骨干,通过20%推理样本与80%非推理样本的配比训练,使模型能够自主判断何时需要深度思考。

- 高分辨率处理:支持动态分辨率的SigLIP-2 Naflex变体最高可处理3600个视觉token,相当于原生720p分辨率,显著提升对精细界面元素的识别精度。

- 数据策略:精选开源数据配合人工审核与合成生成,仅用2000亿token就达到了与万亿级模型相当的性能表现。

Phi-4-reasoning-vision-15B的项目地址

- 项目官网:https://www.microsoft.com/en-us/research/blog/phi-4-reasoning-vision-and-the-lessons-of-training-a-multimodal-reasoning-model/

- GitHub仓库:https://github.com/microsoft/phi-4-reasoning-vision-15B

- HuggingFace模型库:https://huggingface.co/microsoft/Phi-4-reasoning-vision-15B

- 技术论文:https://www.microsoft.com/en-us/research/wp-content/uploads/2026/03/Phi-4-reasoning-vision-15B-Tech-Report.pdf

Phi-4-reasoning-vision-15B的应用场景

- 教育辅助:帮助学生检查数学作业错误,识别手写内容并给出正确解题步骤。

- 智能办公:自动解析商业票据,提取关键信息并生成结构化数据。

- 界面自动化:作为计算机代理的基础模型,实现跨平台的自动化操作。

- 移动设备辅助:帮助用户定位手机应用功能入口,完成复杂操作流程。

- 文档分析:处理各类电子文档,进行信息提取和内容对比分析。

Phi-4-reasoning-vision-15B以其创新的混合推理架构和高效的计算性能,为多模态AI应用开辟了新的可能性。从教育到商业领域,该模型都展现出强大的实用价值。

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

NanoClaw 开源轻量级个人AI助手 安全可靠的OpenClaw替代方案

MonsterClaw 采用 OpenClaw 技术打造的本地化AI运行平台

TinyClaw 由TinyAGI推出的开源轻量级多智能体协作框架

携程酒店业务借助NebulaGraph实现月均风控止损逾百万元

稀宇科技开源MiniMax Office Skills生产级办公文档引擎

ToClaw由ToDesk打造的专业定制AI智能体

TypeNo 免费开源的中文AI语音输入法 无需配置直接使用

Sub2API 开源人工智能API中转网关平台 具备多账户管理功能

阿里通义推出视频生成音频框架PrismAudio

Luma AI发布Uni-1模型实现图像理解与生成一体化

AI精选