腾讯开源AniPortrait照片对口型视频生成框架

作者:互联网

2026-03-27

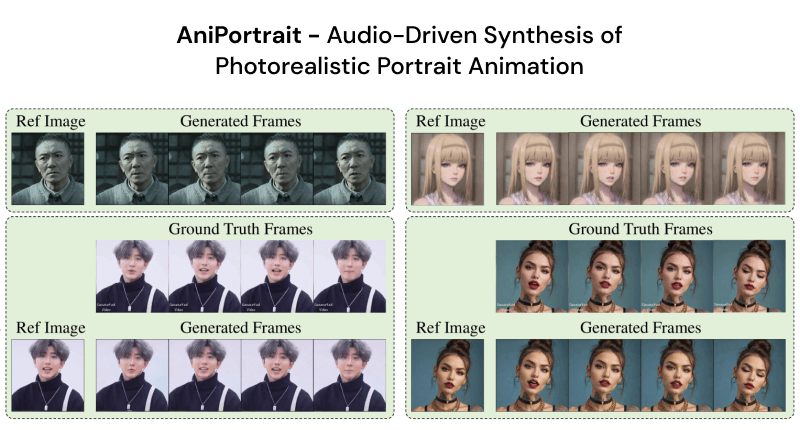

AniPortrait作为前沿的AI视频生成技术,通过音频驱动实现高精度面部动画合成。本文将详解其核心功能与创新架构,带您探索这项技术的实现原理。

AniPortrait技术解析

这款开源框架通过两阶段处理实现音频到动画的转换:先提取3D面部特征并转为2D标记点,再通过扩散模型生成连贯动画。其突出优势在于自然流畅的动作表现,以及灵活的面部动作编辑能力。

AniPortrait资源获取

- GitHub代码库:https://github.com/Zejun-Yang/AniPortrait

- arXiv研究论文:https://arxiv.org/abs/2403.17694

- Hugging Face模型:https://huggingface.co/ZJYang/AniPortrait/tree/main

- Hugging Face Demo:https://huggingface.co/spaces/ZJYang/AniPortrait_official

AniPortrait核心优势

- 智能语音同步:精准匹配音频与面部动作,实现自然的唇形变化与表情变化。

- 高清视觉呈现:采用先进扩散模型,输出具有影院级画质的动态肖像。

- 流畅动作衔接:确保动画序列的时间连贯性,消除画面跳跃感。

- 高度可定制:基于3D面部特征实现动画细节的精细化调整。

- 微表情捕捉:优化后的PoseGuider模块能还原最细微的面部肌肉运动。

- 身份一致性:完美保持原始肖像特征,避免生成角色"变脸"问题。

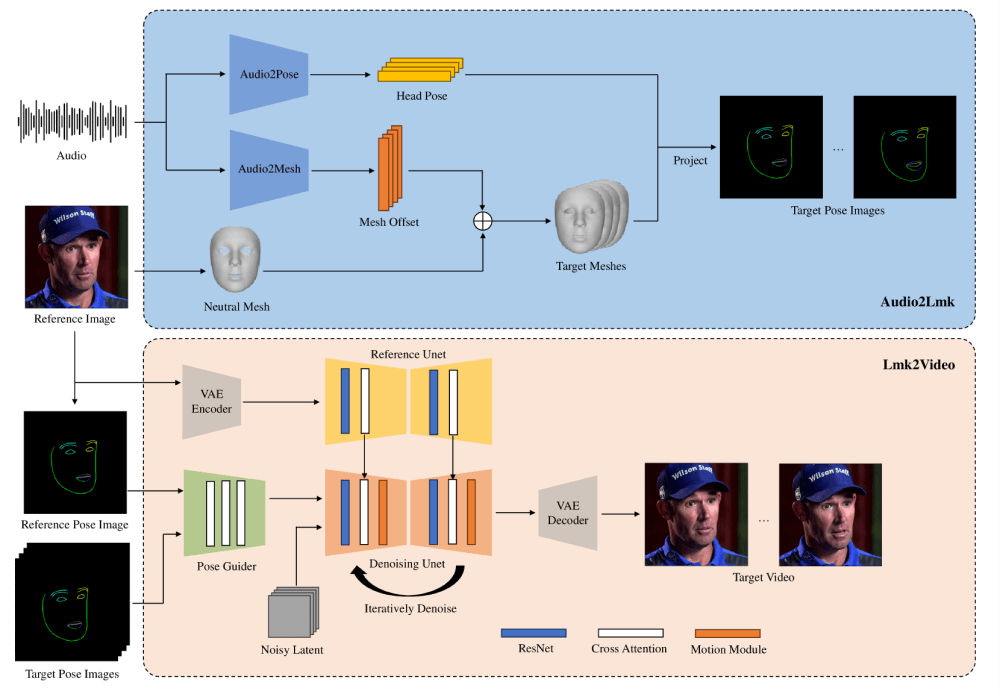

AniPortrait技术架构

系统采用模块化设计,包含Audio2Lmk和Lmk2Video两大核心组件。

1. 音频特征转换模块

该模块通过wav2vec模型解析音频特征,经全连接层转换为3D面部网格。采用独立权重预测头部姿势,结合变压器解码器处理时序信息,最终通过透视投影输出2D标记点序列。

2. 视频生成模块

基于Stable Diffusion 1.5架构,整合ReferenceNet保持角色一致性。改进的PoseGuider采用多尺度策略,通过交叉注意力机制增强标记点与外观特征的关联性,实现精准的嘴唇动作还原。

AniPortrait通过创新性的双模块协作,为数字肖像动画创作提供了全新的技术范式,展现出AI在多媒体领域的巨大潜力。

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

OpenClaw 真正的效率开关,不是 Prompt,而是多会话和子代理

10款免费AI语音输入工具与软件 轻松实现语音转文字

MCP 协议深度解析:构建 AI Agent 的「万能接口」标准

WorkAny Bot 云端AI Agent工具采用OpenClaw框架构建

Anthropic 的 Harness 启示:当 AI Agent 开始「长跑」,架构才是真正的天花板

SkyBot由Skywork研发的云电脑AI助手

AI Agent 智能体 - Multi-Agent 架构入门

Nano Banana 2 国内使用指南 LiblibAI 无需翻墙教程

一文搞懂卷积神经网络经典架构-LeNet

一文搞懂深度学习中的池化!

AI精选