Cursor重回巅峰:Composer 2在编程基准超越Opus 4.6,还便宜五倍

作者:互联网

2026-03-24

你们最近有没有注意到,关于 Cursor 的讨论突然又多了起来?

过去几个月,大家聊的更多是 Windsurf、Cline,还有各种新冒头的编程工具。Cursor 虽然没消失,但那种"它又做了什么厉害的事"的感觉,稍微淡了一点。

然后就在3月19日,它发布了 Composer 2,整个社区的讨论热度一下子就回来了。

我一看发布公告,确实有点意外。不是那种"还不错"的意外,是"这数据有点离谱"的那种。

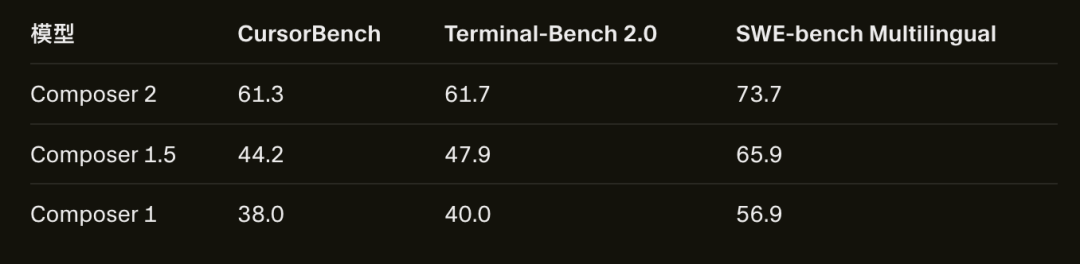

三个版本,半年时间

Cursor 从去年10月发布第一个 Composer 模型算起,到现在是第三个版本——Composer 1(2025年10月)、Composer 1.5(2026年2月)、Composer 2(2026年3月19日)。五个月出了三代,迭代速度还是挺快的。

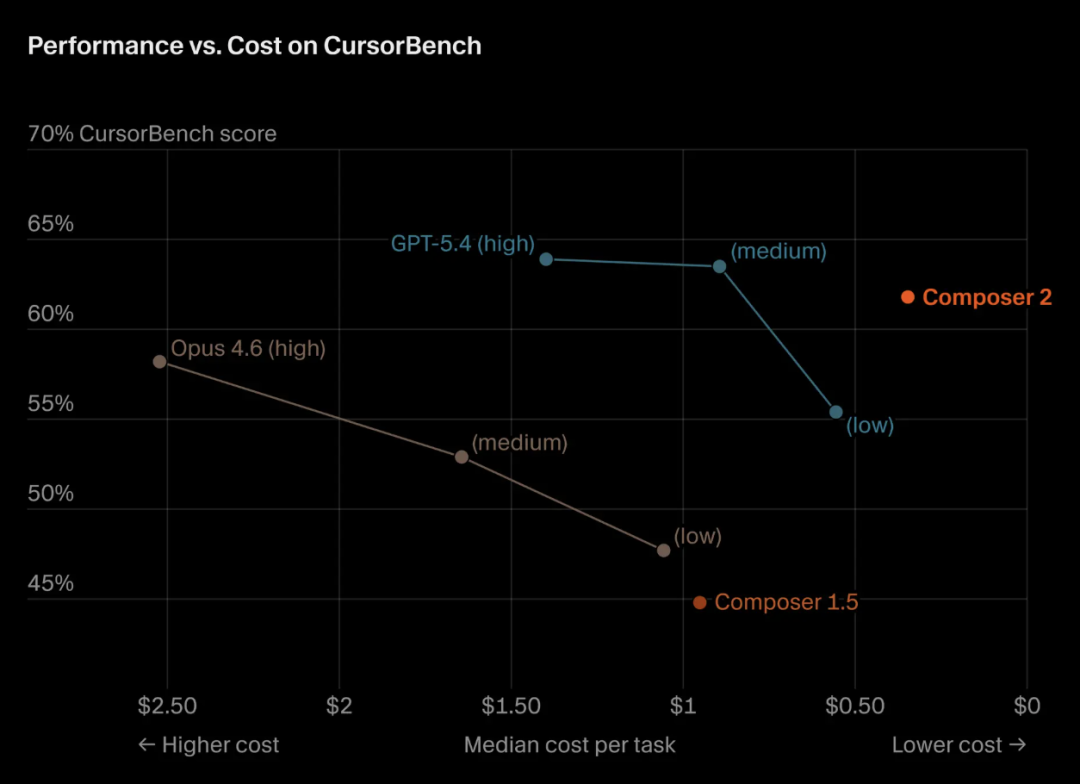

但更值得说的是进步幅度。在 Cursor 自己的 CursorBench 上,三个版本分别是 38.0、44.2、61.3——Composer 2 比第一代足足高出60%。

Terminal-Bench 2.0(一个由 Laude Institute 维护的 agent 评测基准)的得分从 40.0 涨到了 61.7;SWE-bench Multilingual 的多语言代码修复任务,从 56.9 到 73.7。

这些数字单拎出来可能不太直观。

但有一个横向对比会让人更有感觉:Composer 2 在 Terminal-Bench 2.0 上的表现,超过了 Anthropic 的 Opus 4.6。后者是目前 Anthropic 旗下公认最强的编程模型之一。

价格才是这次真正的颠覆点

光是性能超过 Opus 4.6 已经够说一说了,但 Cursor 把价格定到这个位置,才是真的有点狠。

Composer 2 的标准版定价是:输入 $0.50/M tokens,输出 $2.50/M tokens。还有一个更快的版本,$1.50/M 输入、$7.50/M 输出。

Opus 4.6 的官方定价是输入 $15/M、输出 $75/M。横向一比,输入端便宜了30倍,输出端便宜了30倍。就算拿那个"快版"来比,也是10倍的差距。

性能持平甚至更强,价格便宜一个数量级——这不是渐进式改进,这更像是降维打击。

当然,这里面有个背景值得说一下。Cursor 作为 IDE,有自己完整的 agent 执行框架,Composer 模型就是跑在这个框架里被训练和评测的。

所以说"在 Cursor 的 agent 场景下超越 Opus 4.6"比较准确,Composer 2 不是一个通用大模型,它是一个专为编程 agent 任务优化的专用模型。这个定位其实反而更有说服力——在真正会用到它的场景里,它就是比别人强。

真正让它变强的技术:让模型自己「压缩记忆」

Cursor 这次在博客里详细解释了 Composer 2 的关键技术,叫做「self-summarization」,我觉得这个方向很值得关注。

做过 agent 开发的人可能都碰到过一个头疼的问题:上下文窗口到头了怎么办?

传统做法是让 harness 强行压缩——要么让一个单独的模型去总结,要么直接把最老的内容滑掉。这两种方式都有一个共同问题:关键信息很容易在压缩过程中丢失,然后 agent 就开始原地转圈、重复之前的错误。

Cursor 的做法是:把自我压缩这个行为纳入训练循环本身。

Composer 在 agent 任务训练过程中,当上下文接近触发阈值时,模型会暂停、自己生成一个总结,然后基于这个压缩后的上下文继续工作。关键是,这个自我总结的质量,本身也会被最终的任务完成情况反向奖励——总结得好,任务完成得好,总结策略就被强化;总结得烂,任务失败,就被惩罚。

结果很有意思。普通的提示词引导总结,需要几千 tokens 的精心设计提示、输出5000多 tokens 的结构化摘要。Composer 自学会的总结方式,只需要一句"请总结一下目前的对话",输出平均才1000 tokens——但效果更好,压缩错误减少50%,KV cache 还能继续复用。

Cursor 用来展示这个能力的例子很有画面感:一道叫做 make-doom-for-mips 的 Terminal-Bench 题目,要求把 DOOM 游戏的源代码编译成能在 MIPS 架构上运行的版本。

这道题对很多顶级模型来说都没法一次做对。Composer 跑了170轮对话,中间多次自我压缩,最终把它做出来了——还顺手渲染出了一帧游戏画面作为验证。

Cursor 在做的事,比表面看起来更大

这次发布让我想到一个更大的问题:Cursor 现在到底是什么?

很长一段时间里,大家对 Cursor 的认知是"一个好用的 Claude/GPT 套壳 IDE"。

这个定位没什么问题,它确实因为出色的 UX 设计和 agent 集成方式而出圈的。但现在,Cursor 开始自己训练模型了,并且训练的方向非常聚焦——不是通用智能,而是"在我的 IDE 环境里,帮用户把代码任务搞定"。

这其实是一个很清醒的战略判断:不去和 OpenAI、Anthropic 正面竞争通用大模型,而是把"编程 agent"这个具体任务做到极致,然后在这个垂直场景里把价格打下来。

如果你要在 IDE 里做长链路代码任务,专门为这件事优化过、还便宜一个数量级的模型,和通用大模型的竞争结果大概不难想象。

从另一个角度看,这也是对 AI 编程工具竞争格局的一次重新定义。以前的竞争维度是"集成了哪个最强的底层模型",接下来可能会变成"谁把自己场景里的模型调得最准、成本控得最低"。

一些还没想清楚的部分

说实话,我对这次发布还有几个疑问。

Composer 2 的能力评测是 Cursor 自己做的,用的是他们自己维护的 CursorBench,加上 Terminal-Bench 2.0 和 SWE-bench Multilingual 两个第三方基准。

Terminal-Bench 2.0 算是相对权威的,但整体来看,"超越 Opus 4.6"这个结论主要是在编程 agent 的特定任务上成立,不代表通用能力的全面超越。这个前提我觉得需要说清楚。

另外,Cursor 目前还没有公布 Composer 2 的具体参数规模和训练数据细节。

"第一次完整的 continued pretraining"这个说法暗示他们在这次做了更多从头训练的工作,但具体是多大规模的模型,不清楚。这对于判断它的可持续性和未来上限还是有影响的。

还有一点值得留意:Cursor 在发布公告里提到"我们很快会分享下一个版本的 Composer 的更多信息"——五个月三代,下一代可能也不远了。

用用看再说

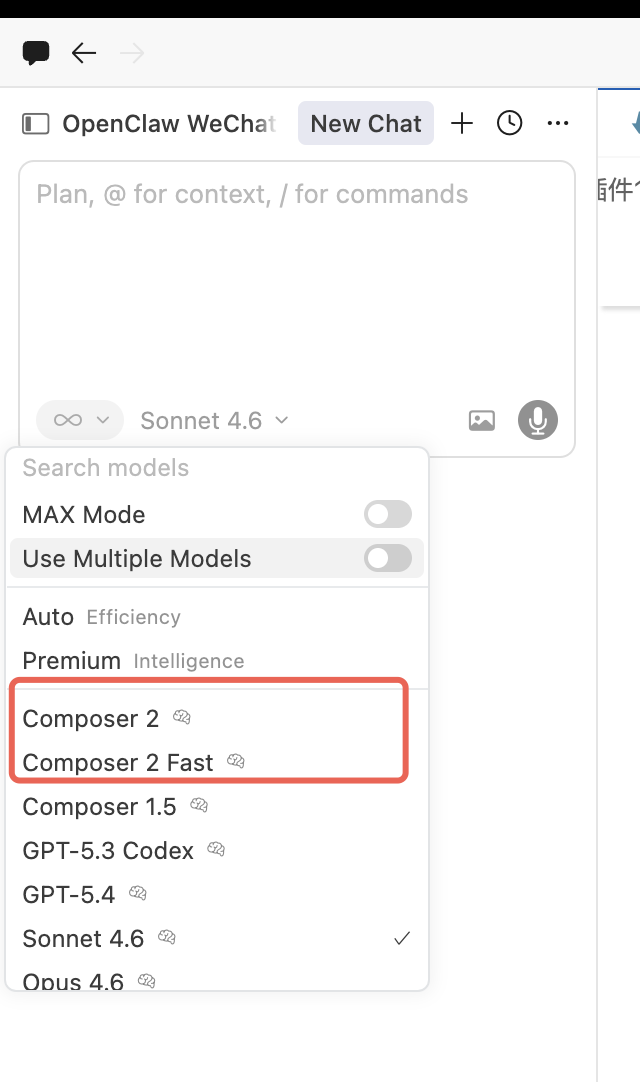

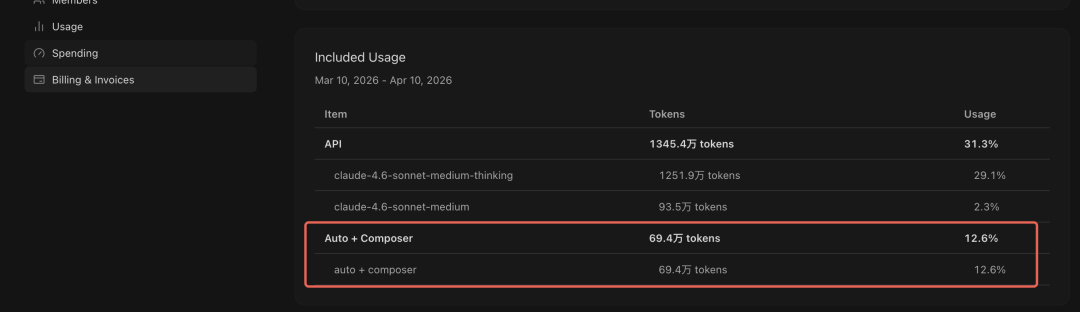

Composer 2 现在已经可以在 Cursor 里直接用了。

对于 Cursor 的个人订阅用户,Composer 的使用量被纳入单独的 usage pool,官方说有"充裕的额度"包含在内,超出部分按 $0.50/M 输入计费。

Cursor 同期还在内测一个叫 Glass 的新界面,Composer 2 也在那边可用——不过目前还是 early alpha 状态。

我打算这几天拿几个实际项目好好跑一跑,主要想看它在长任务场景下的表现——context 压缩之后的代码一致性,还有它在多文件改动时的全局感知能力,这两点对日常使用的影响最直接。如果有值得说的发现,后面再写。

总之这次发布,Cursor 至少证明了一件事:自己训练专用模型这条路是走得通的,而且走得比很多人预期的要快。

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

NanoClaw 开源轻量级个人AI助手 安全可靠的OpenClaw替代方案

MonsterClaw 采用 OpenClaw 技术打造的本地化AI运行平台

TinyClaw 由TinyAGI推出的开源轻量级多智能体协作框架

携程酒店业务借助NebulaGraph实现月均风控止损逾百万元

稀宇科技开源MiniMax Office Skills生产级办公文档引擎

ToClaw由ToDesk打造的专业定制AI智能体

TypeNo 免费开源的中文AI语音输入法 无需配置直接使用

Sub2API 开源人工智能API中转网关平台 具备多账户管理功能

阿里通义推出视频生成音频框架PrismAudio

Luma AI发布Uni-1模型实现图像理解与生成一体化

AI精选