杨植麟GTC演讲实录:Kimi构建更强开源模型的三个Scaling策略!大量老技术正在被重新发明!AI研究已从“提出想法”转向“系统验证”!

作者:互联网

2026-03-24

编辑 | 云昭

出品 | 51CTO技术栈(微信号:blog51cto)

上周,月之暗面 CEO 杨植麟在GTC 2026现场发表了精彩主题分享。可以说是过去 Kimi 过去一面在开源模型的方面的深刻的经验总结。

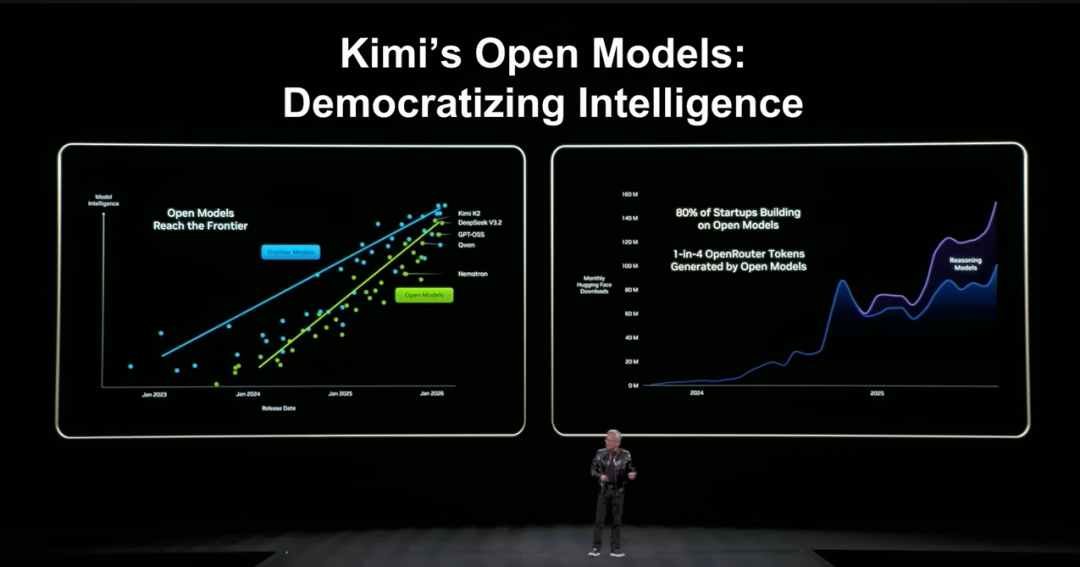

杨植麟在开场引用了 黄仁勋 在 CES 的一张图:开源模型与闭源模型的性能差距正快速收敛。这一趋势让“智能民主化”从口号变成现实路径。

图片

图片

但 Kimi 随即补了一句更关键的话——不过,开源模型不能只是“开源”,它还必须足够优秀。

而这构成了整场分享的核心逻辑:开源模型要赢,就必须在能力上变得足够强。

围绕这个“构建更强的开源模型”这个主旋律,单点突破显然不可行。

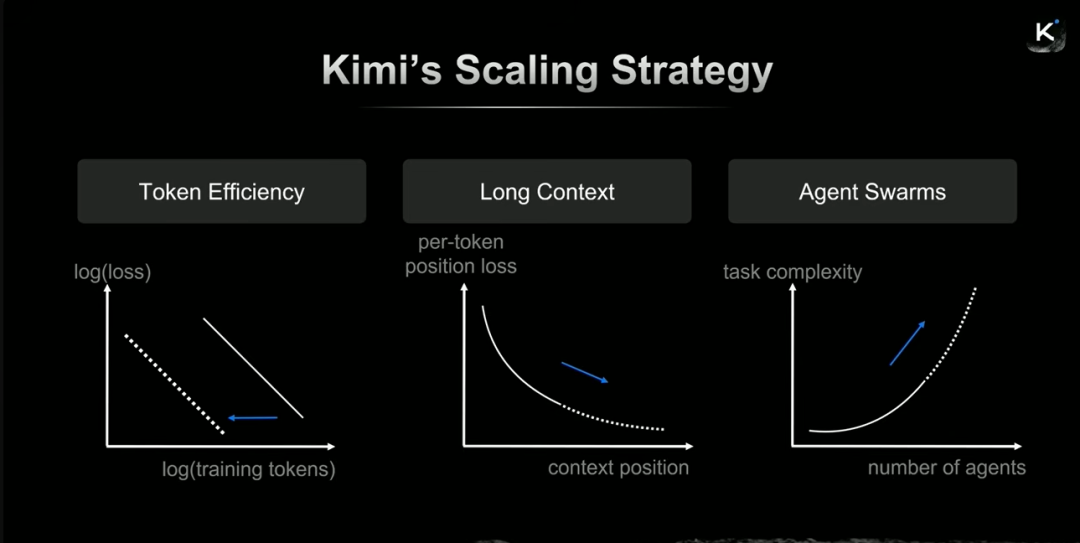

Kimi 给出了“三位一体”的“多维 scaling”方法。

第一条路径:token efficiency,决定智能上限;

第二条路径:长上下文,重构任务边界。如果说 token efficiency 决定“模型有多聪明”,那么上下文长度决定“模型能做多复杂的事”。

第三条路径:Agent Swarm,让模型变成“组织”,具备“系统能力”。

这些也正是 Kimi 的分享的主体内容。但如果你没有仔细听这场分享。就会漏掉很多月之暗面过去的一些细微且关键的经验结论。

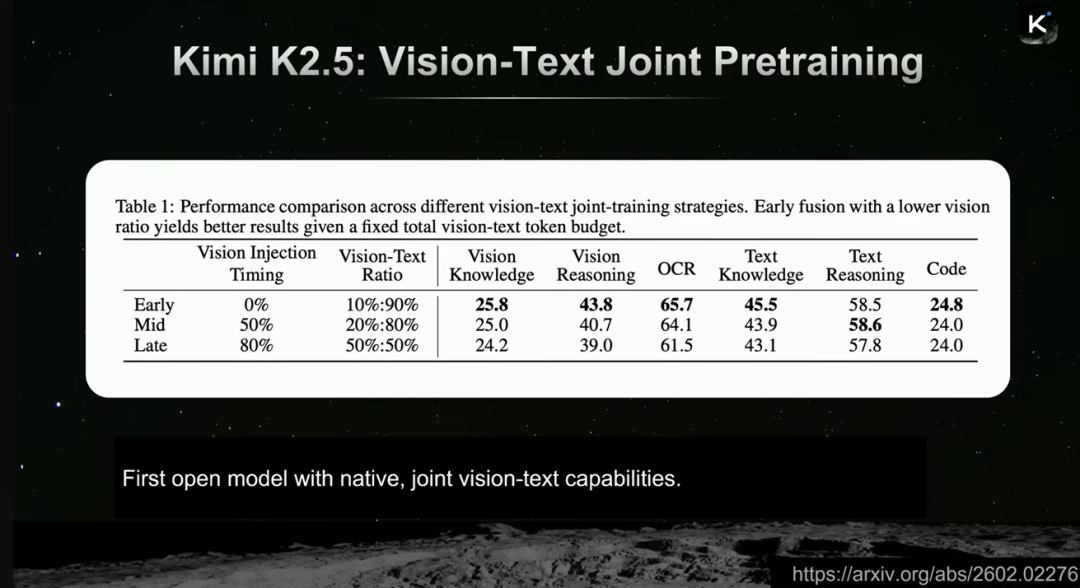

比如:杨植麟在分享中提到了一个月暗内部在多模态通用模型构建过程中的“隐藏宝藏”。

在新模型 Kimi K2.5 中,他们做了一个更激进的尝试:从训练一开始,就将视觉和文本统一建模(early fusion)。这带来两个反直觉结果:

视觉训练可以提升文本推理能力,强文本模型可以反向提升视觉能力。

这里划重点,杨植麟表示,甚至在几乎没有视觉监督数据的情况下,模型依然具备强视觉能力。

因此,他们团队得出一个结论:这背后的核心不在数据量,而在:是否对齐到统一的表示空间。

一个典型能力是:直接从视频生成网页代码(vision-to-code)。这类能力,不是单一模态能产生的。

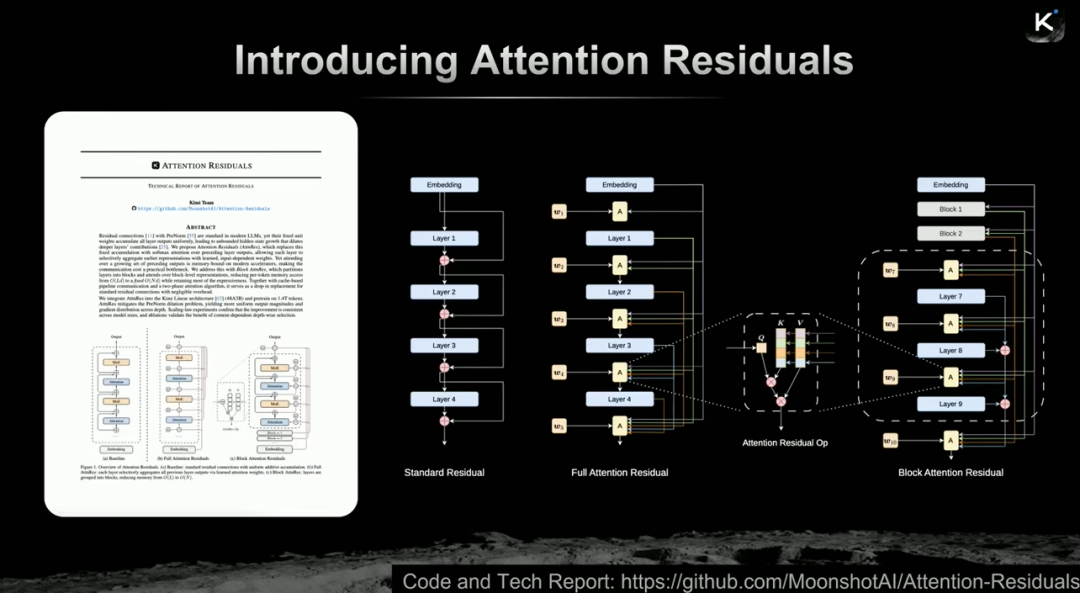

此外,杨植麟也在分享中确认了:上周刷屏的 Kimi 新论文“attention residual”正是下一代模型架构的预告。

Ps:这里再简单科普下这篇论文。

在Transformer架构中,传统残差连接,只连接“上一层”;而 Kimi 的 attention residual,要求当前层可以“关注所有历史层”。相当于把 attention 从“时间维度”,扩展到“深度维度”。

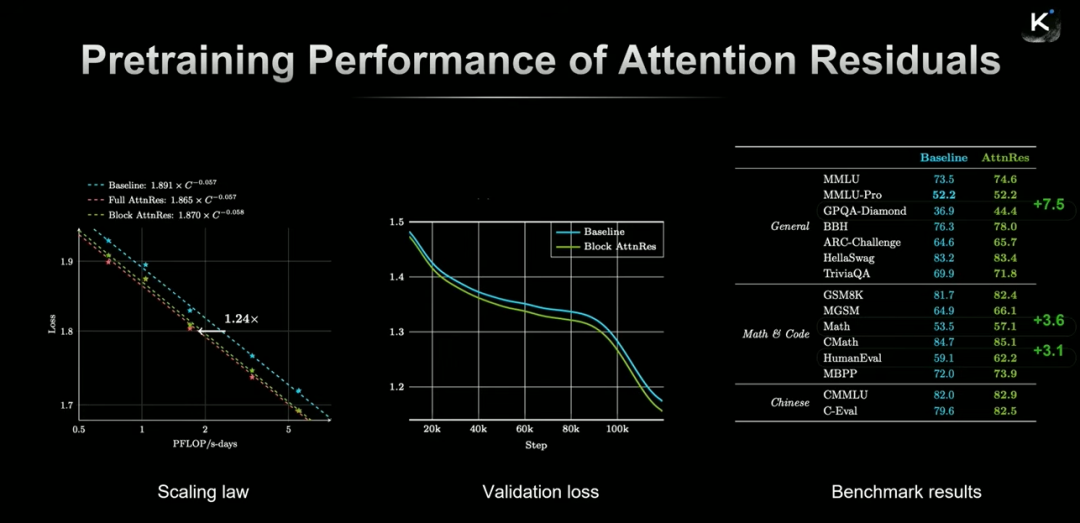

初步结果显示:token efficiency 提升约 24%;在代码、数学等任务上明显提升。

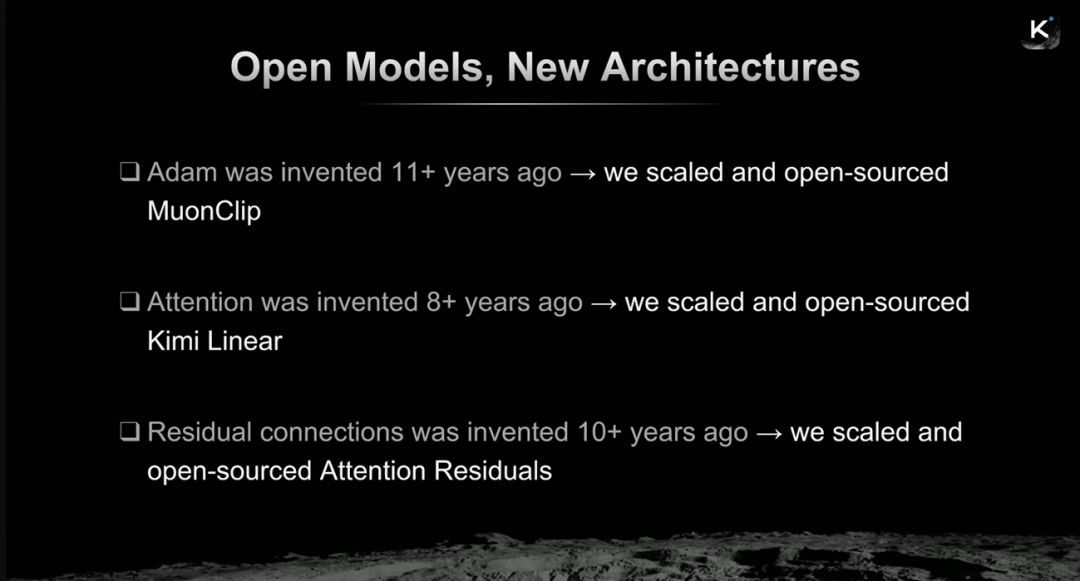

这释放出一个强烈信号:今天很多被视为“基础设施”的结构,attention也好,optimizer、residual 也好,依旧有很大的空间等待被重写。

Kimi 已经下场重新发明模型的“基础设施”了!

此外,杨植麟最后提到一个更宏观的范式转变的判断:AI 研究正在从“提出想法”,转向“系统验证”。

原因也很现实:scaling law 提供了可验证路径,算力允许大规模实验,benchmark 让结果更可比较。这无疑也新AI时代的研究者们更多创新的机会和能力。

大量“老技术”正在被重新挖掘,并获得新突破。

以下是为大家梳理的、市面上少有的 Kimi 创始人的精彩观点,enjoy!

开源模型不能只是“开源”,还必须足够优秀

大家好。非常感谢刚才的介绍。很高兴来到这里。很高兴来到这里,也很高兴有机会和大家分享我们最近的一些进展和探索。

我们一直在重点推进的一件事,是构建更优秀的开源模型。我们相信“智能的民主化”。开源模型可以部署在任何地方,可以运行在本地服务器,也可以运行在云端,而且你可以访问模型的每一部分权重,而不是仅仅使用一个黑箱系统。

这一页其实是我引用了 Jensen Huang 今年在 CES 演讲中的一张图。可以看到,开源模型正在迅速缩小与闭源模型之间的差距,已经逼近前沿水平。我们相信,随着开源模型不断进步,智能会变得更加普及,让世界各个角落的人都能使用。

不过,开源模型不能只是“开源”,它还必须足够优秀。

Kimi让开源模型变强的三个方法

接下来我会讲,我们是如何让开源模型变得更强的。

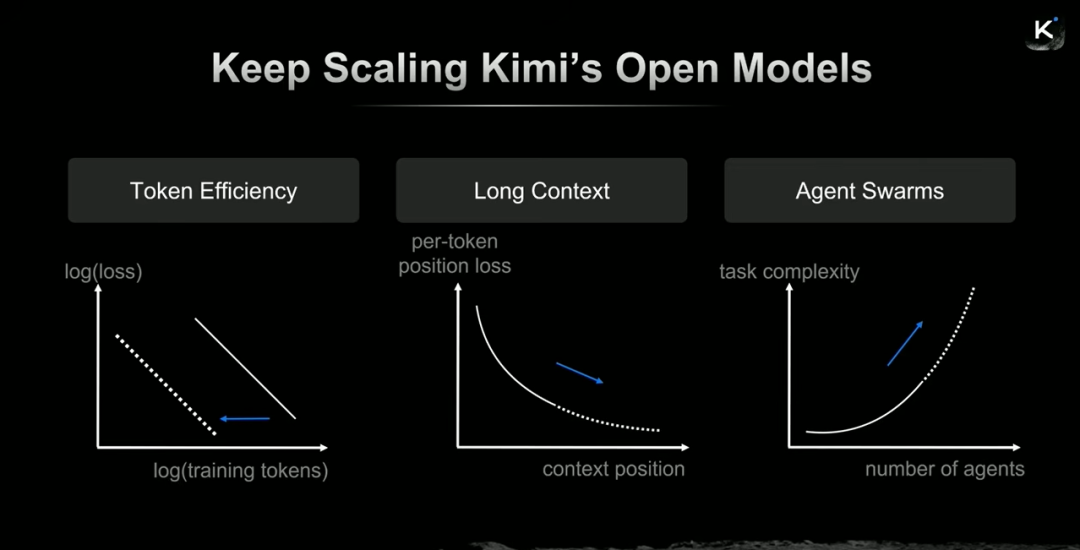

我们知道,过去几年几乎所有重要的 AI 进展,都离不开 scaling(规模扩展)。接下来我会从几个不同维度讲我们是如何扩展模型能力的。

第一是最经典的 scaling law。横轴是训练 token 数量的对数,纵轴是 loss 的对数。随着训练 token 增加,loss 会下降。但我们的目标不只是增加 token 数量,还要提升 token efficiency(token 利用效率)。也就是把整条曲线向左移动,用更少的数据达到更低的 loss。这需要更好的模型架构和优化器,我们后面会讲。

第二个维度是 context length(上下文长度)。当上下文变长时,在任意位置预测 token 的准确率都会提升,这意味着模型可以处理更复杂的任务。

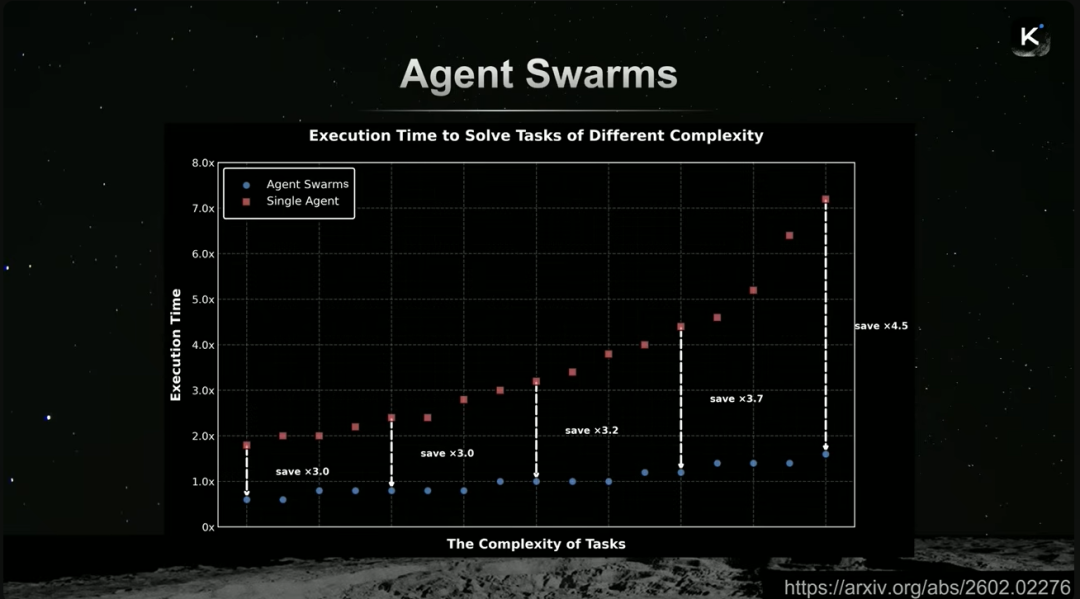

第三个维度是 agent 的数量。我们提出了一种新的学习范式——agent swarm(智能体群)。不再依赖单一 agent,而是通过多个 agent 并行协作完成子任务,从而提升整体任务能力。

图片

图片

如果把这三点用 agent 的语言来理解:一、token efficiency 对应的是更强的先验能力,让 agent 在强化学习中更高效地搜索更优解;二、长上下文意味着 agent 可以运行更长时间,甚至持续几天、几周甚至几个月,去完成复杂任务;三、agent swarm 则是在此基础上进一步扩展,让多个具备长上下文和强先验的 agent 协同工作。

最终,我们会得到一个系统:由大量 agent 组成的群体,每个 agent 都拥有超长上下文和强先验能力,在一个统一的 agent RL 系统中进行搜索和协作。

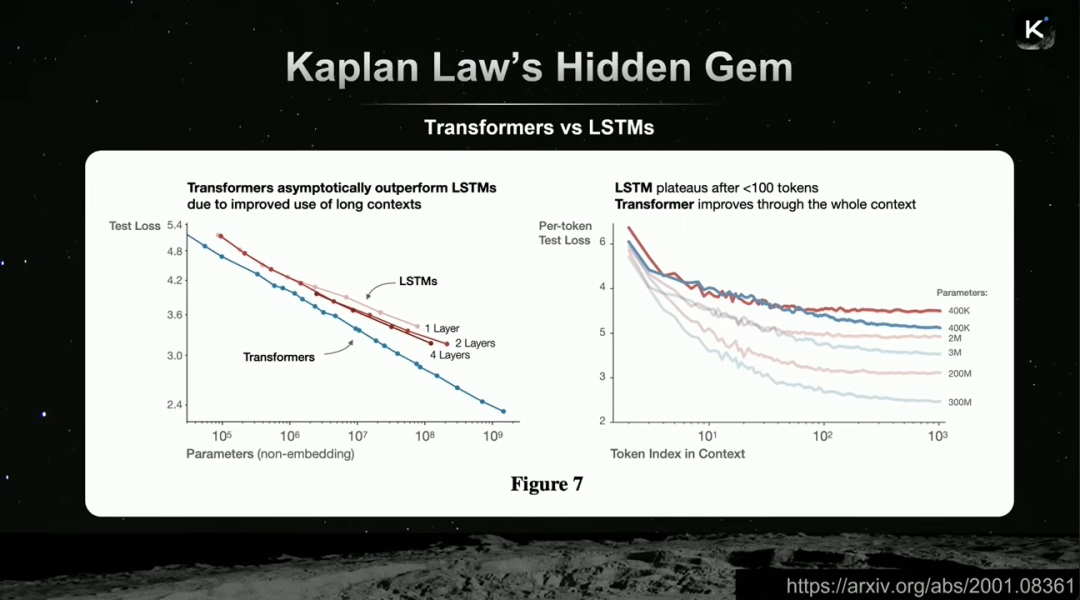

接下来从 token efficiency 开始讲。这是一张机器学习历史上非常经典的图,来自 Kaplan 等人的工作。它说明:如果按比例增加训练 token、模型参数和计算量,loss 会持续下降。这是过去几年 AI 能力提升的重要原因之一。

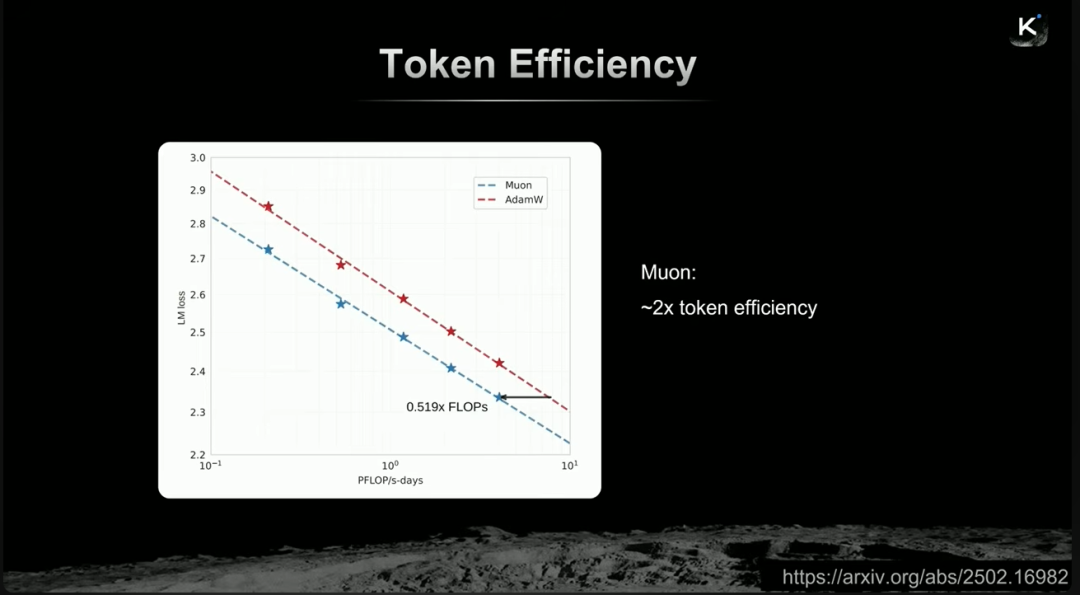

但我们更关心的是,如何进一步提升 token efficiency。

这里有一个关键点:token efficiency 不只是效率问题,它实际上决定了智能的上限。

举个例子,如果你有 50 万亿高质量 token,引入一种新的优化器,比如我们提出的优化器,让 token efficiency 提升 2 倍,那么等效上就像你拥有了 100 万亿 token。这几乎是“凭空创造数据”。

而现实是,我们正在逼近高质量数据的上限。如果数据总量是有限的,那么提升 token efficiency,就等于提升最终能达到的智能水平。所以这件事的意义远不只是节省算力,而是在推动智能边界本身。

这也是为什么我们在这方面投入了大量精力。

图片

图片

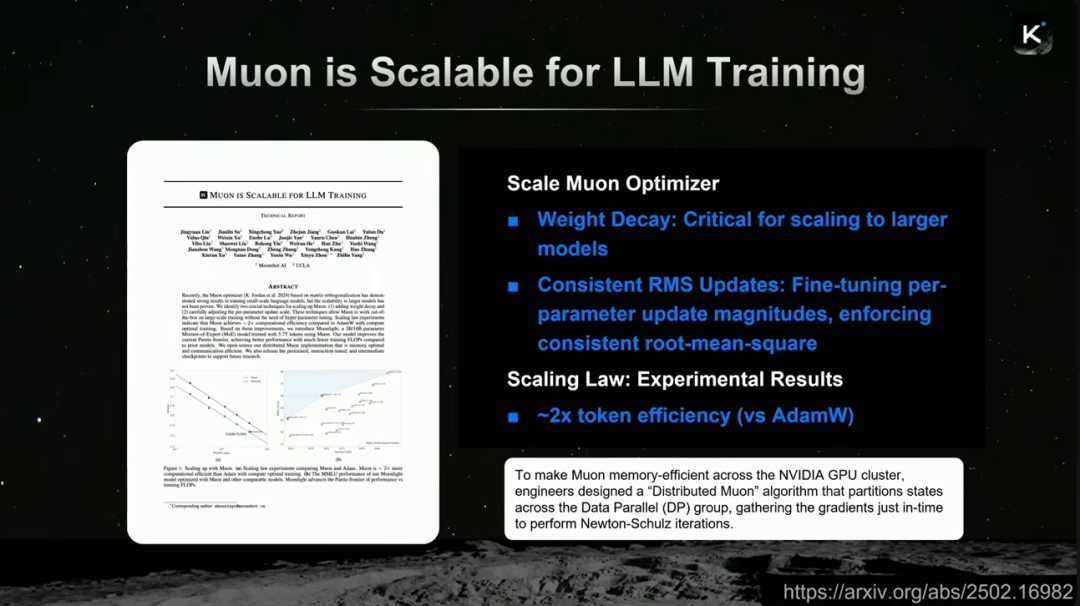

我们重点投入的一个方向是 muon optimizer。这是一个二阶优化器,它会对每一次梯度更新进行变换,使得各个分量之间相互正交,这和传统的 Adam 优化器有很大不同。如果实现得当,可以带来大约 2 倍的 token efficiency 提升。

图片

图片

我们是第一个证明这种优化器可以扩展到大规模 LLM 训练的工作。在工程实现上,有两个关键点:一是引入 decay,这对于扩展到更大模型非常关键;二是保持与 Adam 相似的 RMS 更新,我们通过一个可调系数来实现这一点。

同时,为了在 NVIDIA GPU 集群上实现高效训练,我们还做了分布式优化器实现,将状态分片到数据并行组中,从而降低内存开销。

实验结果显示,在参数规模和训练 token 数量完全相同的情况下,仅仅将 AdamW 替换为新的优化器,就可以在各项指标上带来显著提升。

但当我们继续扩大规模时,也遇到了新的问题。

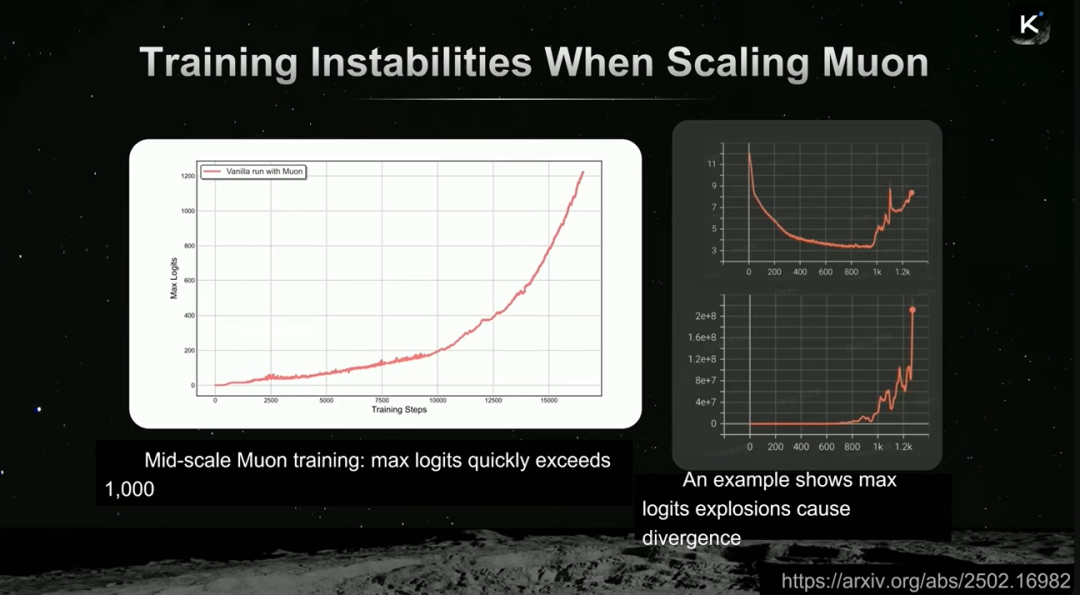

当我们把模型扩展到 1 万亿参数时,训练开始变得不稳定。可以看到,logits 的最大值迅速爆炸,超过 1000,而正常训练中通常在 50 到 100 之间。同时,训练 loss 虽然一开始下降,但随后发散,无法正常收敛。

这是我们必须解决的一个关键技术挑战。

图片

图片

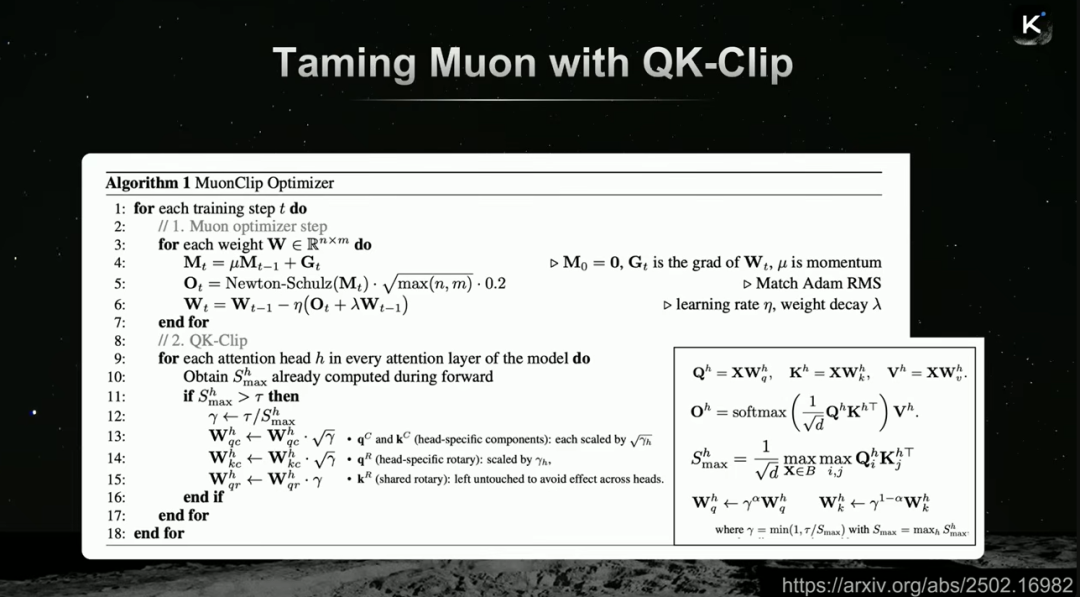

为了解决刚才提到的训练不稳定问题,我们引入了一种新的技术,叫做 QK clip。

它的核心思路是:在整个神经网络的每一个 attention head 中,在前向传播时计算当前的最大 logit,然后基于这个值计算一个缩放因子,这个因子会同时作用在 key projection 和 query projection 上,从而对 query 和 key 的最大值进行“裁剪”,把它们限制在一个合理范围内,避免数值爆炸。

图片

图片

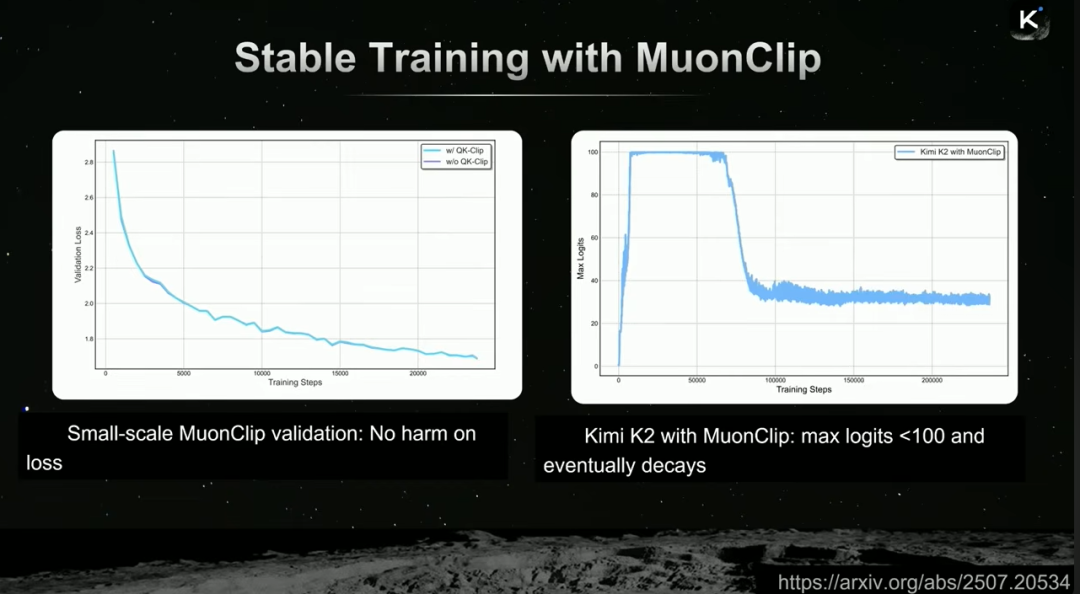

来看实验结果。左图有两条曲线,但几乎完全重合——分别是使用 clipping 前后的训练曲线。可以看到,这种 clipping 方法并不会影响训练 loss 的下降过程。

图片

图片

而右图展示的是中间指标,也就是最大 logit 的变化。可以看到,它一开始仍然会上升,但在达到大约 100 之后会被稳定地截断,在这个水平维持一段时间,然后随着训练继续,自然下降。也就是说,模型自己学会了如何控制 logit 的上界,从而保证训练稳定,同时不影响收敛效果。

我们在 K2 模型训练中使用了这项技术,成功将模型规模扩展到了 1 万亿参数。这也是机器学习历史上首次实现如此大规模的相关训练。

长上下文:Kimi Linear

接下来讲第二个维度:长上下文(long context)。

这张图相对没那么出名,但其实是论文中的“隐藏宝藏”。它从另一个角度解释了为什么模型能力可以提升。

论文地址:arxiv.org/abs/2001.08361

论文地址:arxiv.org/abs/2001.08361

这里对比的是 Transformer 和 LSTM。在左图中,在相同参数规模和训练 token 数量下,Transformer 的训练 loss 更低,这也是为什么 Transformer 成为当前的主流架构。

但更有意思的是右图。横轴是上下文中的 token 位置。随着 token 位置增加,Transformer 的 loss 持续下降,也就是说,随着上下文变长,它反而能更好地建模。而 LSTM 在一定长度之后就趋于饱和,不再改善。

这说明 Transformer 在捕捉长上下文方面具有更强能力。这也是它优于 LSTM 的关键原因之一。

如果回到十年前,LSTM 可以做机器翻译,但它无法理解完整代码库,也无法支撑一个超长时间运行的 agent,比如从零开始写一个 Linux kernel。这些任务对上下文长度的要求极高,而 LSTM 无法胜任。

在 agent 时代,这种能力变得非常关键。任务越来越复杂,我们需要更长的上下文。

因此,我们的研究目标是:设计一种新的架构,既能高效扩展上下文长度,又能在长序列中保持更低的 per-token loss。

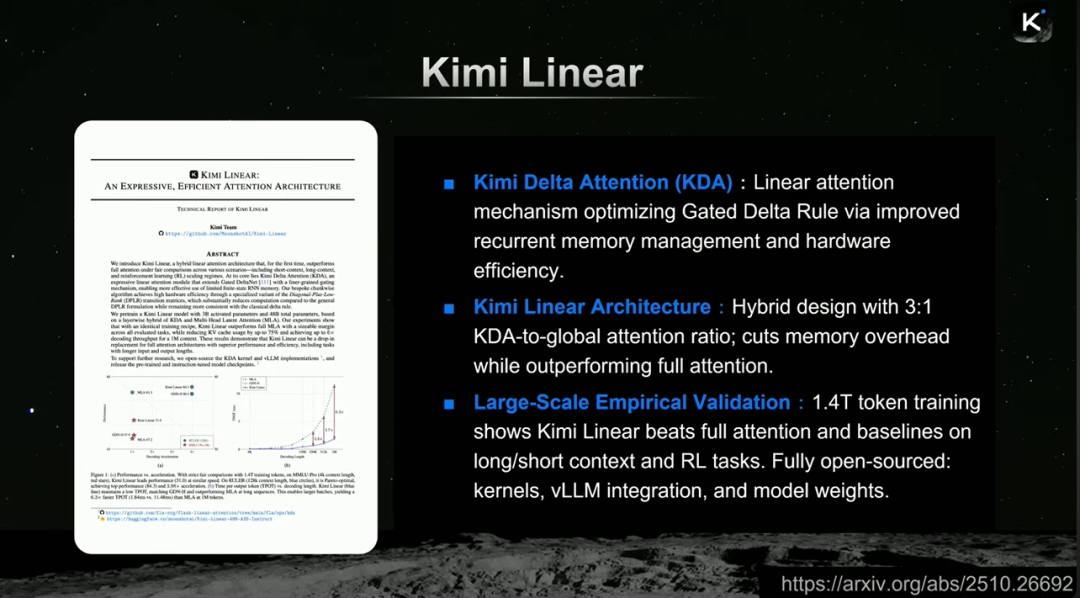

基于这个目标,我们提出了一种新架构:Kimi Linear。

它包含一种新的线性注意力变体,叫做 Kimi Delta Attention,在原有 delta rule 的基础上增强了递归记忆能力。同时,我们采用 1:3 的比例,将线性注意力层与全注意力层混合,从而在长上下文能力和计算效率之间取得平衡。

论文地址:arxiv.org/abs/2001.08361

论文地址:arxiv.org/abs/2001.08361

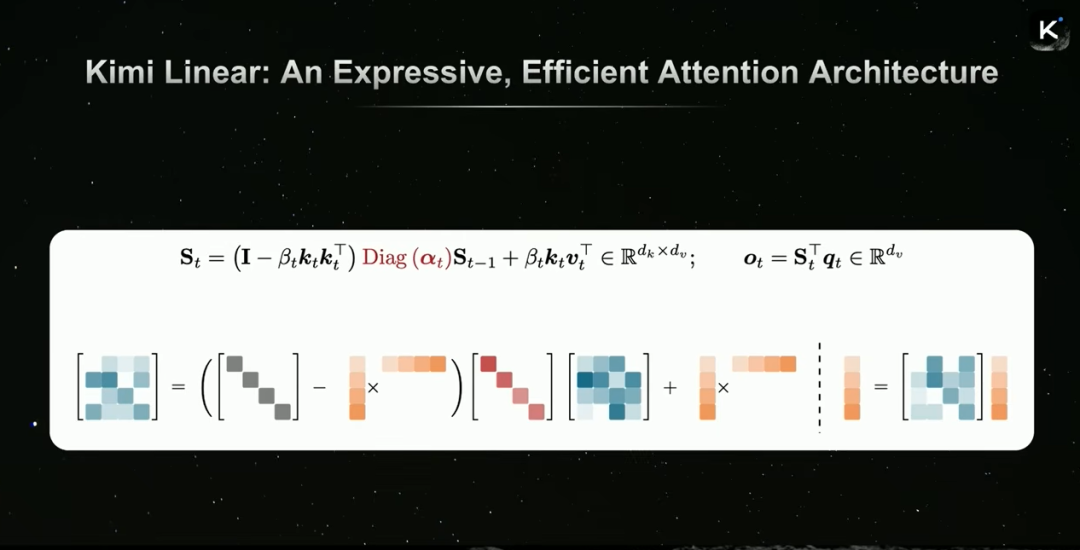

它的基本思想其实不复杂。

在传统的线性注意力中,记忆是“全局统一衰减”的,也就是用一个标量 decay factor 控制。这会带来两个极端:要么快速遗忘几乎所有信息,要么保留几乎所有信息,但无法选择性过滤不重要的内容。

为了解决这个问题,我们引入了一个关键改进:细粒度的衰减因子,也就是把原来的标量变成一个对角矩阵(alpha)。

这样一来,每个通道都有自己的衰减速率。部分通道可以非常慢地衰减,用于保留长时间跨度的信息;而另一些通道可以快速遗忘旧信息,用于不断刷新和吸收新的内容。

这大幅提升了模型的表达能力。

当然,为了适配现代 GPU,我们采用了 chunk-wise 的计算方式,实现并行化。但这也带来了新的工程挑战:因为 alpha 从标量变成矩阵,无法轻易提出做简化。

为了解决这个问题,我们对公式进行了重写,引入矩阵求逆和累计衰减因子,使得整个计算可以并行执行,而且这是严格等价的数学变换,并不是近似。

这样我们就实现了一个既高效又更具表达能力的架构。

实验结果也验证了这一点。在公平对比下:在短上下文任务(如 MMLU)上,Kim Linear 优于 MLA 和 GDA;在长上下文任务(如 RULER)上,它同样表现更好,同时计算效率更高。

当上下文长度扩展到 100 万 token 甚至更长时,它相比基线方法的优势更加明显。

更重要的是,这是第一个在所有场景下都能超越 full attention 的架构——无论是短上下文、长输入,还是长输出任务。

Agent Swarm:Kimi开发智能体集群的核心算法

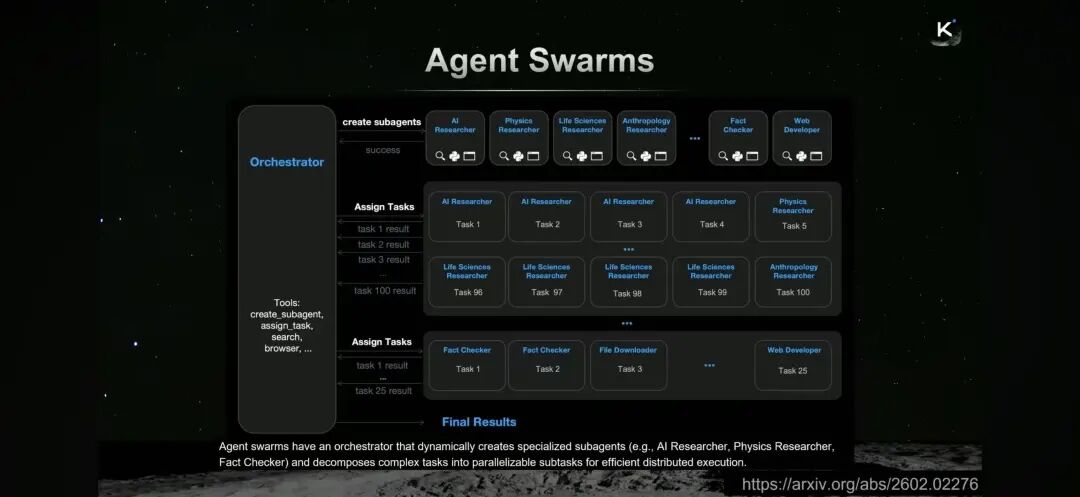

接下来讲第三个维度:agent swarm。

这里有一个示意图,展示我们如何通过 agent swarm 来解决比单一 agent 更复杂的任务。

图片

图片

这个系统中会有一个 orchestrator(调度器),也可以理解为主 agent,负责整体任务编排。它有多种操作方式,比如可以生成一组子 agent,并给它们分配不同任务;也可以收集这些子 agent 的执行结果,然后不断迭代这个过程。最终,你可以完成比单一 agent 更复杂的任务。

这个结构其实很像人类社会。比如一个公司,需要不同角色协作,需要一个类似 CEO 的角色来拆解任务、分配任务。最终,整个组织朝着同一个目标推进。

举个例子,你可以有 AI 研究员、Web 开发者、物理学研究者,他们分别研究不同问题。最后再生成一组“事实核查员”、开发者、数据下载器,把所有结果整合成一份完整报告。

从另一个角度看这个范式:横轴是任务复杂度,纵轴是执行时间。复杂度可以通过模型在任务上的准确率来衡量。可以看到,相比单一 agent,agent swarm 可以显著降低执行时间,整体效率更高。

这意味着,我们可以把 agent swarm 扩展到更大规模——比如运行 100 个甚至 1000 个子 agent,在一个可接受的时间内完成复杂任务,从而真正产生经济价值。

而且这种扩展是多维度的:可以扩展输入,比如并行读取上百甚至上千个信息源;可以扩展输出,比如并行生成一篇 100 页的综述;也可以扩展行动能力,比如同时执行多个数据分析任务。本质上,这是在做大规模编排(orchestration)。

当然,这也带来一个关键能力要求:你必须学会设计子任务,并有效聚合结果。

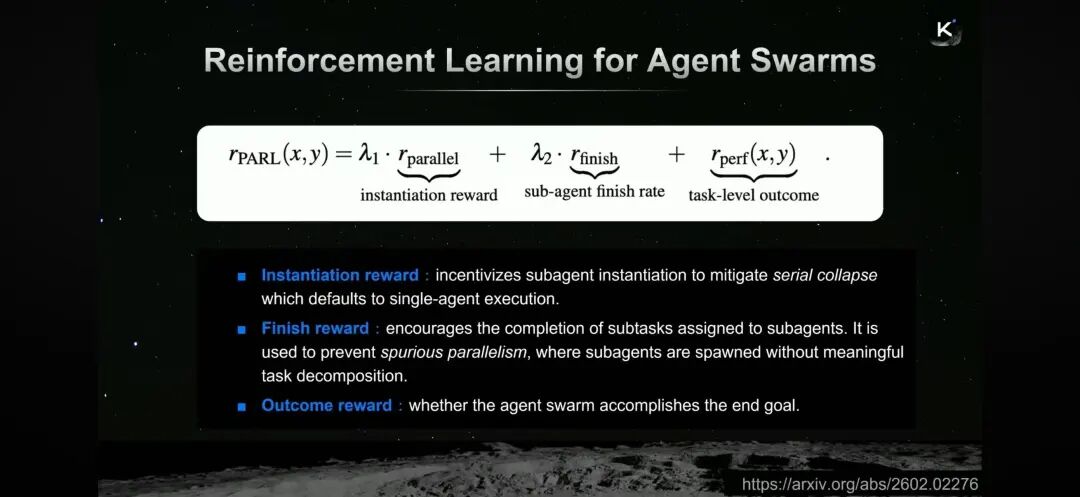

在技术上,我们为 agent swarm 的训练设计了一套新的目标函数体系,相比传统的单 agent 强化学习,引入了三个奖励项。

论文地址:arxiv.org/abs/2602.02276

论文地址:arxiv.org/abs/2602.02276

第一个是 instantiation reward(实例化奖励),用于鼓励生成子 agent,避免模型退化回单 agent 执行。特别是在训练早期,我们希望它更多探索并行执行的可能性。随着训练推进,这个奖励权重会逐渐降低。

第二个是 finish reward(完成奖励)。我们发现一个问题:模型可能会“作弊”,不断生成子任务,但并不真正完成它们。为了解决这个问题,我们引入完成奖励,鼓励每个子任务都有较高完成率,确保这些任务是有意义的,而不是“伪任务”。这个奖励同样在训练初期权重较高,后期逐步降低。

第三个是 outcome reward(结果奖励),这是传统目标,用于评估整个任务是否完成。

这三个奖励共同构成了 agent swarm 的强化学习目标函数。同时,我们还需要构建完整的基础设施,支持并行执行、多奖励函数计算,以及整体系统效率优化。

图片

图片

总结一下,我们在三个维度上做了扩展:(1)通过 muon optimizer 提升 token efficiency;(2)通过 Kimi Linear 架构提升长上下文能力;(3)通过 agent swarm 引入新的扩展维度。

基于这些,我们发布了新的模型:Kimi K2.5。下面的视频展示了一些能力。

图片

图片

我们在这个模型中观察到了很多有意思的新能力。比如,它把视觉能力和编程能力融合在一起,产生了一些新的涌现能力。它可以读取一段视频,然后生成一个网站,对视频进行风格迁移或内容复现。

这些能力的出现,依赖于预训练阶段的稳定和成功。

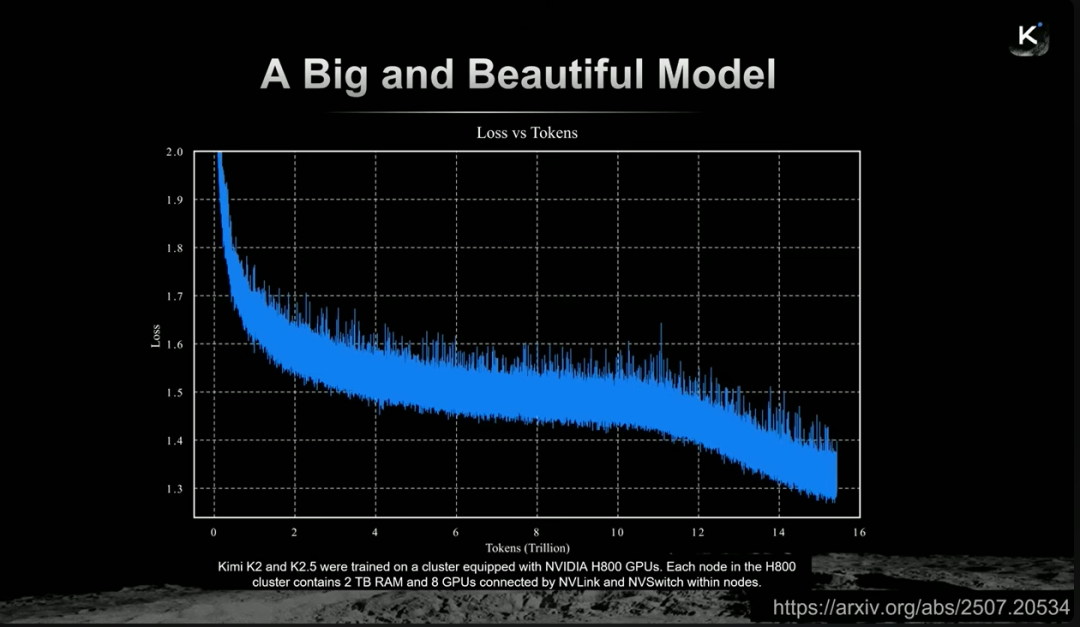

这是我见过最“优雅”的训练曲线之一。K2.5 的训练总共经历了超过 15 万亿 token,之后我们又额外增加了 15 万亿 token。整个训练过程非常稳定,没有出现 loss spike,尤其是在引入新的 m optimizer 之后。

论文地址:arxiv.org/abs/2507.20534

论文地址:arxiv.org/abs/2507.20534

这种平滑稳定的训练过程,最终带来了一个非常稳健的基础模型,可以在其上进一步微调,获得新的能力。

这个模型是在 NVIDIA 的 H800 GPU 集群上训练的。每个节点拥有约 2TB 内存,通过高速互联进行连接。

K2.5另一个关键创新:文本和视觉联合建模

K2.5 还有一个关键创新:它是第一个原生支持“视觉 + 文本联合建模”的开源模型。

以往的开源模型,通常是在文本模型训练完成之后,再追加一部分视觉训练数据,相当于“后期融合”(late fusion)。比如先训练 20 万亿 token 的文本,再追加 2 万亿 token 用于视觉能力。

但 K2.5 不一样。我们从训练一开始就将视觉和文本 token 融合在一起,这种方式叫做 early fusion。

论文地址:arxiv.org/abs/2602.02276

论文地址:arxiv.org/abs/2602.02276

实验结果表明,这种方式优于后期融合。而且我们观察到的一些新能力,比如从视觉直接生成代码(vision-to-code),也正是来源于这种训练方式。

如果把视觉和文本拆开训练,这种能力是不会出现的。

要实现这一点,关键是把视觉和文本这两种模态对齐到一个共享的 embedding 空间,也就是统一的表示空间。

一个很有意思的发现是,这两种模态不仅可以融合,还可以相互增强。过去一直有一个挑战:给文本模型加入视觉能力,往往会对文本性能产生一定负面影响。但我们的实验发现,如果训练方式设计得当,这两者是可以互相提升的。

这是我们在训练过程中一个非常重要的发现。

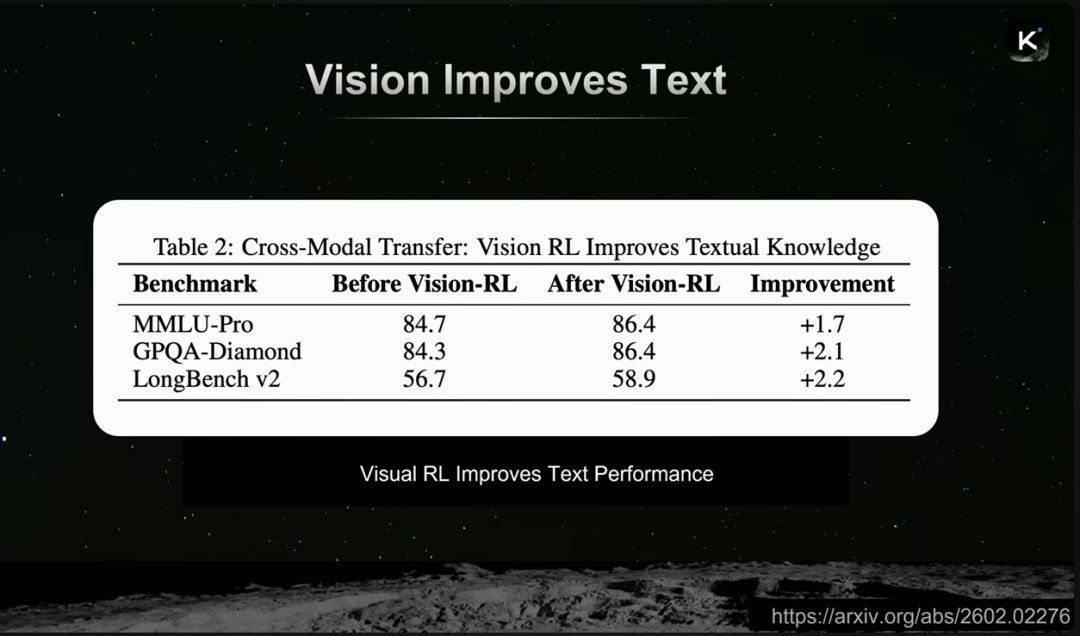

首先是“视觉提升文本”。这点非常有意思。我们对比了引入视觉强化学习(vision RL)前后的表现。这里的 vision RL 指的是只使用视觉任务进行训练,不涉及任何文本任务。比如让模型学习计数、做视觉问答,而不涉及数学或编程。

图片

图片

但结果是,这样的训练反而提升了模型在一些需要强推理能力的文本任务上的表现。

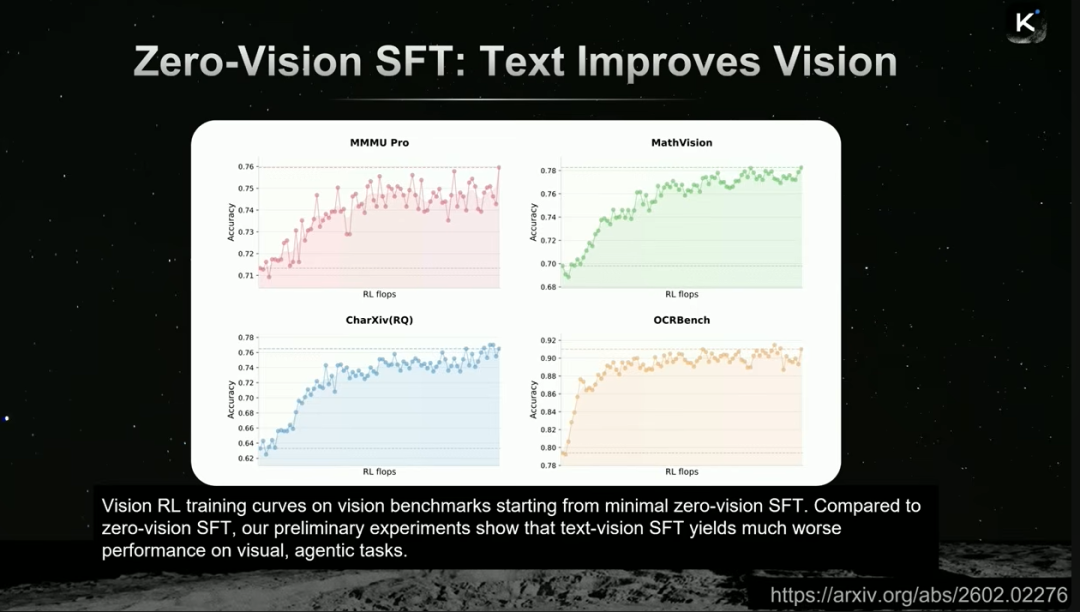

反过来,“文本也能提升视觉”。如果你的文本基础足够强,甚至不需要任何视觉 SFT 数据。这也是我们采用的方法。

我们称之为“zero vision SFT”。也就是说,我们几乎没有使用视觉监督微调数据,所有的 SFT 数据都是文本数据。然后在此基础上,对视觉和文本进行联合强化学习训练。

结果是,在没有视觉监督数据的情况下,我们依然在视觉任务上达到了接近 SOTA 的表现。这说明,只要在预训练阶段把视觉和文本对齐到同一个表示空间,强大的文本能力本身就能迁移到视觉能力上。

这也是一个非常清晰的信号:多模态的关键,不只是“加数据”,而是“对齐表示”。

前面视频里展示的一些例子,比如视觉设计能力、前端代码生成能力,本质上都来自这种视觉+文本的联合预训练。

图片

图片

下一代模型架构的预告:attention residual

讲完 K2.5,我们再简单讲一下最新的工作。我们昨天刚发布了一篇技术报告,提出了一个新架构:attention residual。这也可以看作是下一代模型架构的一个预告。

图片

图片

它的出发点很简单:我们能不能把在“时间维度”上的一些建模思想,迁移到“深度维度”上?

这要从 residual connection(残差连接)说起。我还记得 2016 年在 ICML 2016 上听相关分享。当时的突破非常关键——在 ResNet 出现之前,深层网络几乎无法训练,因为梯度消失、梯度爆炸等问题严重。

而残差连接的出现,让我们可以训练任意深度的网络。

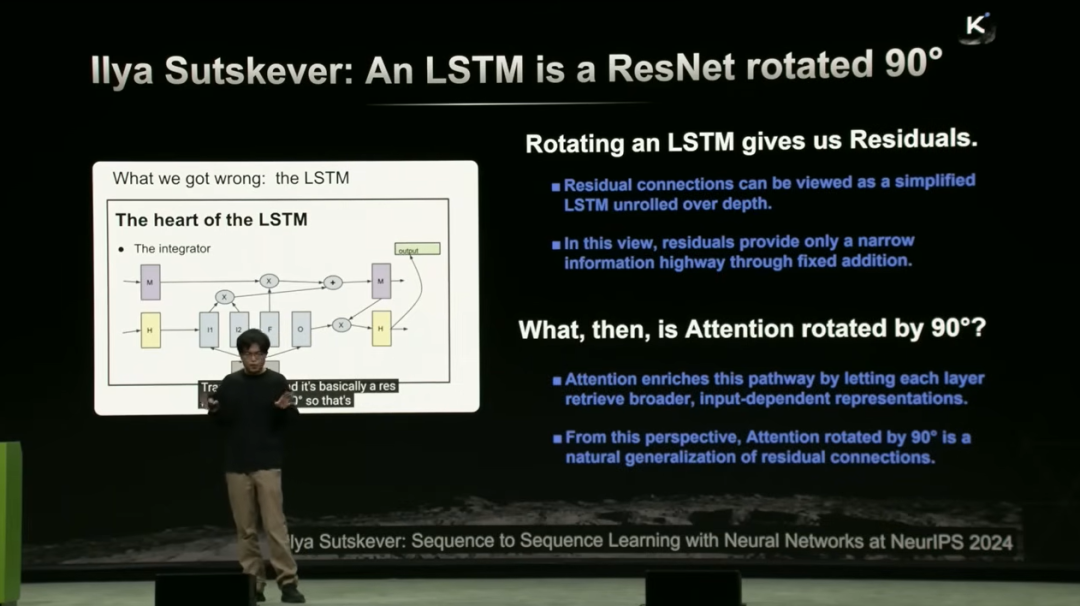

两年前 Ilya Sutskever 提出一个很有意思的视角:残差连接,其实可以看作是把类似 LSTM 的结构“旋转了 90 度”。

图片

图片

怎么理解?如果看 LSTM,它是一种递归网络,会把上一步的 hidden state 输入进来,通过某种函数生成当前状态。而在深度维度上,残差连接其实也是类似的:把上一层的输出,加到当前层的输出上。

形式不同,本质相似——都是在做一种“跨层的状态传递”。

但我们可以进一步思考:既然可以用加法(residual),能不能用 attention?

也就是说,不只是用上一层的 hidden state,而是把所有历史层的 hidden state 都拿出来,通过 attention 机制进行加权组合,生成当前层的表示。

这其实就是“把 attention 旋转 90 度”,应用在深度维度上。可以看作是对残差连接的一种自然推广。

当然,这会带来计算和通信开销的问题。所以我们提出了一个工程上的优化版本:block attention residual。

具体做法是,把网络分成多个 block,比如每个 block 包含 4 层或 16 层。在 block 内部,仍然使用标准残差连接;在 block 之间,才使用 attention residual。

这样可以在几乎不损失精度的情况下,大幅降低计算和通信开销。

实验结果也非常有意思:在 scaling law 上,token efficiency 提升了约 24%。换句话说,如果你有 50 万亿高质量 token,相当于变成了 6000 万亿级别的效果。

图片

图片

在验证集 loss 上,也可以看到整体曲线更低、更稳定。

图片

图片

在一些高难任务上,比如代码、数学、推理(如 GPQA、HumanEval),也取得了明显提升。

整个社区其实还在不断前进。很多我们今天认为“标准”的技术,其实仍然有很大的优化空间。

如果把这些 scaling 方法叠加起来,你可以得到一个更强的模型。

比如 Adam optimizer 是 2014 年提出的,而现在我们有了可以直接替换它的优化器(比如我们的方法)。在训练 Transformer 大模型时,如果用新的优化器,效果会显著更好。

Attention 机制是在八年前提出的,而现在我们有了 Kimi Linear 这样的线性注意力版本。我们不再需要在所有层中都使用 full attention,可以用线性注意力在长短上下文任务上同时取得更好的表现。

同样,残差连接也开始被重新审视,我们提出了开源的 attention residual,对这一方向进行了扩展。

图片

图片

大模型的研究思路正在转变

我觉得这个时代一个很有意思的变化是,我们做研究的思路正在发生转变。

如果回到 10 年前,研究更多是在提出一个新想法。但当时由于实验条件有限,很难做出足够严谨的验证,也就难以得出非常可靠的结论。

而现在不一样了。我们有 scaling law,有足够的算力资源去训练不同规模的模型,也有一整套 benchmark 来衡量进展。这使得我们更容易得出有信心、有说服力的结论。

这也是为什么我们看到,很多“老技术”正在被重新挖掘,并持续取得新的突破。我相信这种趋势还会继续,尤其是在开源社区中,我们会看到越来越多在架构和优化上的创新。

最后总结一下:我们会持续推进模型的 scaling。

目前主要是三个维度:token efficiency、长上下文,以及 agent swarm。但这不会是终点,未来还会出现新的 scaling 维度。

图片

图片

很高兴我们能够和整个开源社区一起,推动智能不断向前发展。

谢谢大家。

参考链接:https://www.you@tube.com/watch?v=CwePo4847ho

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

OpenClaw 真正的效率开关,不是 Prompt,而是多会话和子代理

10款免费AI语音输入工具与软件 轻松实现语音转文字

MCP 协议深度解析:构建 AI Agent 的「万能接口」标准

WorkAny Bot 云端AI Agent工具采用OpenClaw框架构建

Anthropic 的 Harness 启示:当 AI Agent 开始「长跑」,架构才是真正的天花板

SkyBot由Skywork研发的云电脑AI助手

AI Agent 智能体 - Multi-Agent 架构入门

Nano Banana 2 国内使用指南 LiblibAI 无需翻墙教程

一文搞懂卷积神经网络经典架构-LeNet

一文搞懂深度学习中的池化!

AI精选