XiaomiMiMoV2Omni小米发布全模态Agent基座模型

作者:互联网

2026-03-20

在人工智能技术快速发展的今天,Xiaomi MiMo-V2-Omni作为一款全模态基座模型,凭借其强大的多模态融合能力,正在重新定义智能Agent的边界。这款模型将引领我们探索更智能的人机交互方式。

Xiaomi MiMo-V2-Omni的核心特点

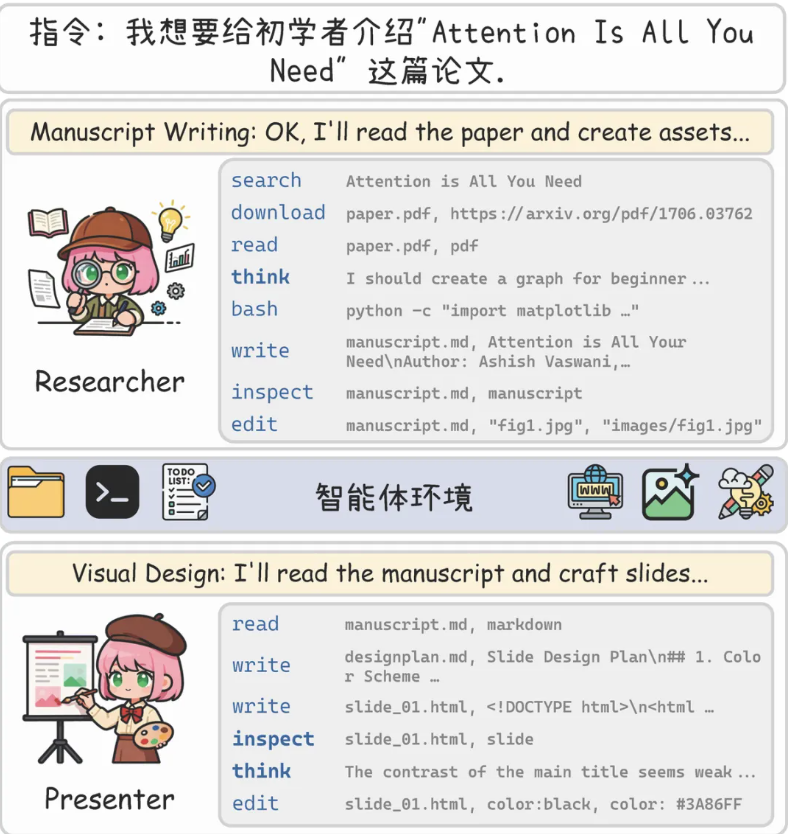

- 全模态感知能力:该模型整合了文本、视觉和音频三大模态,具备图像理解、视频分析、超长音频处理以及跨模态联合推理等强大功能。

- 智能执行系统:原生支持工具调用、GUI操作和自主任务规划,能够制定策略、实时调整并完整交付执行结果。

- 复杂环境适应:完美适配网页浏览、代码工程、前端开发等数字化场景的交互需求。

Xiaomi MiMo-V2-Omni的技术创新

- 统一多模态架构:从底层设计融合文本、视觉、语音的基础模型,通过统一编码器和融合层实现原生多模态表示,避免后期简单拼接。

- 感知执行一体化:突破传统模型"重理解轻执行"的限制,通过端到端训练将感知能力与工具调用、GUI操作等执行功能有机结合。

- 视频预训练技术:采用创新的视频预训练方法实现音视频联合理解,支持超长上下文建模,为复杂任务提供结构性支持。

Xiaomi MiMo-V2-Omni的重要参数

- 发布时间:2026年3月19日

- 测试代号:Healer Alpha(曾在OpenRouter匿名测试)

- 模型架构:全模态融合设计(文本+视觉+音频)

- 上下文支持:超长序列建模能力(参考同系列Pro版达1M)

- 性能表现:PinchBench排名第一,OpenRouter调用量榜首

- 接入方式:通过OpenRouter等平台API调用,兼容主流Agent框架

- 运行环境:云端部署,无需本地配置;支持多模态输入

Xiaomi MiMo-V2-Omni的竞争优势

- 原生多模态融合:从底层构建的统一架构实现真正的跨模态理解与联合推理。

- 智能执行体系:将感知能力与工具调用、GUI操作等功能深度融合,形成"精准感知-高效执行"的闭环。

- 超长上下文处理:百万级上下文窗口在处理长视频、音频及复杂任务时具有明显优势。

- 实战验证效果:以Healer Alpha代号测试期间,获得OpenRouter调用榜首和PinchBench第一的成绩。

- 生态兼容性:可快速集成主流Agent框架,降低全模态应用落地难度。

Xiaomi MiMo-V2-Omni的使用方法

开发者可通过指定平台注册获取API密钥,按照每百万tokens输入0.4美元、输出2美元的定价标准调用接口。

Xiaomi MiMo-V2-Omni的行业对比

| 评测维度 | MiMo-V2-Omni | Gemini 3 Pro | Claude Opus 4.6 |

|---|---|---|---|

| MMAU-Pro(音频理解) | 69.4 | 67.0 | – |

| MMMU-Pro(图像理解) | 76.8 | 81.0 | 73.9 |

| Video-MME(视频理解) | 85.3 | 88.4 | – |

| CharXiv RQ(图表理解) | 80.1 | 81.4 | 77.4 |

| FutureOmni(未来预测) | 66.7 | 62.9 | 60.3 |

| MM-BrowserComp(网页浏览) | 52.0 | 37.2 | 59.3 |

| OmniGAIA(多模态感知) | 49.8 | 62.5 | 59.7 |

| Claw Eval(复杂交互) | 54.8 | 51.9 | 66.3 |

| PinchBench(Agent综合) |

相关标签:

AI工具

AI项目和工具

相关推荐 专题 + 收藏 + 收藏 + 收藏 + 收藏 + 收藏 最新数据 相关文章 NanoClaw 开源轻量级个人AI助手 安全可靠的OpenClaw替代方案 03/30

MonsterClaw 采用 OpenClaw 技术打造的本地化AI运行平台 03/30

TinyClaw 由TinyAGI推出的开源轻量级多智能体协作框架 03/30

携程酒店业务借助NebulaGraph实现月均风控止损逾百万元 03/30

稀宇科技开源MiniMax Office Skills生产级办公文档引擎 03/27

ToClaw由ToDesk打造的专业定制AI智能体 03/26

TypeNo 免费开源的中文AI语音输入法 无需配置直接使用 03/26

Sub2API 开源人工智能API中转网关平台 具备多账户管理功能 03/26

阿里通义推出视频生成音频框架PrismAudio 03/26

Luma AI发布Uni-1模型实现图像理解与生成一体化 03/25

AI精选 |