腾讯联合浙大推出音频驱动肖像动画框架Sonic

作者:互联网

2026-03-29

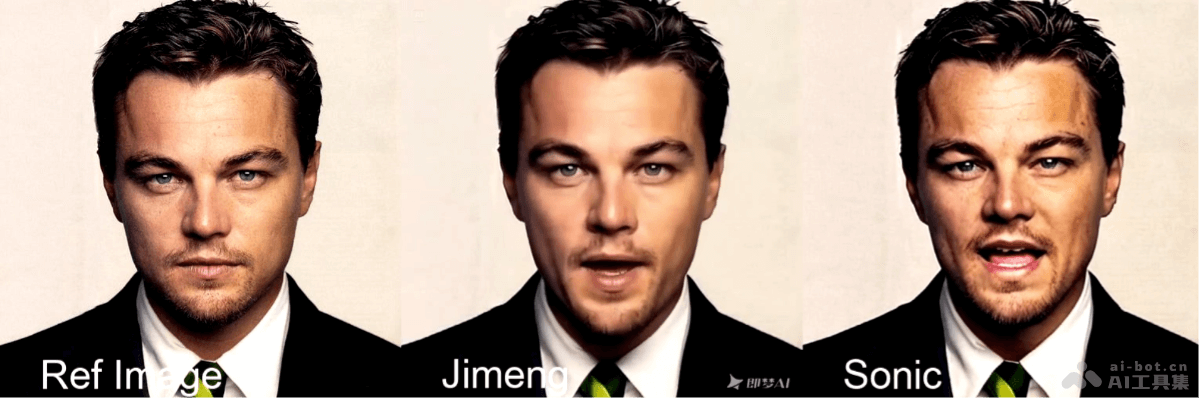

Sonic作为新一代音频驱动动画技术,通过创新算法实现了高度自然的面部表情与动作同步,为数字内容创作带来全新可能。下面将从技术原理到实际应用全面解析这一框架。

Sonic的核心特点

- 精准唇形同步:采用先进音频分析技术,确保语音内容与嘴型动作完美匹配。

- 多样化表情控制:支持生成丰富自然的面部微表情和头部动作,增强表现力。

- 长时间稳定性:独特的时序处理机制有效避免长视频中的画面抖动问题。

- 灵活参数调节:提供多维度控制选项,用户可自定义运动幅度和表情强度。

Sonic的技术实现

- 上下文音频分析:通过Whisper-Tiny模型提取多尺度音频特征,结合交叉注意力机制,将语调、语速等信息转化为面部动作指令。

- 独立运动控制:采用头部与表情解耦设计,通过motion-bucket参数分别调节,实现更精细的运动控制。

- 时序融合机制:基于滑动窗口策略逐步整合全局音频信息,确保长时间视频生成的连贯性。

- 纯音频驱动:完全依赖音频信号生成动画,无需视觉输入,提升生成效率和自然度。

Sonic的性能表现

- 量化评估:

- 在HDTF和CelebV-HQ数据集测试中,FID、FVD等关键指标均优于现有方案。

- 同步精度(Sync-C/D)和流畅度(Smoothness)评分显著领先同类技术。

- 质量对比:在处理复杂场景时展现出更强适应性,能保持高质量的表情生成效果。

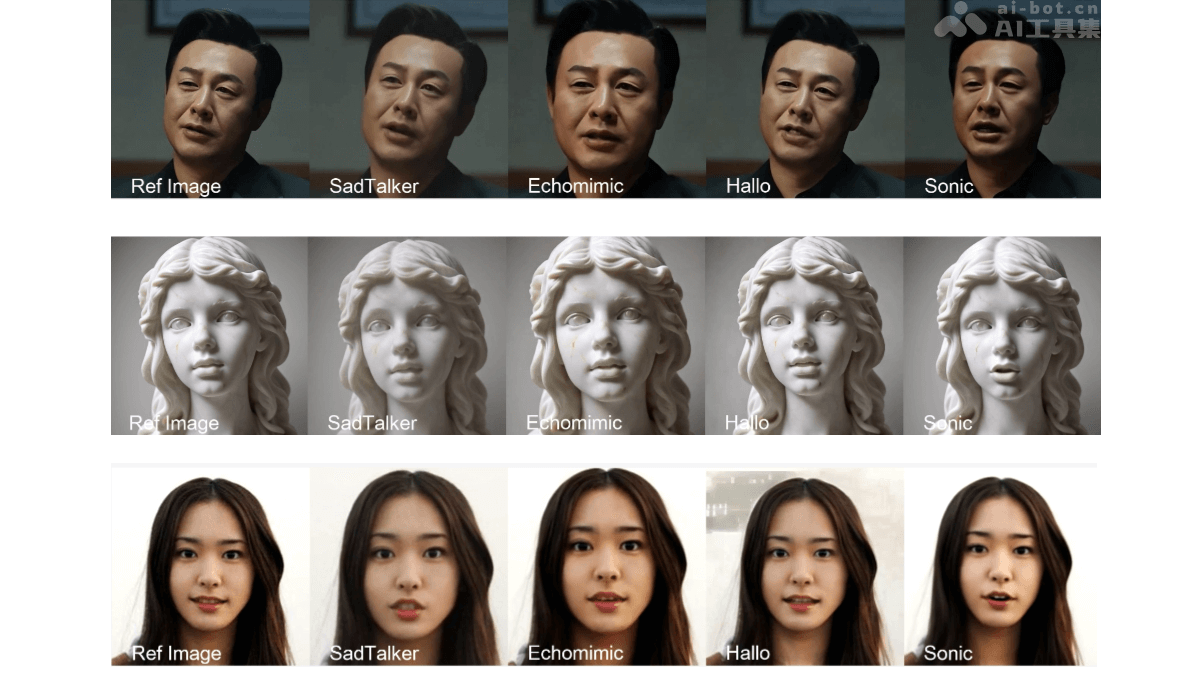

Sonic的实际效果

- 开源方案对比:生成的表情更丰富自然,头部运动更具韵律感。

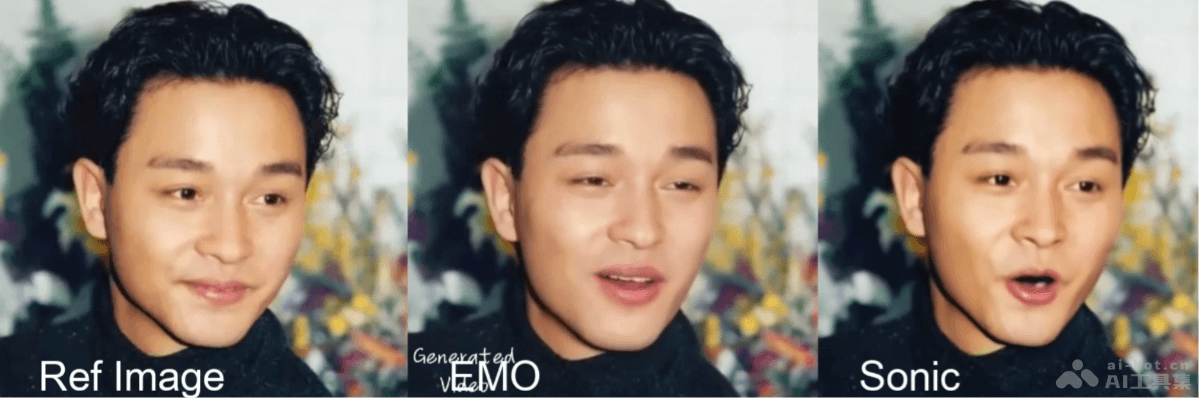

- 商业方案对比:

- 与EMO比较

- 面部微表情更细腻,眼镜反光等细节处理更真实。

- 与EMO比较

- 歌唱场景:发音口型更准确,伴随自然的肢体语言。

- 动漫案例:完美保留角色特征,眨眼等细节动作更丰富。

- 长视频表现:避免末端伪影问题,保持全程稳定性。

Sonic的资源获取

- 项目官网:https://jixiaozhong.github.io/Sonic/

- GitHub仓库:https://github.com/jixiaozhong/Sonic

- 技术论文:https://arxiv.org/pdf/2411.16331

- 在线演示:http://demo.sonic.jixiaozhong.online/

Sonic的应用领域

- 虚拟现实:为数字人赋予逼真表情能力

- 影视制作:加速动画制作流程

- 在线教育:打造互动式教学体验

- 游戏开发:提升角色表现力

- 社交娱乐:创造个性化视频内容

Sonic框架通过技术创新突破了传统动画生成的局限,为多领域应用提供了高效优质的解决方案,展现出音频驱动技术的巨大潜力。

相关标签:

即梦AI

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

我让 Claude 和 Codex 同时审计 26 个模块,它们只在 10 个上达成共识

03/30

OpenClaw 多智能体部署:弹性扩展、零运维

03/30

STranslate 多功能免费AI翻译工具 支持离线OCR识别

03/30

Claude在得物App数仓的深度集成与效能演进

03/30

南京大学提出基于区域感知的RAG-Diffusion文本图像生成技术

03/30

人民大学携手快手与清华共同发布通用对口型框架OmniSync

03/30

有了AI大家的日常是轻松了还是更焦虑了呢?

03/30

我想搭建一个AI编程平台:让每个人都能用提示词“召唤”出想要的项目

03/30

腾讯联合浙大推出音频驱动肖像动画框架Sonic

03/29

如何用AI制作红包封面一分钟免费搞定

03/29

AI精选