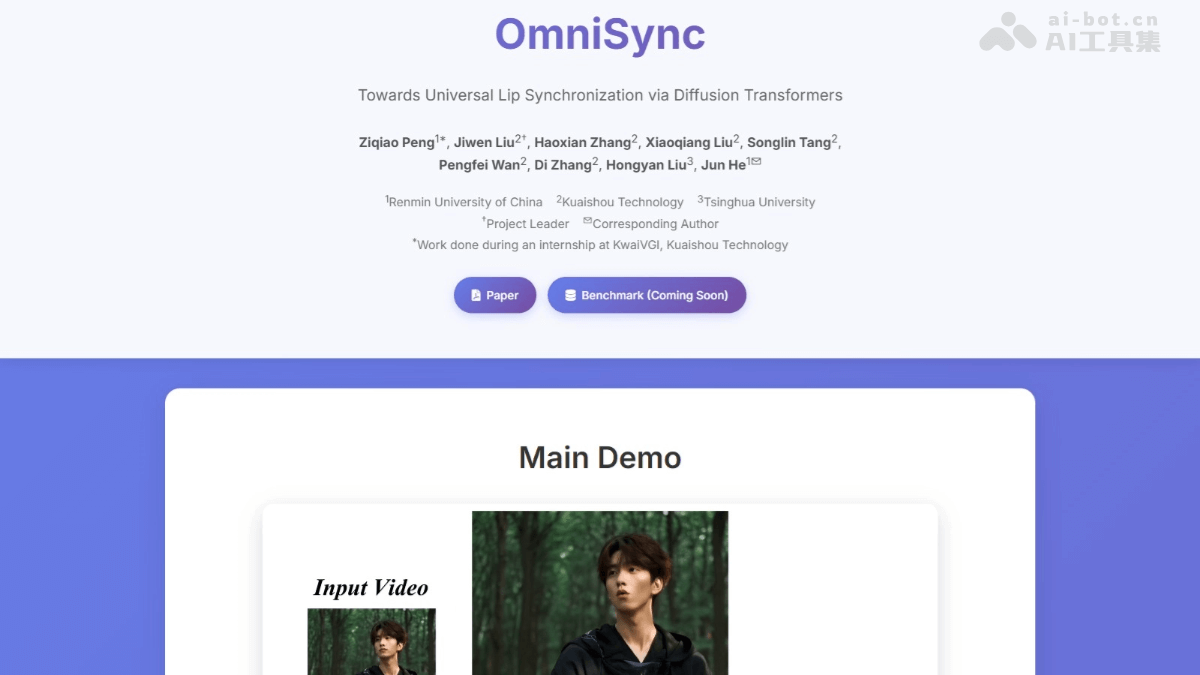

人民大学携手快手与清华共同发布通用对口型框架OmniSync

作者:互联网

2026-03-30

OmniSync作为前沿的口型同步技术,通过创新算法实现视频人物口型与语音的精准匹配。该技术由国内顶尖学术机构联合研发,采用扩散变换器等先进方法,为影视、虚拟现实等领域提供全新解决方案。

OmniSync是什么

这项由中国人民大学、快手科技和清华大学共同研发的技术,采用扩散变换器框架实现视频口型同步。其创新之处在于无掩码训练范式,可直接编辑视频帧而不需要参考帧或显式掩码。该技术支持无限时长推理,同时保持面部动态的自然性和身份一致性。通过流匹配基础的渐进噪声初始化与动态时空分类器自由引导机制,有效解决了音频信号弱的问题,确保口型同步的精确度。值得一提的是,OmniSync还建立了专门的AIGC-LipSync基准测试体系,用于评估AI生成视频中的口型同步性能。

OmniSync的主要功能

- 无掩码训练:采用直接编辑视频帧的创新方法,摆脱了对参考帧或掩码的依赖,支持无限时长的推理过程。

- 身份保持:在精确修改嘴部区域的同时,确保头部姿态和身份特征的一致性。

- 增强音频条件:运用动态时空引导机制,有效解决音频信号弱带来的同步问题。

- 通用兼容性:不仅适用于普通视频,还能兼容风格化角色、非人类实体以及AI生成内容。

- 无限时长推理:保持面部动态的自然流畅和时间维度的一致性。

- 遮挡鲁棒性:即使在面部遮挡等复杂条件下,仍能保证高质量的口型同步效果。

OmniSync的技术原理

- 无掩码训练范式:基于扩散变换器技术实现直接跨帧编辑,无需使用显式掩码或参考帧。通过迭代去噪学习映射函数,结合时间步依赖采样策略,在不同去噪阶段使用特定数据集,确保学习过程的稳定性。

- 渐进噪声初始化:运用流匹配技术将控制噪声注入原始帧,仅执行最后的去噪步骤,既保持了空间一致性,又实现了嘴部区域的精确修改,有效解决了姿态不一致和身份漂移问题。

- 动态时空分类器自由引导:该技术提供对音频影响的精细控制,基于时空自适应引导原理,能够平衡音频条件强度。其中空间自适应引导采用高斯加权空间引导矩阵,将引导强度集中在嘴部区域;时间自适应引导则会随着去噪过程推进而逐渐降低强度,确保在早期和中期扩散阶段提供强引导,在后期细化阶段减少干扰。

OmniSync的项目地址

- 项目官网:https://ziqiaopeng.github.io/OmniSync/

- arXiv技术论文:https://arxiv.org/pdf/2505.21448

OmniSync的应用场景

- 影视配音:实现影视作品中角色口型与配音的完美匹配。

- 虚拟现实:为虚拟角色提供逼真的口型同步效果,显著提升沉浸感。

- AI内容生成:大幅提升AI生成视频中口型同步的自然程度。

- 视频会议:改善远程通信场景下的口型同步效果。

- 游戏开发:增强游戏角色的口型表现力,提升整体交互体验。

作为视频口型同步领域的创新技术,OmniSync通过多项技术突破解决了行业痛点,为影视制作、虚拟现实等应用场景提供了可靠的技术支持,展现出广阔的应用前景。

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

一文搞懂深度学习中的池化!

厦门大学DeepSeek大模型助力高校企业政府发展 PDF文件 AI教程资料

RAG 不一定非得靠向量库:一套更偏工程落地的“结构化推理检索”方案

北京大学DeepSeek与AIGC应用PDF AI教程资料

开源项目 superpowers 深度解读:把 AI Coding Agent 变成遵守工程流程的协作伙伴

金灵AI深度体验报告 CSDN推出金融投研AI智能助手

GSD 使用指南:高效交付功能的结构化工作流

AI生成艺术版权问题解析 快速了解关键要点

# AI 终于能"干活"了——Function Calling 完全指南

清华大学AIGC发展研究报告3 0 PDF版 AI教程资料

AI精选