SuperGPQA与豆包大模型及MAP联合开源知识推理基准测试集

作者:互联网

2026-03-19

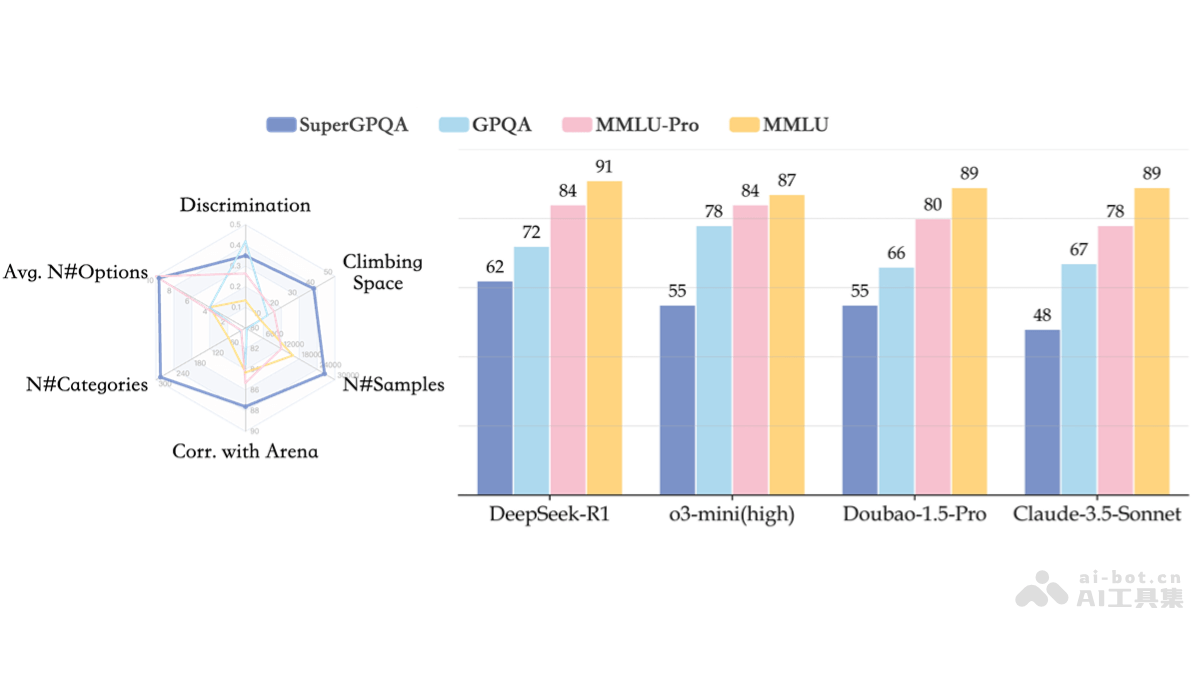

SuperGPQA作为新一代大语言模型评估基准,凭借285个学科覆盖和26529道专业题目,重新定义了知识推理测试标准。其独特的多维度评估体系为AI研究提供了全新视角。

SuperGPQA是什么

这款由专业团队开发的测试集突破了传统基准的局限,全面覆盖研究生级学科领域。26529道题目中,42.33%涉及数学计算和严谨推理,能精准评估模型的真实推理水平。其独特的专家-模型协同构建机制确保了题目质量和难度。

SuperGPQA的主要功能

- 全面评估大语言模型能力:涵盖285个学科领域,包括冷门专业,有效测试模型在不同领域的知识储备和推理水平。

- 深度检测推理能力:超过四成题目需要数学运算或形式推理,确保评估重点放在复杂任务处理而非简单记忆。

- 构建跨学科分析体系:同时包含STEM和非STEM领域,为比较模型在各学科表现提供统一标准。

- 弥补长尾学科空白:特别关注轻工业、农业等传统测试忽略的领域,实现更全面的评估覆盖。

- 指导模型优化方向:通过测试结果准确识别模型短板,为改进训练方法提供数据支持。

SuperGPQA的技术原理

- 专家与AI协同开发:

- 严格筛选来源:专家从权威教材和网站精选原始问题,避免众包数据质量问题。

- 规范化处理:对题目进行语言和格式标准化,确保统一的学术表述和选择题格式。

- 多重质量把控:通过规则过滤、AI检测和专家复核三级审查,保证题目质量和区分度。

- 多模型交叉验证:采用多个先进模型进行多维检测,有效规避数据泄露风险,提升题目可靠性。

- 跨学科语义设计:运用t-SNE等技术分析题目语义特征,保持各学科语言特色同时确保科学类问题的相似性。

- 高难度题目设计:42.33%题目涉及复杂运算或推理,重点考察模型处理挑战性任务的能力。

SuperGPQA的项目地址

- 项目官网:https://supergpqa.github.io/

- GitHub仓库:https://github.com/SuperGPQA/SuperGPQA

- HuggingFace模型库:https://huggingface.co/datasets/m-a-p/SuperGPQA

- arXiv技术论文:https://arxiv.org/pdf/2502.14739

SuperGPQA的应用场景

- 全面模型评估:精确测试大模型在跨学科领域的知识和推理能力。

- 训练优化指导:帮助研发团队发现模型缺陷,调整训练策略。

- 跨学科对比研究:支持不同专业领域模型表现的对比分析。

- 教育创新应用:推动智能教育工具开发和AI教学应用研究。

- 行业解决方案测试:为医疗辅助、智能客服等提供专业评估工具。

SuperGPQA通过创新的评估维度和严谨的构建方法,为大语言模型发展提供了关键的评测基准,将持续推动AI技术在各领域的深入应用。

相关标签:

豆包

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

OpenClaw 真正的效率开关,不是 Prompt,而是多会话和子代理

03/30

10款免费AI语音输入工具与软件 轻松实现语音转文字

03/30

MCP 协议深度解析:构建 AI Agent 的「万能接口」标准

03/30

WorkAny Bot 云端AI Agent工具采用OpenClaw框架构建

03/30

Anthropic 的 Harness 启示:当 AI Agent 开始「长跑」,架构才是真正的天花板

03/30

SkyBot由Skywork研发的云电脑AI助手

03/30

AI Agent 智能体 - Multi-Agent 架构入门

03/30

Nano Banana 2 国内使用指南 LiblibAI 无需翻墙教程

03/30

一文搞懂卷积神经网络经典架构-LeNet

03/30

一文搞懂深度学习中的池化!

03/30

AI精选