DistriFusion-高分辨率扩散模型分布式并行推理框架

作者:互联网

2026-03-22

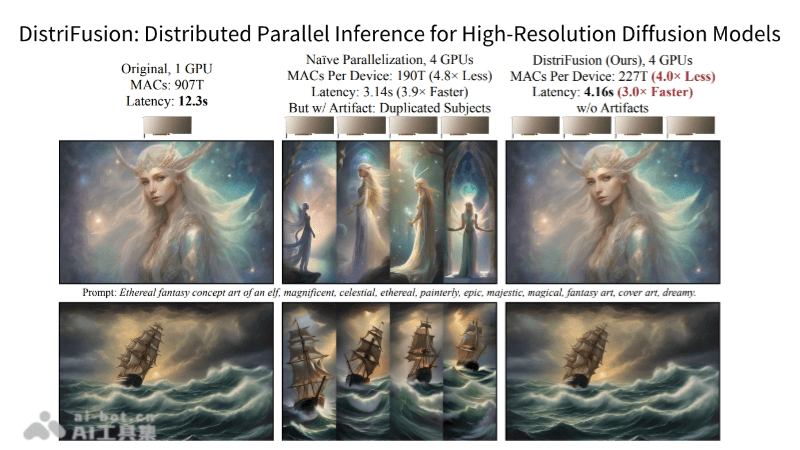

DistriFusion作为革命性的分布式并行推理框架,通过创新的patch并行技术大幅提升高分辨率图像生成效率。本文将深入解析其核心原理、技术优势及实际应用场景。

DistriFusion的核心特性

- 分布式并行推理:采用多GPU协同工作机制,显著提升扩散模型的图像生成速度。

- 智能图像分割:将高分辨率图像划分为多个patch单元,实现并行化处理。

- 即插即用适配:无需额外训练即可直接整合现有扩散模型,如Stable Diffusion XL。

- 画质无损加速:通过优化算法在提升速度的同时确保图像质量不降低。

- 高效异步通信:采用非阻塞式数据交换机制,有效降低通信延迟。

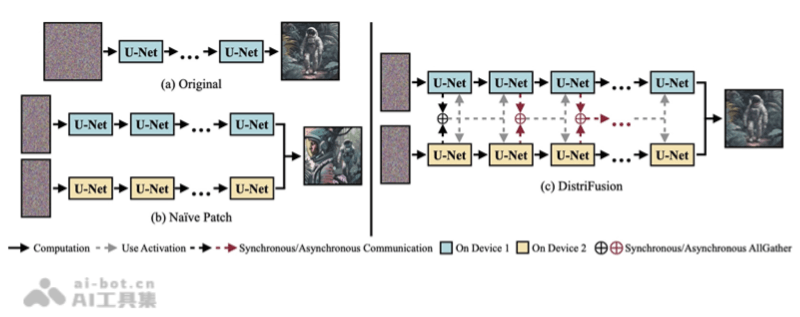

DistriFusion的运作机制

- 分片并行技术:通过将图像分割为独立处理的patch单元,实现多GPU并行计算。

- 异步数据交换:设计非阻塞通信协议,确保计算过程不被数据传输中断。

- 时序特征复用:利用扩散过程的时间连续性,重用前序步骤的特征映射。

- 动态位移策略:采用shifted patch技术模拟全局交互,避免显式通信开销。

- 流水线优化:实现计算步骤的流水线化调度,最大化GPU利用率。

- 通用适配能力:支持多种主流扩散模型的无缝集成与加速。

DistriFusion资源获取

- 开源代码库:https://github.com/mit-han-lab/distrifuser

- 技术白皮书:https://arxiv.org/pdf/2402.19481

DistriFusion的实际应用

- 数字艺术创作:为艺术家提供高效的创意可视化工具。

- 影视游戏制作:加速特效渲染和场景构建流程。

- 沉浸式体验开发:快速生成VR/AR所需的3D环境素材。

- 数据呈现创新:创建复杂数据的可视化表达方案。

- 商业视觉设计:高效产出营销所需的视觉内容。

DistriFusion通过突破性的并行计算架构,为高分辨率图像生成领域树立了新的效率标杆,其创新设计将持续推动AI内容创作的发展边界。

相关标签:

Diffusion

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

OpenClaw 真正的效率开关,不是 Prompt,而是多会话和子代理

03/30

10款免费AI语音输入工具与软件 轻松实现语音转文字

03/30

MCP 协议深度解析:构建 AI Agent 的「万能接口」标准

03/30

WorkAny Bot 云端AI Agent工具采用OpenClaw框架构建

03/30

Anthropic 的 Harness 启示:当 AI Agent 开始「长跑」,架构才是真正的天花板

03/30

SkyBot由Skywork研发的云电脑AI助手

03/30

AI Agent 智能体 - Multi-Agent 架构入门

03/30

Nano Banana 2 国内使用指南 LiblibAI 无需翻墙教程

03/30

一文搞懂卷积神经网络经典架构-LeNet

03/30

一文搞懂深度学习中的池化!

03/30

AI精选