AnimateDiff扩展文生图模型实现动画生成的框架

作者:互联网

2026-03-22

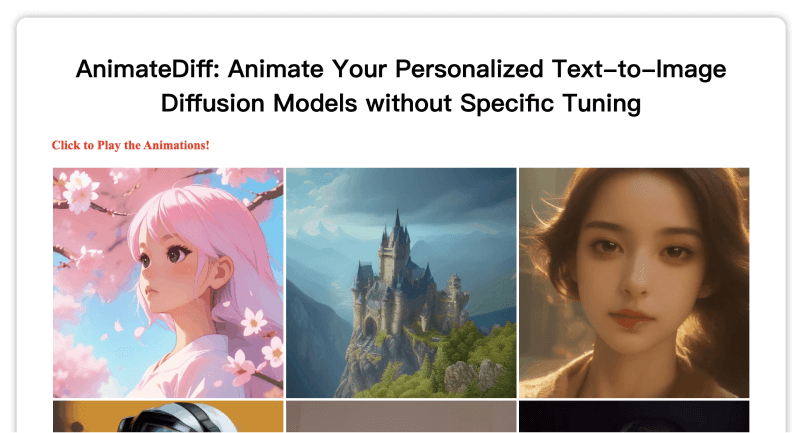

AnimateDiff作为前沿动画生成框架,能将静态图像转化为动态效果,通过文本描述即可控制内容风格,大幅降低创作门槛。下面详细介绍其核心功能与实现原理。

AnimateDiff是什么?

由上海人工智能实验室联合多所高校研发的AnimateDiff,通过运动先验知识将文本转图像模型升级为动画生成器。该框架无需特定调优即可将Stable Diffusion生成的静态图转为动态动画,显著简化创作流程。

AnimateDiff的官网入口

- 官方项目主页:https://animatediff.github.io/

- Arxiv研究论文:https://arxiv.org/abs/2307.04725

- GitHub代码库:https://github.com/guoyww/animatediff/

- Hugging Face Demo:https://huggingface.co/spaces/guoyww/AnimateDiff

- OpenXLab Demo:https://openxlab.org.cn/apps/detail/Masbfca/AnimateDiff

AnimateDiff的功能特色

- 个性化动画生成:支持将Stable Diffusion等文本转图像模型转化为动画生成器,通过文字描述直接生成连贯动画序列。

- 无需模型特定调整:内置预训练运动模块可直接插入现有模型,省去额外调参步骤。

- 保持风格特性:在动画化过程中完美保留原模型的风格特征与主题一致性。

- 跨领域应用:兼容动漫、卡通、3D动画及实景摄影等多种创作风格。

- 易于集成:采用模块化设计,非技术人员也能快速上手使用。

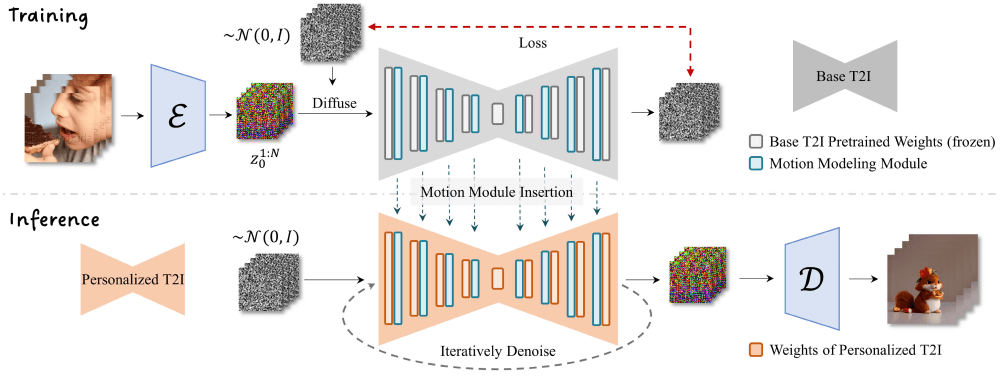

AnimateDiff的工作原理

- 运动建模模块的插入:在文本转图像模型中嵌入多分辨率运动模块,确保动画细节的一致性表现。

- 视频数据训练:基于海量视频数据集训练运动模块,全程保持基础模型参数不变。

- 时间维度的注意力机制:运用Transformer注意力处理时间维度,实现帧间自然过渡。

- 动画生成:结合文本输入与运动先验知识,输出符合描述的完整动画序列。

AnimateDiff通过创新的运动建模技术,让普通用户也能轻松制作专业级动画作品,为数字内容创作开辟了新途径。

相关标签:

Diffusion

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

OpenClaw 真正的效率开关,不是 Prompt,而是多会话和子代理

03/30

10款免费AI语音输入工具与软件 轻松实现语音转文字

03/30

MCP 协议深度解析:构建 AI Agent 的「万能接口」标准

03/30

WorkAny Bot 云端AI Agent工具采用OpenClaw框架构建

03/30

Anthropic 的 Harness 启示:当 AI Agent 开始「长跑」,架构才是真正的天花板

03/30

SkyBot由Skywork研发的云电脑AI助手

03/30

AI Agent 智能体 - Multi-Agent 架构入门

03/30

Nano Banana 2 国内使用指南 LiblibAI 无需翻墙教程

03/30

一文搞懂卷积神经网络经典架构-LeNet

03/30

一文搞懂深度学习中的池化!

03/30

AI精选