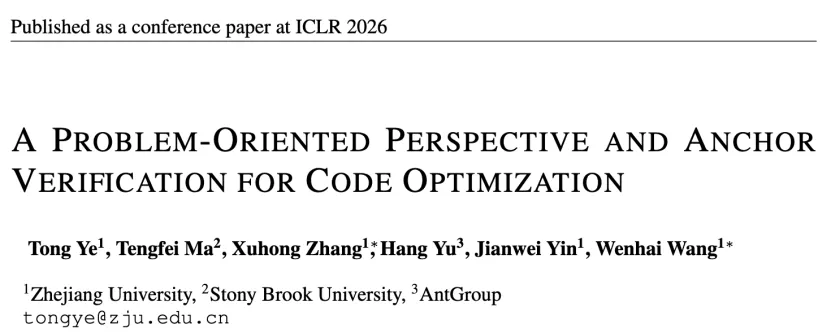

ICLR2026|问题导向结合锚点验证开启LLM代码优化新路径

作者:互联网

2026-03-20

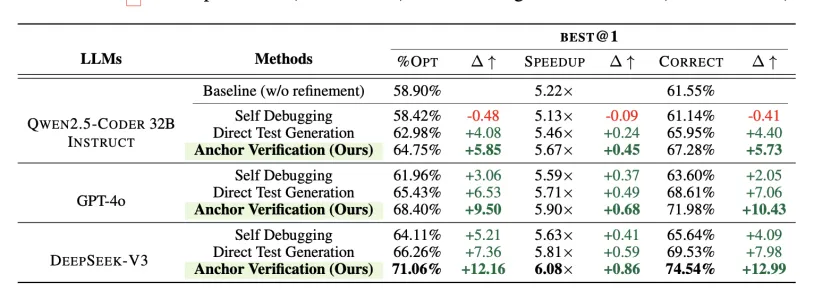

随着大模型代码生成能力的飞速发展,如何提升生成代码的执行效率成为亟待解决的关键问题。浙江大学联合研究团队创新性地提出Problem-Oriented优化视角与Anchor Verification框架,为这一难题提供了突破性解决方案。

论文链接:https://arxiv.org/abs/2406.11935

尽管当前主流大语言模型在基础代码任务中表现优异,但在性能优化场景仍面临两大核心挑战:

- 优化方案多集中于局部微调,难以实现算法层面的全局创新。传统方法依赖单一用户的迭代提交,导致优化局限于循环调整等表面改进,无法突破个体认知局限。

- 效率与正确性难以兼顾的"优化税"问题。模型在追求性能提升时,常出现语义偏差,使优化后代码丧失原有功能准确性。

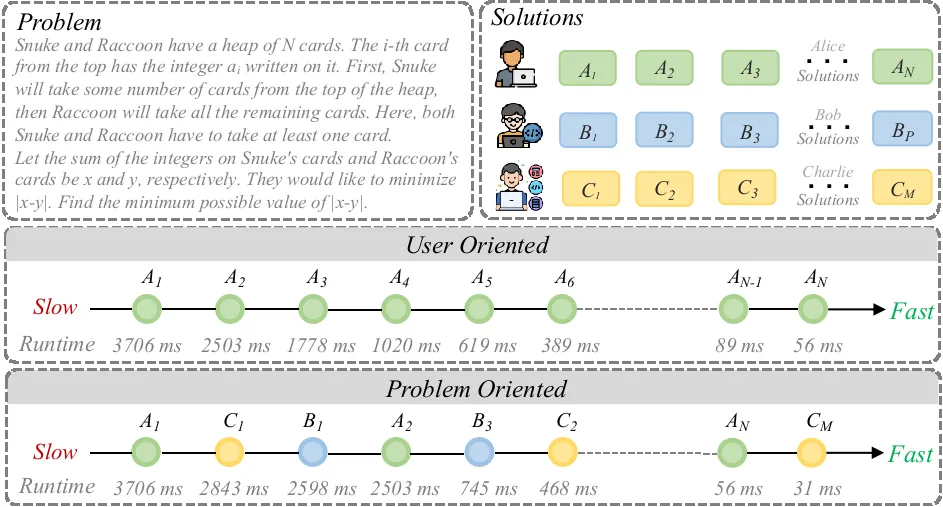

- 面向问题的优化对:汇聚多用户的全局智慧

该方案创新性地以问题为核心,整合多用户提交的代码方案,构建跨用户的优化轨迹,显著提升优化质量。

- 思维突破:融合不同开发者的算法思路,实现从暴力枚举到动态规划等全局创新,优化效果提升显著。

- 数据扩展:10个用户即可使数据量呈指数级增长,有效解决优化领域数据稀缺问题。

- 质量飞跃:全局算法优化占比达78%,远超传统方案的19%,实现量级提升。

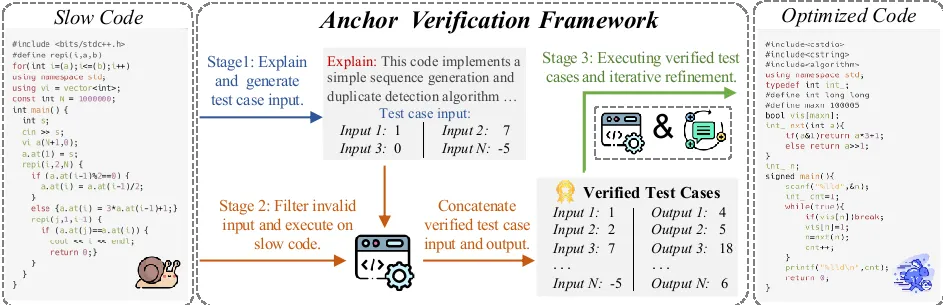

2. 锚点验证框架:用"慢代码"保障正确性

该框架巧妙利用待优化代码的功能正确性,构建三层验证机制,有效解决优化税困境。

- 功能解析:LLM深度分析慢代码功能,生成覆盖各类场景的测试输入。

- 用例构建:通过慢代码执行获取精准输出,形成可靠验证用例集。

- 迭代优化:利用验证集测试优化代码,通过反馈驱动持续修正。

该方案通过工程化设计实现便捷落地:

- 灵活部署:支持BEST@K动态策略,满足不同算力需求。

- 模块集成:验证框架可独立嵌入现有工具链,降低迁移成本。

这项研究通过创新方法实现了全局算法突破与优化税难题的双重解决,为自动化高性能代码生成开辟了新路径,将推动LLM从基础生成迈向深度优化的关键跨越。

相关标签:

相关推荐

专题

+ 收藏

+ 收藏

+ 收藏

+ 收藏

+ 收藏

最新数据

相关文章

NanoClaw 开源轻量级个人AI助手 安全可靠的OpenClaw替代方案

MonsterClaw 采用 OpenClaw 技术打造的本地化AI运行平台

TinyClaw 由TinyAGI推出的开源轻量级多智能体协作框架

携程酒店业务借助NebulaGraph实现月均风控止损逾百万元

稀宇科技开源MiniMax Office Skills生产级办公文档引擎

ToClaw由ToDesk打造的专业定制AI智能体

TypeNo 免费开源的中文AI语音输入法 无需配置直接使用

Sub2API 开源人工智能API中转网关平台 具备多账户管理功能

阿里通义推出视频生成音频框架PrismAudio

Luma AI发布Uni-1模型实现图像理解与生成一体化

AI精选